Logyn - password not required

-

Upload

eurosystem -

Category

Documents

-

view

260 -

download

0

description

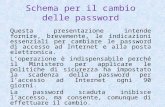

Transcript of Logyn - password not required

1

Dicembre 2012

LUNGO LA VIADELL’INNOVAZIONEI PASSI CHE FANNO LA STORIA DELL’IT

incontri con scenari stile libero

4

6

51

42

26

4

ALESSANDRO VARDANEGA MATERIALE, IMMATERIALE, SOCIALE

PRESENTE E FUTURO DELL’INDUSTRIA TREVIGIANA

NICOLA CINIEROIBM: STORIA DI UN SECOLO

DI TECNOLOGIA E CONOSCENZA

STEFANO MORIGGI PENSARE CON LE MACCHINE!

È LA TECNOLOGIA CHE CI RENDE UMANI...

VINCENZO COSENZA SOCIAL MEDIA ROI

incontri con

scenari

5

editoriale di Gian Nello Piccoli

incontri con ALESSANDRO VARDANEGA

Materiale, immateriale, socialeENZO RULLANI

Le reti d’impresa nella nuova eraNICOLA CINIERO IBM: storia di un secolo di tecnologia e conoscenza

focusLungo la via dell’innovazione

scenariC’è futuro per l’ICT in Italia? STEFANO MORIGGI

PENSARE CON LE MACCHINE!

La tecnologia entra nel mondo della fotografi a storicaSocial Media RoiFisco & Lavoro: Riforma ForneroD.L. Crescita

storiesCome nasce un caso di successo Recus: l’IT che fa la differenza Automazione dei processi

spazio a yStrade libere di crearsi

stile libero CONOSCIAMOCI

Lavorare con IT e ICT

MEDICINA E LAVORO

Nanotecnologie e nanomaterialiIL VIAGGIO

Trekking 2.0PERCORSI

Il personaggio Luca GheserSPORT

Innovazione per il nuovo professionistaCUCINA

L’acqua di mare & l’erba voglioUFFICIOVERDE

La Stella di Natale10 TITOLI

La tecnologia in borsaA PIÙ VOCI

New Media per l’innovazione socialeFUMETTI

La matita di Sue

3

6

22

42

1654

7011

26

37 72

77

81

84

88

91

92

94

97

5165

30

3460

77

84

ALBERTO PELLIZZARI IL VIAGGIOTREKKING 2.0

MASSIMO SCARPA SPORTINNOVAZIONE PER IL NUOVO PROFESSIONISTA

stile libero

SOMMARIO

6

DICEMBRE 2012

La Terza Rivoluzione Industriale ha, di fatto, introdotto una nuova “cultura” d’impresa. La provincia di Treviso, che in passato fu l’Offi cina del Nordest, come ha assimilato questo cambiamento?Vorrei partire dal titolo di un appuntamento di qualche anno

fa del Gruppo Giovani Imprenditori di Unindustria Treviso

che bene esemplifi ca il senso del cambiamento in atto nelle

nostre imprese: “Dalla fabbrica all’industria”. La rifl essione,

anticipatrice dell’attuale periodo di cambiamento, evidenziava

come l’economia della “fabbrica”, intesa come manifattura

in senso stretto, si spostasse per effetto dei processi di

globalizzazione sempre più nelle Economie emergenti a basso

costo del lavoro.

Il nostro sistema produttivo è, e sarà, chiamato a

valorizzare al massimo la propria elevata specializzazione

trasformandola in “industria” in senso compiuto, quale luogo

di accumulazione e impiego della conoscenza, capace quindi

di guidare processi manifatturieri, qui e altrove, inseriti in

un processo complesso che inizia con la fase di ideazione,

progettazione, design, industrializzazione per arrivare alla

comunicazione, commercializzazione e vendita.

Capitale umano e conoscenza sono quindi le leve dello

sviluppo presente e futuro di questo territorio, che non dovrà

però dimenticare la cultura della “fabbrica”, ovvero la capacità

manifatturiera che rimane il nostro asset distintivo.

L’evento era del 2004, oggi le aziende trevigiane come rispondono a questa “nuova cultura” che vede strategici nella catena produttiva gli elementi della conoscenza e del capitale umano?Fondazione Nordest afferma che anche in una “tradizionale”

media impresa metalmeccanica del nostro territorio le

persone impiegate nei reparti produttivi non sono più la

maggioranza della forza lavoro, mentre un buon 50% dei

dipendenti è rappresentato da fi gure professionali addette a

funzioni “terziarie”. È l’industria, per riprendere quanto detto,

che diversamente dalla “fabbrica” ormai comprende al suo

interno numerose funzioni legate alla conoscenza che prima,

almeno nelle imprese medio – piccole, erano sicuramente

meno presenti.

L’impresa è oggigiorno attenta a ciò che sta a “monte” e a

“valle” della catena produttiva, cioè è chiamata a presidiare

una catena del valore ben più lunga e complessa rispetto al

passato.

6

Intervista ad Alessandro Vardanega, presidente di Unindustria Treviso

PRESENTE E FUTURO DELL’ INDUSTRIA TREVIGIANA

MATERIALE,IMMATERIALE, SOCIALE

7

incontri con

“In passato, alcuni fattori hanno permesso una crescita straordinaria: ad esempio la propensione al rischio perché il contesto sociale era ancora agli inizi e poteva rilanciare”

7

“Oggi, l’impresa presidia ciò che sta a ‘monte’e a ‘valle’ della catena produttiva: ovvero la capacità di progettazione, ideazione e il rapporto con il mercato”

TREVISO DUEProgetto dell’architetto svizzero

Mario Botta. Il complesso

ospita istituzioni pubbliche

e private, abitazioni e spazi

commerciali. Dal 2011 è sede

di Unindustria Treviso

8

DICEMBRE 2012

Quali sono questi aspetti? Un tratto che accomuna aziende eccellenti è il fatto che

presidiano quella parte della catena che sta a “monte”, ovvero

la capacità di progettazione, ideazione, design. Questi sono gli

elementi che creano funzioni immateriali.

E poi, a “valle”, quindi intendo il rapporto con il cliente finale

che spesso in passato è stato vissuto in maniera indiretta

perché vendevamo a grossisti e facevamo i contoterzisti,

mentre oggi va seguita attentamente la relazione con il

consumatore perché ti permette di intercettare e capire i

bisogni dell’aspetto produttivo.

Il valore si colloca, quindi, molto più che in passato nella

parte iniziale e finale del ciclo pur rimanendo, naturalmente,

essenziale la componente manifatturiera in senso stretto, che

è eccellenza e vocazione del nostro territorio.

È una manifattura che si va sempre più terziarizzando così

come, in parallelo, i servizi si vanno “industrializzando” nel

creare una sintesi virtuosa e competitiva nei mercati.

Il nuovo valore diventa l’immateriale…

Nel percorso evolutivo diventa importante il fatto di creare

“valore” nei prodotti anche oltre il dato produttivo, pure

essenziale, comunicandone ad esempio il dato di innovazione,

il legame con il territorio, la qualità estetica e il design.

Tecnologia è conoscenza?Abbiamo attraversato in questi ultimi vent’anni almeno

due grandi cambiamenti che segnano una discontinuità

irreversibile rispetto al passato: l’apertura globale dei mercati

e la diffusione delle tecnologie in particolare quelle ICT. Tutto

questo ha trasformato l’organizzazione e i processi aziendali.

Inoltre, le tecnologie di comunicazione fanno accedere

agevolmente a conoscenze presenti in tutto il mondo.

Questo ha anche messo in discussione il concetto di

distretto, su cui si è fondata una parte importante del nostro

sviluppo industriale. Un tempo, infatti, le conoscenze su un

determinato comparto produttivo erano patrimonio proprio del

Alessandro Vardanega, 49 anni, sposato e padre di Francesco, è presidente di Industrie Cotto Possagno S.p.A., azienda del comparto laterizi e coperture.

Laureato in Economia Aziendale a Ca’ Foscari, ha maturato una decennale esperienza professionale in una primaria società internazionale di organizzazione e revisione contabile prima di assumere la responsabilità dell’azienda di Possagno, nata nel 1998 dall’unificazione di cinque imprese tra le quali quella che, da più generazioni, è della famiglia dello stesso Vardanega.

Alessandro Vardanega ha, inoltre, maturato una significativa esperienza associativa. In ambito nazionale, quale presidente, dal 2002 al 2006, dei Produttori Italiani di Coperture e tuttora come Vicepresidente di Andil, l’Associazione nazionale degli industriali dei laterizi aderente a Confindustria. In ambito trevigiano è stato, prima, presidente del Gruppo Laterizi – Calce – Cemento e, successivamente, vicepresidente di Unindustria Treviso con delega al Territorio, Utilities e Fonti Energetiche. È stato anche presidente di Unint, il consorzio promosso dall’Associazione per favorire le collaborazioni e aggregazioni tra imprese. È stato presidente di Proetica, l’associazione promossa in provincia di Treviso per lo sviluppo di modelli avanzati di responsabilità sociale d’impresa. Il 24 maggio 2008 è stato eletto presidente di Unindustria Treviso e riconfermato nel 2012 per un ulteriore biennio. È componente della giunta e dal 2012 anche del consiglio direttivo di Confindustria.

8

9

distretto, dove occorreva esserci e inserirsi.

Oggi invece, grazie alla rete, si può disporre di conoscenze

“originali”, anche se sviluppate in contesti lontani, a costi

molto inferiori rispetto a prima.

Un esempio molto pratico è il Gps usato ormai dovunque.

La possibilità di accedere a questi saperi è quindi essenziale

per le imprese e la Comunità. Per questo la banda larga è

un’infrastruttura altrettanto strategica di un’autostrada se non

di più. Anche su questo, purtroppo, scontiamo un ritardo che

si aggrava di anno in anno.

Il passo successivo è un argomento a Lei caro:Questa fase di crisi e di forte trasformazione rende

indispensabile che si ricreino le condizioni per un nuovo

Patto Sociale tra imprese e territorio. Occorre ripensare a

quanto avvenuto nel Dopoguerra quando questa comunità

ha avviato una grande stagione di sviluppo, che ha portato

benessere e opportunità, fondata su valori e obiettivi condivisi.

Erano condivisi, ad esempio, la propensione al rischio – in un

contesto sociale comunque povero –, la grande laboriosità,

il senso di responsabilità e di appartenenza. Eravamo una

popolazione giovane in un territorio con ampia disponibilità

di spazio: questo ci ha permesso di diventare la “fabbrica”

non solo delle aree più sviluppate di questo Paese ma anche

dell’Europa e oltre.

Raggiunto il benessere, e dandolo evidentemente per

scontato, si è passati a un approccio indifferente nei confronti

delle ragioni delle imprese, viste, quando va bene, solo

come strumento di arricchimento personale e non come

“infrastruttura sociale”.

Questo periodo di pesante crisi ci pone adesso di fronte a

una fase di cambiamento e forte discontinuità, pur partendo

da condizioni sicuramente migliori rispetto al passato. Anche

in questo caso occorre condivisione e alleanza tra imprese

e comunità per non rischiare il declino. Ho ripetuto in più

occasioni che senza impresa non c’è lavoro, senza lavoro non

c’è famiglia e senza famiglia non c’è società.

Interazioni quindi anche con le istituzioni:La competitività territoriale ha, come detto, la sua premessa

fondamentale nella condivisione tra imprese e Comunità, e a

questa devono seguire provvedimenti coerenti da parte delle

istituzioni, locali e nazionali, e dagli altri soggetti che operano

per lo sviluppo.

Potremmo diventare ben più attrattivi per gli investimenti se

vi fosse un sistema normativo più semplice e snello, un fisco

che potesse essere incentivo forte per le nuove iniziative

(come avviene in molti Paesi), costi dell’energia che non

fossero più alti del 30% rispetto al resto d’Europa.

E occorre conoscere com’è effettivamente l’impresa, che

nei mercati globali opera quotidianamente, e comprendere

ad esempio il valore di quell’immateriale (marchi, brevetti,

reti commerciali..) che non viene adeguatamente pesato

dal sistema finanziario nella determinazione del credito alle

aziende.

Per chiudere la nuova impresa e il ricambio generazionale.Infine, nel ripensamento della strategia aziendale c’è anche

un inevitabile impatto nell’organizzazione dell’impresa.

Anche per quanto riguarda il passaggio generazionale, tema

dibattuto a lungo e considerato un fattore di rischio per il

sistema imprenditoriale di questo territorio.

In realtà, il ricambio generazionale è già in corso, spesso

determinato anche dai processi di cambiamento in atto.

Possiamo rilevare come siano numerosi gli esempi di

successo, in cui la nuova generazione si affianca a quella

dei padri garantendo continuità e la tradizionale laboriosità,

ma apportando anche nuove competenze e nuovi modelli

organizzativi in azienda, che vedono il coinvolgimento

maggiore dei collaboratori e la delega di funzioni di

responsabilità a figure manageriali che operano insieme

all’imprenditore.

“Nel percorso evolutivo diventa importante il fatto di creare ‘valore’ nei prodotti […]. Si deve dare al manufatto i segni di riconoscibilità e di appartenenza a una comunità”

“I grandi cambiamenti, che la crisi ha accelerato, sono l’apertura dei mercati e la diffusione delle tecnologie. Queste ultime ti permettono di gestire in modo più efficiente i processi aziendali”

“L’impresa deve poter contare in una condivisione con la Comunità. […]C’è bisogno di rifondare un patto sociale in un rapporto di scambio che deve essere reciproco”

9

incontri con

10

DICEMBRE 2012

Potenti e completi, flessibili e affidabili

Archiviazione, sorveglianza video, virtualizzazione e soluzioni cloudProtezione, gestione e condivisione dei file importanti. La gamma di unità di storage di rete Iomega® StorCenter™ offre condivisione dei contenuti professionale e protezione dei dati avanzata. Con una capacità fino a 48 TB, la gamma Iomega® StorCenter™ garantisce prestazioni, velocità e affidabilità migliori di sempre.

©2012 Iomega Corporation. Tutti i diritti riservati. Iomega, StorCenter e il logo stilizzato “i” sono marchi o marchi registrati di Iomega Corporation negli Stati Uniti e/o in altri Paesi. I nomi di altri prodotti, marchi o società menzionati nella presente documentazione sono marchi o designazioni dei rispettivi proprietari www.iomega.com.

* Solo su alcuni modelli www.iomega.com

- Prestazioni elevate con Intel® Celeron, Intel Atom o il

nuovo processore Intel Quad-Core Xeon

- Una soluzione conveniente per la virtualizzazione dei

server, certificata per Windows®, VMware® e Citrix®

- Tecnologia cloud integrata

- Ambienti PC, Mac e Linux

- Soluzioni integrate per la gestione e l’archiviazione dei

contenuti di sorveglianza video: centinaia di modelli

di videocamere IP supportati.

- McAfee VirusScan Enterprise* integrato

- Installazione in tre passaggi facile e veloce attraverso

un’interfaccia Web intuitiva

- Protezione dei dati avanzata con supporto RAID

- Capacità massima di 48 TB

11

A guardare semplicemente i grafi ci dell’andamento del giro

d’affari legato all’industria delle It e Ict in Italia ci sarebbe

poco da stare allegri. Dal 2010 al 2012 il business del Global

digital market, limitatamente ai primi nove mesi dell’anno,

secondo i dati Assinform, è sceso da 71 milioni di euro a

meno di 69 e le previsioni dicono che scenderà almeno di un

altro milione nel 2013.

Le prospettive sugli investimenti sulle Ict per servizi non

residenziali, poste a confronto con quelli degli altri paesi del

mondo, pone poi l’Italia in posizioni imbarazzanti, al di sotto di

quelli di Spagna, Portogallo e Corea.

Il tema di fondo da tenere ben presente, tuttavia, è che

questo settore non è come tutti gli altri, nel senso che

l’oggetto da studiare, nelle analisi di mercato e nelle

proiezioni di evoluzione, è mobile, quasi sfuggente, capace di

cambiare il proprio perimetro in tempi brevissimi e di relegare

domani nell’area del “tradizionale” ciò che oggi appare

altamente innovativo.

E qui inizia già una prima importante distinzione che, anche in

Italia, vede trend divergenti. Se il segmento tradizionale – cioè

quello dell’hardware, dell’assistenza tecnica, dei software

non “open source” – denota una diminuzione fra il 2011

Il Mercato richiede nuovi investimenti e sostegno dal Governo

Presentati i dati Assinform 2012 sull’andamento del mercato IT e ICT in Italia. Un mercato che nel nostro

Paese sarà condizionato in modo decisivo da due fattori che non dipendono dai player privati del settore,

vale a dire la propagazione delle reti a larga banda sul territorio e la concretizzazione

dell’ “Agenda digitale” del Governo (dati Assinform 2012).

C’È FUTUROPER L’ICT IN ITALIA?

scenari

GIANNI FAVERO

12

DICEMBRE 2012

e il 2012 di almeno 2,5 punti percentuali, quella correlata

alle componenti aggiuntive e innovative, che corrisponde

grosso modo alla sesta parte del fatturato complessivo,

evidenzia invece un aumento di quasi il 7%. Si tratta, in

estrema sintesi, di tutto ciò che ha a che fare con sistemi di

connessione in mobilità, con il “cloud” – vale a dire, sempre

semplifi cando, l’affi damento dei dati a server decentrati

accessibili ovunque via web – con servizi di produzione e

di adeguamento di software su piattaforme libere e, per

quanto riguarda l’hardware, la fetta che comprende il mondo

di tablet e smartphone. Fra la prima metà del 2011 e il

corrispondente periodo di quest’anno, infatti, il mercato dei pc

ha perso il 14,7% per il comparto dei desktop e ben il 18,6%

per i notebook, area che è stata sensibilmente erosa dal

contestuale incremento dei tablet, la cui vendita in Italia ha

fatto registrare in un anno un corposo +77,1%.

“Oltre alla connessione in mobilità, cioè uno dei capisaldi

della grande sfi da – rileva Giuseppe Bincoletto, presidente

del Gruppo Terziario Innovativo di Unindustria Treviso – l’altro

grande aspetto dello scenario dell’immediato futuro sarà

la transizione da software e server chiusi a componenti

“standardizzate” ed aperte. Facciamo un esempio: i gestionali

aziendali da “cassaforte” dei dati, i più moderni diventano

banca delle informazioni se non addirittura bottega dei servizi

aziendali, con cui l’azienda non solo risponde alle richieste

commerciali, ma spesso le stimola proponendo servizi e

opportunità.

Oggi, grazie all’introduzione di standard internazionali, i

sistemi si “parlano” sempre di più. Questo signifi ca meno

costi in digitazioni e licenze e una grande fl uidità nei processi,

specie in ambito globale”.

13

Sullo sfondo, in ogni caso, rimane il fatto che il mercato

complessivo delle It/Ict in Italia sarà condizionato in modo

decisivo da due fattori che non dipendono dai player privati

del settore, vale a dire la propagazione delle reti a larga

banda sul territorio e la traduzione in realtà delle buone

intenzioni dell’“Agenda digitale” del Governo.

“Per le autostrade informatiche, in primo luogo la

penetrazione della fi bra ottica, siamo all’età della pietra –

ammette Bincoletto – mentre sulla digitalizzazione delle

funzioni nei rapporti fra cittadini/imprese e amministrazione

pubblica, c’è una grande attesa.

Speriamo ardentemente che non venga delusa, perché il

modello “smart city” che riassume tutti questi fl ussi è naturale

per i nativi digitali, ovvero una importante e crescente parte

dei cittadini attivi in questo Paese”.

L’infrastrutturazione per Internet veloce, intanto, procede ma

non rapidamente come atteso, tanto che più di qualcuno

pronostica il sorpasso della banda larga via cavo da parte

delle reti radio dei vari operatori telefonici che, ormai,

promettono velocità da sogno anche via etere.

Ma attenzione a non fare della velocità l’unico totem.

“Conviene andare a passi graduali. Non possiamo pensare

– conclude il presidente del Gruppo Terziario Innovativo degli

industriali trevigiani – a zone in cui i dati viaggiano a 100 Mb

ed altre no, perché il valore vero è la diffusione capillare, e la

velocità del sistema la dà il tratto più lento. Realisticamente,

con linee a 3 Mb reali disponibili veramente ovunque, ci

sarebbe da esser contenti; è terribile continuare invece con

questa diffusione a macchie di leopardo che soddisfa appena

poco più della metà del territorio”.

scenari

informazione pubblicitaria

Moltiplicata per 3 la velocità dei dati in rete geografi ca WANE per 20 la velocità del Disaster RecoverySilver Peak, società specializzata nelle soluzioni

di ottimizzazione delle WAN è stata recentemente

nominata Leader nel Gartner Magic Quadrant.

L’azienda sviluppa appliance fi siche e virtuali progettate

per ottimizzare le prestazioni della WAN riducendo allo

stesso tempo i costi. Grazie all’approccio esclusivo adottato

vengono assicurati altissimi livelli di scalabilità e fl essibilità

per supportare in modo strategico importanti iniziative IT,

come il consolidamento dei data center, la migrazione dei

dati, le procedure di disaster recovery, la centralizzazione e la

virtualizzazione di server e desktop.

Da prove sul campo si dimostra una eccellente soluzione per

risolvere problemi di larghezza di banda e di latenza e per

migliorare le prestazioni e l’affi dabilità della replica dei

dati, il backup e il disaster recovery attraverso una rete WAN.

Prodotto di punta dell’azienda è la Virtual Acceleration

Open Architecture (VXOA), software pluripremiato per

l’ottimizzazione della WAN. Le tecnologie alla base delle

VXOA e in grado di accelerare le applicazioni aziendali in

modo effi cacie e allo stesso tempo affi dabile sono: Network

Memory™, tecniche di accelerazione della rete TCP,

tecniche MPLS e VPN IP per preservare l’integrità della

rete; e policy effi caci di Quality of Service (QoS) per assicurare

l’assegnazione di priorità appropriate alle applicazioni e

l’allocazione di risorse di rete adeguate.

La soluzione Silver Peak Network Memory™ esamina tutto

il traffi co inviato tra client e server, archiviando le informazioni

come istanza locale nelle appliance Silver Peak. Le informazioni

ripetitive vengono distribuite localmente invece di essere inviate

attraverso la WAN, migliorando le prestazioni delle applicazioni

e l’utilizzo della WAN.

I problemi comuni di distribuzione dei pacchetti associati alle

tecnologie WAN condivise vengono risolti attraverso l’uso di

tecnologie MPLS e VPN IP che agiscono in tempo reale

e includono, ad esempio, Forward Error Correction (FEC)

adattiva e Packet Order Correction (POC) per risolvere il

problema dei pacchetti persi o fuori ordine.

Grazie alle varie tecniche di accelerazione TCP per

mitigare l’impatto della latenza della WAN, ad esempio il

dimensionamento regolabile delle fi nestre e gli avvisi selettivi,

è possibile risolvere il problema intrinseco della verbosità

(“chattiness”) che può altrimenti compromettere le prestazioni

delle applicazioni attraverso una WAN.

Infi ne, tecniche avanzate di Quality of Service (QoS) danno

priorità al traffi co e garantiscono la disponibilità di risorse di

rete. La Virtual Acceleration Open Architecture (VXOA),

oltre ad essere utilizzata in tutti i prodotti NX, VX e VRX di Silver

Peak, include funzioni avanzate anche per l’integrazione con

prodotti di terze parti, come router, switch, server e array di

storage.

Per maggiori informazioni

su Silver Peak

consultate il sito italiano

http://www.silverpeak.it/

15

Nel corso di questi difficili anni Unindustria Treviso è stata pro-

tagonista di una grande trasformazione che ha seguito due

grandi direttici: la ricerca di una sempre maggior capacità di

comprensione delle esigenze espresse dalle imprese e la messa

a punto di una nuova generazione di servizi. Per sottolineare

questo impegno nasce il marchio “Unindustria c’è”. Non si tratta

di una semplice campagna di comunicazione, ma di un impegno

morale e operativo che l’Associazione assume nei confronti di

ciascuna impresa associata. “Unindustria c’è” è anche lo slogan

e il segno grafico attraverso il quale verranno identificate le

iniziative di promozione e di informazione riferite ai nuovi servizi.

In un momento storico, in un mercato e in una società segnati

dalle incertezze, come anche dalle opportunità, Unindustria c’è!

Gli imprenditori trevigiani ci possono contare.

una opportunità da condividere

16

DICEMBRE 2012

I Passi che fanno la Storia dell’IT

COPERTINA

The Economist

aprile 2012

16

Sulla copertina del numero dell’Economist c’è un uomo seduto a una scrivania, intento a lavorare con

tastiera e mouse, collegati a uno stabilimento industriale in miniatura dal quale escono automobili,

aeroplani e utensili. Il disegno illustra come si stia realizzando in questi anni la 3° rivoluzione industriale.

Una nuova “era” – cosparsa di idee, prove, e scelte – che si apre a questo millennio, nell’epoca della

digitalizzazione, con un universo in accelerazione e, quindi, con signifi cativi mutamenti dei sistemi

produttivi e infrastrutturali, e soprattutto culturali. (Il Post, 2012)

LUNGO LA VIA DELL’ INNOVAZIONE

18

DICEMBRE 2012

Dal telefono di Antonio Meucci di fi ne 800, a Guglielmo

Marconi che apre l’era del wireless con un’apparecchiatura

capace di inviare segnali intelligibili a una distanza di circa

2400 km, passando per il primo calcolatore elettronico a

programma memorizzato di John Neumann, e per la prima

calcolatrice elettronica italiana chiamata Pisana, incrociando

il primo personal computer dell’italianissimo Pier Giorgio

Perotto nel ’65, assistendo all’introduzione nel mercato del

microprocessore a opera di Federico Faggin nel ’70, e alla

progressiva convergenza e integrazione di informatica e

telecomunicazioni.

Fino ad arrivare, negli anni 80, al protocollo http (HyperText

Transfer Protocol) e, nel successivo decennio, ai providers,

fornitori commerciali di accesso alla rete.

In un secolo di storia abbiamo vissuto un’accelerazione

considerevole nello sviluppo della tecnologia, con ricadute

rilevanti nel contesto produttivo, infrastrutturale, culturale

e sociale. Eppure i cambiamenti sono ancora in atto: basta

pensare all’impressionante evoluzione fatta nell’ambito

della telefonia, così come nelle reti multimediali interattive

che saranno su cavo. Eppure, il vero cambiamento è quello

dell’ambiente culturale: in questa nuova epoca, infatti,

si parla, non solo di comunicazione, ma sopratutto di

trasparenza delle informazioni e di partecipazione. Mutano

gli scenari e i rapporti di interscambio di informazioni e di

educazione.

Nel 2011 il 52,2% della popolazione di 3 anni e più utilizza

il personal computer e il 51,5% della popolazione di 6 anni

e più naviga su Internet. Gli utenti di Internet che hanno

utilizzato la rete prevalentemente per spedire o ricevere

e-mail sono l’80,7%, e per cercare informazioni su merci e

servizi il 68,2%.

Le tecnologie, quindi, sono oggi vere e proprie leve

strategiche e sociali. Nell’industria l’impatto della tecnologia

porta con sé una nuova gestione delle attività aziendali.

Non a caso, in un suo studio Richard Nolan1 sostiene

che l’information technology rappresenta la leva della

trasformazione organizzativa, l’elemento strategico il cui

sviluppo può essere suddiviso in tre macro periodi: l’era del

Mainframe tra gli anni ’40 e ’60, in cui il “sapere tecnologico”

focus

19

e la gestione degli strumenti rimane in mano ad un numero

ristretto di persone specializzate e non esiste un’interazione

con l’utenza.

In seguito, fi ne anni ’60, si passa all’era del così detto “Stand

Alone”, cioè del personal computer dotato di capacità propria

di elaborazione, con una maggiore autonomia nella gestione

dei dati e delle informazioni. Infatti, la maggiore accessibilità ai

dati e agli strumenti sposta l’attenzione delle aziende verso il

mondo dell’ICT innestando una nuova rifl essione nei confronti

dello sviluppo e sulla necessaria convergenza del sapere

manageriale con quello tecnologico. Infi ne, con l’era della Rete,

nella seconda metà degli anni ’80, diventa diffusa la possibilità

di connettere i personal computer all’interno di una struttura

(rete locale, o rete del client-server): si tratta di un nuovo

approccio di condivisione. In conclusione, Internet negli anni

90 esplode in tutte le sue sfaccettature.

Da quel periodo, comincia una profonda rifl essione del ruolo

della tecnologia dell’informazione anche in azienda: dalla

semplice gestione delle attività, diventa una leva in base alla

quale l’impresa ripensa in maniera radicale il proprio modo di

fare business e quindi a volte la propria mission.

La tecnologia dell’informazione è un concetto fondamentale

della terza rivoluzione industriale che ha dato vita alla Società

dell’Informazione. Siamo di fronte, adesso, da una parte a

un nuovo vigoroso clima di fi ducia intorno alla scienza e alla

tecnica che alimenta forme di “neopositivismo”, ma anche

aspre critiche, dall’altra rischiamo di soffrire il problema del

“digital divide”, che mette in contrapposizione un gruppo

ristretto di persone in grado di governare le nuove tecnologie a

una massa che rischia di non poter esercitare completamente i

propri diritti di cittadinanza. E allora si inseriscono interrogativi

e dibattiti sui quali la Comunità dell’era tecnologica deve

dialogare, ricordandosi che esiste anche una “responsabilità

sociale” per via di questa nuova gestione di dati.

1Strategic Information Management - Challenges and

strategies in managing information systems , Robert D.

Galliers and Dorothy E. Leidner - Third Edition - Butterworth

Heinemann; Nolan, R.L. 2001

20

DICEMBRE 2012

TECHNOLOGICAL DISCONTINUITY

OR

GA

NIZ

ATIO

NA

L L

EA

RN

ING

1960 1975 1980

*

*

STEPB

DATA PROCESSING ERA MICRO ERA

20

1895

1945

1948

1955

Guglielmo Marconi apre l’era del wirelessDopo numerosi esperimenti, Marconi mise a punto un’apparecchiatura con cui riuscì a inviare segnali intellegibili a

una distanza di circa 2.400 km, usando un’antenna direzionale. Fondò a Londra la Marconi’s Wireless Telegraph and

Signal Company, nella quale lavorarono diversi scienziati a un ulteriore perfezionamento dei progetti.

John von Neumann e la nascita del computerPrese avvio il progetto EDVAC (Electronic Discrete Variable Computer) sotto la guida di John von Neumann. Nacque,

così, il primo progetto di calcolatore elettronico a programma memorizzato.

invenzione del transistor che rende possibile la miniaturizzazione degli apparati di telecomunicazioneL’età dell’elettronica dei semiconduttori iniziò nel 1948 con l’invenzione del transistor presso i laboratori americani

della Bell Telephon. In pochi anni l’introduzione del transistor rivoluzionò il mondo dell’elettronica, aprendo la strada

alla miniaturizzazione degli apparecchi elettrici. Si diffuse, allora, la produzione di televisori, radio, elettrodomestici.

nasce la calcolatrice elettronica PisanaLa CEP è la prima calcolatrice elettronica italiana per le ricerche scientifi che, nata per suggerimento di Enrico Fermi.

Le province di Pisa, Lucca e Livorno nel 1953 misero a disposizione la somma di 150 milioni di lire per la realizzazione

di un sincrotrone e per progettare e costruire un calcolatore elettronico.

21

Fonte: AICA, Associazione italiana informatica e calcolo distribuito.

The stages theory of growth. Fonte: R.L. Nolan 2001

1995

*

2010

YSTEP

NETWORK ERA

21

focus

1965

Anni ’70

Anni ’80

Anni ’90

nasce il personal computer dell’italiano Pier Giorgio PerottoQuarant’anni fa, nelle sale dell’esposizione Bema Show di New York, veniva presentato il modello Programma 101.

Si chiamava la “perottina” dal nome del suo inventore Piergiorgio Perotto. Si trattava di un calcolatore da scrivania, con

stampante integrata, con design avveniristico per l’epoca.

le tecnologie dell’informatica vengono mutuate dalle telecomunicazioni, siamo agli albori dell’ICTLa trasmissione di informazioni tra calcolatori connessi in rete fra loro, avviata negli anni ’60, costituì fenomeno di grande

portata pratica: la progressiva convergenza e integrazione di informatica e telecomunicazioni. Questi due settori, quindi,

trovarono un punto di convergenza, dopo che si erano sviluppati per lungo tempo indipendentemente l’uno dall’altro.

avvento del world wide webWWW: presso il CERN di Ginevra, fu defi nito il protocollo HTTP (HyperText Transfer Protocol) che permetteva, tramite

dei collegamenti (link), la lettura dei documenti (che possono contenere anche risorse di tipo multimediale) in modo non

sequenziale (ipertestuale).

compaiono i providers, fornitori commerciali di accesso alla reteLe origini del fenomeno dei portali e l’introduzione di tale termine nel lessico dei nuovi media risalgono al 1997. In pochi

anni il Web, da strumento esoterico per tecnofi li, si era trasformato in un fenomeno di massa.

22

DICEMBRE 2012

Intervista a Enzo Rullani, professore di Economia della Conoscenza e di Strategie di impresa presso la Venice International University

LE RETID’IMPRESANELLA NUOVA ERA:UNA NUOVACULTURA

La nuova economia della conoscenza: sviluppi e prospettive futureLe reti d’impresa vengono spesso pensate come rimedio

a una forma specifi ca di “debolezza” che caratterizza il

capitalismo industriale italiano, frammentato in una miriade

di piccole e piccolissime imprese, fi nora aggregate, grazie

al collante territoriale, in un centinaio di distretti industriali,

specializzati nei vari prodotti del made in Italy.

Aggregando le imprese, senza far venire meno la loro

autonomia individuale, la rete consentirebbe di prendere

due piccioni con una fava: mantenere l’ossatura dell’attuale

assetto produttivo, basato sull’imprenditorialità diffusa;

realizzare, grazie alla rete, quelle economie di scala e di

specializzazione (reciproca) che sono precluse alle piccole e

piccolissime imprese.

Tutto vero, tranne che per un particolare: le imprese che

fi nora si sono maggiormente spinte nella sperimentazione

di forme di alleanza, di cooperazione e di specializzazione

reciproca tra imprese sono state le grandi e grandissime.

Sia nell’organizzazione delle fi liere sia nell’affrontare problemi

nuovi, per i quali è utile cooperare con altri. In realtà, la

proliferazione di queste alleanze e forme di co-innovazione e

cooperazione mette in evidenza il fatto che la rete di imprese

– che somma competenze e risorse complementari – non

è solo un rimedio alla debolezza della piccola scala, ma è la

forma tipica di organizzazione richiesta dal nuovo paradigma

emergente: il capitalismo globale della conoscenza.

Che impone una priorità: il sistematico ri-uso della

conoscenza altrui, in tutti i casi in cui si tratta di acquisire

competenze che non si hanno, di velocizzare l’apprendimento,

di estendere il proprio raggio di azione, di accreditare

signifi cati standard e certifi cazioni utili.

Non si tratta di una prosecuzione delle traiettorie coltivate in

passato, ma di una vera a propria discontinuità. Si tratta di

mettere consapevolmente, e senza rimpianti, una distanza tra

passato e futuro, che rivede criticamente il primo e prepara

intenzionalmente il secondo. Un passaggio diffi cile, ma che

va fatto se si vuole capire, organizzare, proiettare il nostro

mondo dalla vita e dalla produzione verso il nuovo paradigma

con cui dobbiamo fare i conti. Trovando anche il vocabolario

giusto, che consenta di prefi gurare e raccontare la transizione

da compiere.

23

Lei pensa che questo vocabolario manchi e sia dunque ancora da mettere a punto?Certamente. È ormai diventato un luogo comune dire “viviamo

nella società della conoscenza” o “adeguiamo il nostro modo

di lavorare alle esigenze dell’economia della conoscenza”.

Affermazioni vere e importanti, ma di cui spesso sfugge il

contenuto: che cosa signifi ca, infatti, vivere nella società della

conoscenza o lavorare nell’economia della conoscenza?

Se la conoscenza è diventata la principale risorsa produttiva,

e dunque il motore che genera il valore e presidia la

competitività, è anche vero che – salvo poche eccezioni

– facciamo fatica a renderci conto dei cambiamenti che

tutto ciò comporta. Abbiamo dunque bisogno di guardare

anche all’economia del valore con nuovi occhi, se vogliamo

riconoscere e padroneggiare il nuovo, già presente nella

realtà.

Pensiamo solo a questo: il lavoro che una volta era lavoro

energetico – un lavoro muscolare, di fatica, che trasforma la

materia prima in prodotto fi nito – è ormai diventato nella sua

quasi totalità (anche in fabbrica) un lavoro di tipo cognitivo.

Ossia lavoro che non trasforma direttamente la materia, ma

produce conoscenze (informazioni, idee, decisioni, relazioni,

signifi cati ecc.). E sono queste conoscenze a mettere in

funzione le macchine o gli altri strumenti cui è delegata la

trasformazione materiale degli oggetti e degli ambienti in cui

viviamo.

Lo stesso vale per il capitale: una volta era quasi totalmente

impiegato in assets materiali (edifi ci, macchine, magazzino

di materie e prodotti fi niti); oggi è impiegato sempre più

spesso nella formazione di assets immateriali (conoscenze,

tecnologie, brevetti, soluzioni, relazioni, impegni ecc.). Senza

contare che anche il valore delle macchine ha perso relazione

con il valore dei materiali impiegati per costruirle e dipende

invece, in gran parte, dalle conoscenze più o meno innovative,

più o meno esclusive, che vi sono incorporate. I fattori

produttivi, dunque, hanno assunto natura cognitiva.

E lo stesso vale per i processi che li impiegano, e per il

consumo che generano alla fi ne della fi liera. Anche questo

consumo vale in funzione dei signifi cati e delle esperienze

emotive che lo accompagnano, non solo per i processi

materiali che contiene.

Che conseguenze operative ha questa nuova centralità della conoscenza nella produzione?Questo spostamento della produzione (di valore) dal versante

materiale a quello immateriale ha grandi conseguenze sul

modo con cui deve essere organizzato il sistema produttivo,

per creare ricchezza ed acquisire vantaggi competitivi rispetto

ad altri. La nuova giovinezza delle reti tra imprese discende,

appunto, da questa premessa.

Le reti servono infatti a sfruttare al meglio una caratteristica

fondamentale dell’immaterialità: la conoscenza è una risorsa

che – al contrario delle risorse materiali – non si consuma

con l’uso e che può essere riprodotta a costo zero (se

perfettamente codifi cata) o a costi comunque largamente

inferiori ai costi di (prima) produzione, nel caso che essa

rimanga implicita o dipendente dal contesto e dalle persone

che la possiedono. In una rete in cui le conoscenze di

ciascuno possono essere messe al servizio di tutti gli altri, la

propagazione diventa una fonte importante di valore aggiunto,

per tutto il sistema, perché l’apprendimento fai-da-te che

sarebbe necessario se ciascuno agisse isolatamente – con

i costi, i tempi e i rischi necessari – si traduce in una forma

di apprendimento collettivo che ha costi, tempi e rischi molto

inferiori. Oggi, per produrre valore non basta infatti fare

onestamente il proprio mestiere (come in passato facevano

l’artigiano, il fabbro, il lavoratore tradizionale), ma occorre:

1) avere buone idee (innovazione);

2) moltiplicarne l’uso (propagazione).

Sono questi due i nuovi mestieri che alimentano la

generazione del valore e di conseguenza la crescita

economica.

Se Apple ha oggi la quotazione di borsa che ha, è perchè

Steve Jobs ha avuto buone idee, che ha portato avanti con

determinazione; ma è anche perché le ha plasmate in forme

moltiplicabili (l’iPhone, l’iPad ecc.), riuscendo a realizzare

milioni di ri-usi. E in questo ampio bacino di ri-uso, defi nito

che non

SI TRATTA DI METTERE CONSAPEVOLMENTE, E SENZA RIMPIANTI, UNA DISTANZA TRA PASSATO E FUTURO, CHE RIVEDE CRITICAMENTE IL PRIMO E PREPARA INTENZIONALMENTE IL SECONDO.

24

DICEMBRE 2012

dai volumi degli apparecchi proposti al consumo, ha attratto

i venditori di musica (una canzone scaricabile a 0,99 dollari)

e i produttori di applicazioni (per lo store Apple delle apps).

Moltiplicando in questo modo anche il valore delle canzoni e

delle applicazioni agganciate all’iPhone.

Le reti di impresa formali e informali nella nuova era.Per allargare il bacino di ri-uso e ottenere grandi

moltiplicatori, l’essenziale – come abbiamo detto – è la

propagazione della conoscenza, trasferendola dal suo

contesto di origine a molti possibili users.

Questa propagazione deve appoggiarsi a regole e canali

che rendano effi ciente il passaggio delle conoscenze dal

produttore ai molti utilizzatori e soprattutto che rendano

conveniente, per le diverse parti in causa, la prosecuzione

del processo nel corso del tempo.

Da questo punto di vista, è importante notare che sia il

mercato (lo scambio di merce contro un prezzo) che la

gerarchia (il trasferimento realizzato all’interno alla grande

impresa, sotto il comando del vertice) sono poco effi cienti

quando si tratta di trasferire la conoscenza. Il libero scambio

di mercato, infatti, porterebbe il prezzo della conoscenza

(codifi cata) rapidamente verso lo zero (ossia verso il livello

del costo di riproduzione), ragion per cui – per evitare

questo esito – si deve disciplinare lo scambio di conoscenze

attraverso vincoli (il brevetto, il diritto di autore ecc.) che ne

riducono artifi cialmente il bacino di propagazione e che fanno

sorgere tutta una serie di controindicazioni (soprattutto in

presenza di Internet).

Restrizioni analoghe devono essere accettate se si pensa

a propagazioni per via gerarchica, all’interno della grande

impresa: la conoscenza deve essere auto-prodotta (con

scarso uso della conoscenza altrui) e auto-sfruttata

all’interno, con i costi, i tempi e i rischi conseguenti a questa

limitazione del bacino di approvvigionamento e di uso.

La rete, nel capitalismo globale della conoscenza di oggi

consente di andare oltre i limiti della propagazione di puro

mercato e di quella realizzata all’interno della grande impresa.

Creando una piattaforma collaborativa tra imprese dotate di

storie e competenze diverse, la rete consente di realizzare

forme di condivisione delle conoscenze molto vantaggiose

(per la co-innovazione, per la specializzazione reciproca, per

l’estensione del bacino di vendita), senza perdere il controllo

di quanto messo a disposizione di altri.

Nella rete si può infatti scambiare o cedere le proprie

conoscenze all’interno di una cornice fi duciaria e contrattuale

che garantisce impegni reciproci, in modo da ridurre di molto

il pericolo di comportamenti opportunistici.

Le tre forme di propagazione (mercato, gerarchia, rete) sono

in realtà complementari e co-esistenti: il mercato può essere

un mezzo veloce di propagazione per diffondere conoscenze

“protette” (dalla proprietà intellettuale) o comunque non

strategiche. La gerarchia interviene nelle relazioni in cui

occorre mantenere un controllo diretto e centralizzato sulla

catena cognitiva, anche a costo di sostenere investimenti

Membro di svariati comitati scientifi ci (tra i quali quello del Centro Studi di Confi ndustria e di Symbola), ha insegnato anche presso le università Ca’ Foscari di Venezia, Vita-Salute San Raffaele, Milano e Bocconi.

Tra i suoi temi di ricerca: economia della conoscenza, crisi della modernità, innovazione e produttività, reti di impresa, drivers dello sviluppo nel capitalismo globale della conoscenza, lavoro, management e formazione nell’impresa postfordista, terziario innovativo e sentieri di sviluppo dell’economia italiana, impresa e istituzioni nella transizione attuale, il territorio tra dimensione locale e mondializzazione, evoluzione dei distretti industriali e delle imprese multinazionali.

Tra i suoi libri: La fabbrica dell’immateriale. Produrre valore con la conoscenza (Roma 2004); Il capitalismo personale. Vite al lavoro (con A. Bonomi, Torino 2005); Innovare. Re-inventare il Made in Italy (con M. Plechero, Milano 2007); Modernità sostenibile. Idee, fi liere e servizi per uscire dalla crisi (Venezia 2010); Reti di impresa e idee motrici, QP, Quaderni della Programmazione n. 27 (con Francesca Pedon), Università di Trento e Provincia autonoma di Trento, Trento, 2011; Innovazione e produttività. Alla ricerca di nuovi modelli di business per le imprese di servizi, Angeli, Milano, 2012 (con Cantù C., Paiola M., Prandstraller F., Sebastiani E.); L’innovazione nelle imprese agricole. Usi nuovi della conoscenza, Veneto Agricoltura, Legnaro, 2012 (con altri autori).

Enzo Rullaniprofessore di Economia della conoscenza presso la Venice International University

25

rilevanti, assumendone il rischio relativo. La rete occupa la

Terra di Mezzo tra le due polarità classiche, intervenendo

in tutte quelle situazioni in cui la condivisione – se bene

organizzata – genera valore, grazie all’uso del collante

collaborativo.

Questa Terra di Mezzo si va espandendo sempre di più, man

mano che le imprese si trovano nella necessità di limitare

investimenti e rischi, focalizzandosi su una core competence

limitata e ricorrendo, per tutto il resto, a fi liere sempre più

estese e articolate, regolate dal mercato o più spesso da

rapporti stabili di collaborazione.

In Italia abbiamo avuto esperienza di questa diffusione di

reti che, pur rimanendo informali, legano fornitori e clienti in

rapporti di stabile collaborazione (fi liere), o che addensano

le imprese di un settore in un particolare luogo (distretto

industriale), facendo sì che il territorio diventi fattore

produttivo perché fornisce alle imprese gli uomini, i servizi e

le conoscenze che servono a certi usi. In altri casi, le reti sono

nate invece dalla condivisione di una matrice intellettuale e

professionale, fatta da università e centri di ricerca (si pensi al

rapporto tra la California e le imprese del settore ICT).

Quando questi rapporti di collaborazione stabile tra imprese

diverse e complementari comportano impegni di investimento

di rilievo, è inevitabile che l’informalità della relazione venga

integrata o sostituita da una formalizzazione contrattuale

e giuridica. In passato abbiamo avuto esempi di questa

formalizzazione attraverso strutture collaborative formalizzate

come le cooperative, i consorzi, le Associazioni Temporanee

di Impresa (ATI, per le gare pubbliche), le joint ventures e le

alleanze tecnologiche.

Da qualche anno è entrato a far parte della normativa

italiana anche il “contratto di rete”: un contratto in cui un

certo numero di imprese mette a fuoco un progetto comune,

associandovi un organo di governo e – volendo – un fondo

patrimoniale. In alternativa si possono costituire reti con altre

forme giuridiche come la Srl di scopo, il franchising, la licenza

di uso di un brevetto o di una soluzione tecnica, gli scambi

azionari o dei processi di vera e propria fusione.

I servizi innovativi e tecnologici come asset per rifondare le dinamiche del mercato anche del manifatturiero.Se le imprese del made in Italy devono entrare a far parte

di fi liere globali e investire nella produzione di conoscenze

o relazioni esclusive, che altri non hanno e non possono

facilmente imitare, è gioco forza immaginare che una

trasformazione del genere non può essere addossata

sulle spalle delle tante piccole e piccolissime imprese

che hanno una esperienza limitata alla fabbricazione del

prodotto materiale. L’industria deve, in altri termini, diventare

intelligente, facendo spazio al lavoro cognitivo e agli assets

immateriali. Si pensi alla rivoluzione ICT in corso e alla sua

proiezione a scala planetaria.

Nei paesi in cui la produzione industriale è realizzata, in

prevalenza, da grandi imprese, l’intelligenza che serve per

questa trasformazione sarà ottenuta investendo nel sapere e

nelle competenze interne dell’impresa. Non esclusivamente,

certo, ma in modo prevalente. Ogni impresa si preoccuperà

di rafforzare il management, la ricerca e sviluppo, il sistema

ERP, il marketing e la distribuzione, e, in generale, le

professionalità qualifi cate dei propri dipendenti.

Ma in un paese come l’Italia, dove la dimensione media

delle imprese manifatturiere è intorno ai 10 addetti, la strada

percorribile è un’altra: bisogna sviluppare una rete di imprese

di servizi, che, sulla base di un rapporto collaborativo stabile,

fornisca alle imprese manifatturiere esistenti le conoscenze

e le relazioni necessarie, avendo la possibilità di servire non

un solo cliente, ma dieci o cento, fi no a raggiungere la scala

necessaria dei ri-usi.

Le reti di impresa hanno un ruolo critico anche sotto questo

versante: devono mettere insieme, nelle fi liere e nei territori,

non solo grandi e piccole imprese, ma anche manifattura e

servizi avanzati.

LA RETE, NEL CAPITALISMO GLOBALE DELLA CONOSCENZA DI OGGI CONSENTE DI ANDARE OLTRE I LIMITI DELLA PROPAGAZIONE DI PURO MERCATO E DI QUELLA REALIZZATA ALL’INTERNO DELLA GRANDE IMPRESA.

incontri con

26

DICEMBRE 2012

Me ne rendo perfettamente conto. In un paese in cui i valori

(qualsiasi cosa si intenda con questo termine delicato e

scivoloso) sono tradizionalmente rappresentati e tutelati da

umanisti o prelati, sostenere pubblicamente – come ho fatto

qualche anno fa – che la “tecnologia ci rende umani” – non

poteva che suonare a molti come una provocazione. E, infatti,

così andarono le cose. Dibattiti, polemiche, accuse: insomma,

tutto quel che serve alle idee per vivere, circolare e magari,

ogni tanto, contribuire a scalfi re pregiudizi così diffusi e radicati

da essere persino considerati ideali universali.

Ma ora – complice l’uscita del primo numero di Logyn – credo

sia giunto il momento di ribadire e rilanciare. E non certo per

il gusto di irritare le sensibilità altrui. Al contrario, lo scopo

è quello di sottolineare con un piccolo contributo l’urgenza

di insuffl are nel dibattito culturale italiano quel minimo di

educazione scientifi ca senza la quale è diffi cile comprendere

la complessità della società contemporanea. Figuriamoci

affrontarla...

E dunque, mi concederò la libertà (che per alcuni sarà una

licenza) di avanzare una proposta: se davvero vogliamo – come

da più parti si auspica – provare a immaginare un nuovo

umanesimo, allora dobbiamo cominciare a pensare con le macchine. Ovviamente, come si avrà modo di appurare nella

lettura del presente articolo, l’intento non è quello di voler

“ridurre” (o addirittura “sostituire”) la facoltà e l’esercizio del

pensiero con le funzionalità operative di macchine sempre più

performanti.

Si tratterà piuttosto di mettere in luce alcuni aspetti

dell’intricato rapporto tra uomo e macchina per indagare

alcune delle dinamiche entro cui ha preso forma il nostro

modo di agire e pensare sulla scena del grande teatro del

mondo. Un percorso attraverso cui – mi auguro – si possa

PENSARE CON LE MACCHINE! È LA TECNOLOGIA CHE CI RENDE UMANI... STEFANO MORIGGI

2727

Si occupa di teoria e modelli della razionalità, di fondamenti della probabilità, di pragmatismo americanocon particolare attenzione al rapporto tra evoluzione culturale, semiotica e tecnologia.Già docente nelle università di Brescia, Parma, Milano e presso la European School of Molecular Medicine (SEMM), attualmente svolge attività di ricerca presso l’Università degli Studi di Milano Bicoccae l’Università degli Studi di Bergamo.Esperto di comunicazione e didattica della scienza, è consulente scientifi co Rai e su Rai 3 è uno dei volti della trasmissione “E se domani. Quando l’uomo immagina il futuro”. Tra le sue pubblicazioni si ricordano: “Le tre bocche di Cerbero. Il caso di Triora. Le streghe prima di Loudon e Salem” (Bompiani, 2004); (con E. Sindoni) “Perché esiste qualcosa anziché nulla? Vuoto, Nulla, Zero” (Itaca 2004); con P. Giaretta e G. Federspil ha curato “Filosofi a della Medicina” (Raffaello Cortina, 2008). Più recentemente (con G. Nicoletti) ha pubblicato “Perché la tecnologia ci rende umani. La carne nelle sue riscritture sintetiche e digitali” (Sironi, 2009); (con A. Incorvaia) “School Rocks. La scuola spacca”, (San Paolo, 2011).

Stefano Moriggi

storico e fi losofo della scienza

intuire l’importanza di una discussione pubblica, informata (e

possibilmente non ideologica!) su rischi e opportunità impliciti

nel progredire delle scienze e delle tecnologie.

Ma procediamo per gradi, magari con un paio di quesiti rivolti

in particolare a coloro che sono impegnati a proteggere una

“umanità” sempre più minacciata dalla “tecnoscienza” in un

inviolabile tabernacolo concettuale (oltre che fi sico).

Di cosa si parla davvero quando si parla di umanità? E da dove

provengono le convinzioni etiche e culturali stratifi cate nel

tempo attorno a questa idea?

Domande di questo tipo se le poneva già a suo tempo il grande

logico e matematico inglese Alan Mathison Turing – lui che a

soli venticinque anni compilò un manifesto del nuovo ordine

tecnologico (On computable numbers) e che nel 1943, mentre

dava il meglio di sé tra le mura del laboratorio di Bletchley Park

per realizzare le macchine che sarebbero riuscite a decrittare

il linguaggio in codice dell’aviazione e della marina tedesca

(Enigma), confi dava al collega Donald Bayley il suo sogno di

“costruire un cervello”. In altre parole, una macchina pensante...

Alan sapeva bene che la sua ambizione sarebbe stata percepita

dai più come un nuovo peccato originale, come l’ennesima

imperdonabile tracotanza di chi vuole replicare il gesto di Dio.

Nel suo ormai classico Macchine calcolatrici e intelligenza (1950), infatti, prendeva amaramente atto di quanto diffusa e

culturalmente trasversale fosse l’idea per cui “ci piace credere

che l’uomo sia in qualche modo misterioso, superiore al resto

del creato”. E per i palati più raffi nati, tale misteriosa superiorità

di Homo sapiens era invece declinata da irreprensibili baluardi

dell’umanità come “il potere del pensiero”. Costoro – scriveva

Turing – “sono più inclini a basare la loro credenza nella

superiorità dell’uomo proprio su questo potere”.

Di fronte a siffatti tentativi di salvaguardare dietro un’aura di

mistero l’inviolabile superiorità/integrità dell’umano, Turing si

limitava a osservare che tale approccio non fosse abbastanza

solido da meritare una confutazione, e che semmai “sarebbe

più appropriata una consolazione”. Per lui erano solo le

obiezioni di chi ha la “testa nella sabbia”. E come contraddirlo?

Non si tratta qui di contrapporre a tanta diffi denza i meriti delle

macchine di Alan Mathison, grazie a cui dal 1943 in avanti

gli alleati furono in grado di decifrare i messaggi in codice del

nemico, battendolo sistematicamente sul tempo (non a caso

Turing, vinta la guerra, fu insignito per la sua opera di una

prestigiosa onorifi cenza militare dal governo britannico). Infatti,

non è in questione l’uso e l’utilità della tecno-scienza – ai

successi del gruppo di Bletchley Park si potrebbero, fi n troppo

facilmente, contrapporre le tragiche conseguenze del progetto

Manhattan. In gioco sono, invece, i signifi cati più profondi della

relazione uomo-macchina, e le dinamiche che intrecciano

l’evoluzione di strumenti e dispositivi con i modi in cui di epoca

in epoca siamo stati – e ci siamo detti – umani.Chi preferisce mantenere la testa nella sabbia fatica a intuire,

per esempio, che riprodurre artifi cialmente (sperimentalmente)

un fenomeno naturale signifi ca anzitutto comprenderlo. Le

macchine non sono solo strumenti per fare, ma anche per

pensare. Sognare di costruire un cervello, ovvero una macchina

in grado di simulare alcune delle funzioni cognitive dell’essere

umano, non è un atto che trasuda tracotanza. Al contrario,

testimonia l’umile sforzo di chi, per tentativi ed errori, cerca di

sviluppare e perfezionare concreti modelli di comprensione del

mondo. Riprodurre il corpo da un’articolazione alle reti neurali

– al di là delle potenziali ricadute biomediche o informatiche

– incarna lo sforzo di quel sapere pubblico, rivedibile e

controllabile (che è la scienza moderna) di interrogare la natura

(in questo caso umana) per intuirne le leggi.

28

DICEMBRE 2012

La resistente diffi denza a pensare con le macchine – per

lo meno nei termini sopra indicati – è il sintomo della grave

carenza di cultura ed educazione scientifi ca (e tecnologica) che

dovrebbe essere bagaglio comune non solo dei professionisti

della ricerca ma di ogni cittadino che voglia dirsi tale – e

dunque libero di comprendere per scegliere criticamente –oproprio in una società in cui, sempre più, molti dei suoi diritti

(oltre che molti dei suoi doveri) sono stati ridefi niti proprio dai

progressi della scienza e dalla pervasività della tecnologia.

E non solo i diritti...

Infatti, questo è il punto. Ovvero, l’impatto concreto e culturale

di una tecnologia dilagante che suscita timori; semina angoscia

e soprattutto continua a eccitare la fervida immaginazione

di numerosi profeti di sventura che dalla carta stampata

agli schermi televisivi, dalle cattedre universitarie ai pulpiti,

declinano – ciascuno a suo modo – l’eclissi dell’umano,

predicando ricette e rimedi per cercare di salvare in qualche

modo anime e corpi. C’è chi insegue il nomos della Terrasnel giardinetto della propria villetta a schiera, chi propone

moratorie contro l’uso (e l’abuso) di computer e telefonini

responsabili di ridurre ogni relazione in connessione, e chi

insiste a riproporre vecchi adagi fi losofi ci contro la tecnica,

rimpiangendo antichi modi di abitare “poeticamente” il mondo.

Nulla da obiettare, ovviamente, su scelte e idiosincrasie di

ciascuno, ma come ha recentemente notato il sociologo

francese Gilles Lipovetsky, l’ansiogeno dilagare di questo

variopinto “immaginario sociale del prodotto genuino”, dai

bisogni più frivoli (viaggi nelle terre selvagge, revival del

vintage, menu a chilometro zero) fi no alle convinzioni e

credenze più complesse (parlar chiaro in politica, ricerca

spasmodica di radici culturali e spirituali, vivere “secondo

natura”) è comprensibile nei termini di una nostalgia verso un

passato idealizzato da contrapporre a stili di vita costantemente

riscritti dall’evoluzione tecnico-scientifi ca.

Alla “contraffazione” tecnologica si cerca di rimediare con

l’“autenticità” della natura; alla fallibilità del sapere scientifi co

si tende a preferire la rassicurazione del valore indiscutibile

e assoluto. Ma l’equivoco di fondo – osserva a ragione

Lipovetsky – sta nel fatto che “l’autentico non è il contrario

dell’ipermoderno: è solo una delle sue facce, una delle

manifestazioni del nuovo volto del benessere, il benessere

emotivo, carico di attese sensibili e risonanze culturali e

psicologiche”. I nipotini (più o meno consapevoli, più o meno

raffi nati) di fi losofi come Jean Jacques Rousseau e Martin

Heidegger potrebbero quanto meno sperimentare una

prospettiva alternativa, qualora facessero proprio – almeno per

qualche istante – un approccio meno “epocale” (per non dire

apocalittico) al mondo della civilizzazione e della tecnologia.ooMagari spingendosi persino a contemplare l’ipotesi che anche

la ricerca scientifi ca, l’innovazione tecnologica – e dunque

anche la cultura d’impresa – siano pratiche portatrici di

signifi cati e valori più di quanto si sia disposti ad ammettere.

Come? Di nuovo, si tratterebbe di provare a pensare con le macchine, questa volta però facendo particolare attenzione

alla storia e all’evoluzione del rapporto tra individui, strumenti

e ambiente. E allora, come soprattutto la genetica delle

popolazioni e l’evoluzione culturale magistralmente mostrano,

sarebbe più agevole intuire che strumenti e macchine hanno

da sempre articolato e riplasmato azioni e consuetudini di

individui, gruppi, comunità e società. Il che, di conseguenza,

ha permesso e defi nito nuove etiche e, più in generale, inediti

quadri concettuali che hanno contribuito a riscrivere signifi cati

e valori, compreso il modo stesso di dirsi (oltre che di essere)

umani. A tal proposito, ha colto nel segno l’esperto di mass media Derrick De Kerckhove quando – proprio ragionando sulleapiù avanzate tecnologie della comunicazione – scriveva che noi siamo la continua reinvenzione delle nostre stesse invenzioni. In

altre parole, ciò signifi ca che siamo animali culturali; e la cultura

(tecnoscienza compresa, ovviamente!) incarna il più effi cace e

rapido complesso di strategie di adattamento all’ambiente.

Altro che provocazione, quindi! La tecnologia ci ha reso – e

ci rende umani – nei modi in cui ha consentito – e consente

– relazioni e interazioni sempre più complesse e pregnanti in

cui cogliere quell’intreccio di strumenti e signifi cati che molto

racconta della nostra natura e della nostra storia.E per tornare al “potere del pensiero” quale misteriosa

e inviolabile superiorità dell’essere umano, mi limito a

far osservare che al di fuori di questa interazione uomo-

strumento-ambiente diffi cilmente avremmo sviluppato la

capacità di render conto delle cose del mondo riconducendo gli

effetti alle rispettive cause, tanto nella ricerca scientifi ca quanto

nell’esperienza quotidiana.

“I nostri progenitori – ha osservato di recente il neuroscienziato

Giorgio Vallortigara – avrebbero iniziato a sviluppare nozioni

di causa-effetto, perfezionandole via via nel corso dei due

milioni d’anni in cui inventarono la tecnologia”. Lo sviluppo

dell’architettura celebrale in grado di concettualizzare nessi

causali e spiegazioni di fenomeni sempre più complessi

sarebbe quindi anche il risultato di quella relazione pratica

e concettuale che i nostri progenitori hanno intrattenuto

con gli strumenti che hanno accompagnato l’evoluzione

delle loro pratiche e dei loro pensieri. Pare ancora tanto

scandaloso l’invito a pensare con le macchine? E sostenere

che la tecnologia ci rende umani? Lascio a chi legge l’onere

della risposta. Ma continuo a ritenere che nessun nuovo

“umanesimo” sarà possibile se, per dirla ancora con Turing,

continueremo a tenere la “testa nella sabbia”, invece che

confrontarci seriamente con l’idea che tecnologicamente abita

(vive e pensa) l’uomo.

29EMC2, EMC, and the EMC logo are registered trademarks or trademarks of EMC Corporation in the United States and other countries. © Copyright 2011 EMC Corporation. All rights reserved.

BIG DATATRANSFORMS BUSINESS

30

DICEMBRE 2012

QUANDO IL CLIENTE CHIAMA

Nel corso dell’anno 2011 Eurosystem entra in contatto con

un potenziale cliente, una società che vanta competenze di

primo livello nel project management e nella costruzione di

impianti. L’Azienda, che aveva appena iniziato la “software

selection”, aveva confrontato le proposte di diversi

competitors, valutando prodotti ERP (Enterprise Resource

Planning) sia nazionali sia internazionali. Date le esigenze di

alta personalizzazione della soluzione, aveva anche ipotizzato

di far costruire “ex novo” un software su misura.

Eurosystem ha raccolto, tra le altre aziende a confronto, le

richieste del Cliente che, come spesso accade, era in cerca di

una soluzione non ancora ben identifi cata e dai requisiti molteplici. Alla base delle linee guida indicate i seguenti problemi: un

software gestionale datato, privo di un modulo specifi co sulla

gestione di commessa/progetto, un metodo di lavoro basato

su fl ussi non automatizzati e supportati da una gestione della

documentazione quasi totalmente cartacea.

In termini di organizzazione del lavoro, tutto questo si

traduceva nell’assenza di regole defi nite per la condivisione

delle informazioni, possibili criticità e ampi margini di errore

nella gestione delle commesse cliente, un dispendio oneroso di tempo ed energie delle risorse interne.

L’implementazione di un nuovo sistema informativo può diventare l’elemento strategico del business

di un’azienda. Non un semplice cambio di gestionale, ma l’occasione per rivedere e migliorare

i processi aziendali, riqualifi care sia il personale che la base dati, nonché aumentare la condivisione

della conoscenza in azienda.

Creatività e fl essibilità made in Italy alla base dei risultati Eurosystem

COME NASCEUN CASO DI SUCCESSO

STEFANO BIRAL [email protected]

31

storiesL’Azienda chiedeva, insomma, una tecnologia

altamente personalizzata con specifi ci requisiti di base,

funzionali e tecnologici in grado di risolvere tutte le sue

problematiche.

Tra i requisiti di base, si richiedeva l’utilizzo di una

soluzione web-based che avrebbe dovuto incontrare

le esigenze di utenti non sempre abituati all’utilizzo

di un sistema gestionale; l’implementazione di

un modulo di gestione commesse/progetti; un

Workfl ow Management System per informatizzare

la gestione dei processi e, infi ne, l’integrazione con

un sistema di reportistica basato su strumenti di

Business Intelligence. Per i requisiti funzionali, era

necessario fornire una soluzione multi azienda e multilingua all’interno dello stesso sistema ERP; in

grado di tracciare l’attività degli utenti al fi ne di poter

identifi care responsabilità nell’utilizzo dei dati aziendali;

con politiche di autenticazione e di autorizzazione

all’accesso ai dati in funzione del ruolo aziendale; e,

infi ne, un’interfaccia di facile utilizzo.

La tecnologia alla base del sistema doveve essere

facilmente integrabile con le altre componenti software esistenti, scalabile a tal punto da garantire

robustezza anche in previsione di un elevato aumento del numero utenti e del volume dei dati; con un’architettura di base consolidata e robusta;

parametrizzabile e capace di adattarsi anche alle

esigenze future dell’azienda; tale da permettere

l’ampia autonomia del cliente nella confi gurazione del software. Un progetto non semplice e che ha

richiesto l’unione di competenze altamente qualifi cate,

tecnologie all’avanguardia e un approccio consulenziale

focalizzato sulle esigenze di rinnovamento del cliente,

garantendo il successo della soluzione proposta.

Eurosystem e il proprio ERP esteso Freeway® Skyline sono stati, infatti, scelti per supportare

l’Azienda nel cambio del proprio sistema informativo,

distinguendosi per l’aderenza della soluzione alle

esigenze manifestate e la capacità di adattarsi a

quelle future, una tecnologia innovativa e l’affi dabilità

riconosciuta del Gruppo.

Si valorizzano così l’informazione e la persona, che sono il vero patrimonio di ogni azienda.

32

DICEMBRE 2012

E IL CONSULENTE RISPONDE

Il primo obiettivo di progetto era ottimizzare i processi

aziendali senza forzare cambiamenti organizzativi poco

sentiti. Il software doveva adattarsi alle logiche di processo e

agli utenti dell’Azienda (e non il contrario), sempre nell’ottica

di migliorare le ineffi cienze presenti.

Seguendo una metodologia di Business Process Management (BPM), i consulenti dell’azienda trevigiana

si sono concentrati sui processi interni, li hanno ridisegnati

defi nendo i fl ussi principali da automatizzare con un motore

di workfl ow, hanno sviluppato piccoli prototipi sulle aree di

maggiore interesse del Cliente.

Un’operazione di analisi dettagliata, realizzata attraverso

interviste ai referenti aziendali, che ha permesso di avere una

visibilità di progetto chiara con una certezza dei costi e dei

tempi di avviamento.

L’informatizzazione dei fl ussi di lavoro ha permesso di

defi nire i criteri di assegnazione delle attività, le regole per i

passaggi di stato e di autorizzazione. In particolare, grazie a

Freeway® Workfl ow Server, asse portante della soluzione

e piattaforma di supporto alle metodologie del BPM, la

lista delle attività di approvazione documenti o le fasi di

un processo di collaborazione tra gli utenti sono state rese

accessibili all’utente sotto forma di working list o di semplici

notifi che: in questo modo, il software ha consentito di far

arrivare l’informazione giusta alla persona giusta.

A supporto del motore di workfl ow, è stato implementato

Freeway® Document Server, un sistema di archiviazione

documentale integrato nelle fasi di inserimento delle

informazioni e nei processi di collaborazione aziendale

(workfl ow) che ha ridotto notevolmente l’utilizzo della carta. Infi ne, con l’adozione di uno specifi co modulo di

Freeway® Skyline di gestione commessa/progetto si è

reso possibile all’azienda gestire nativamente l’intero iter

delle commesse clienti, a partire dall’offerta, al budget

commerciale e tecnico, al piano di progetto e specifi che

di contratto, fi no ad arrivare ad una snella ed automatica

consuntivazione dei costi.

Questo ha permesso di ottimizzare il livello di comunicazione e coinvolgimento di tutte le risorse che

fanno parte di un progetto, anche se appartenenti ad aree

aziendali diverse, permettendo un monitoraggio continuo

sull’avanzamento dei lavori e una visualizzazione immediata

tra quanto preventivato e l’effettivo stato dell’arte della

commessa.

Il secondo obiettivo da raggiungere per mantenere fede

all’impegno preso con il Cliente era quello di migliorare la

...valorizzandone le specifi cità, le fl essibilità e le differenze, nonché la creatività tipica delle aziende italiane di successo.

33

condivisione della conoscenza in azienda. Era necessario creare dei percorsi di navigazione tra le

informazioni mirati per ciascun utente, sia interno che

esterno, e basati sull’utilizzo di profi li aziendali specifi ci.

Per rispondere a questa richiesta, Eurosystem ha realizzato

un Portale personalizzato, con la funzione di unico punto di

accesso ad applicazioni, processi, dati, documenti, persone.

La teconologia innovativa alla base del portale è Freeway® Presentation Server, una piattaforma server per progettare

portali personalizzabili per ruolo e utente.

Grazie ad essa e alla creazione di Profi li opportunamente dedicati ai diversi livelli di utenza (direzione, manager/

responsabili, operativi, collaboratori interni ed esterni),

l’uso delle applicazioni e l’accesso alle informazioni è

stato reso molto più semplice, nell’ottica di un’attenzione

sempre maggiore alla qualità dell’esperienza utente (User eXperience) e all’ottimizzazione di tempo e risorse interne.

Con la tecnologia implementata è possibile impostare per

ogni profi lo utente una home page personalizzata che

visualizzi da subito i dati e le informazioni più importanti della

propria attività. In questo modo, dall’informazione si arriva

al singolo dato e, se necessario, al modulo applicativo che

ha generato quel dato, ma non viceversa. Si valorizzano così

l’informazione e la persona, che sono il vero patrimonio di

ogni azienda.

L’azienda Cliente ha così potuto disporre di un sistema informativo integrato ed intuitivo, con la possibilità di

utilizzare, in autonomia, strumenti di analisi per generare

report direzionali e cruscotti aziendali (Decision Support

System) e poter monitorare tutti gli aspetti dell’azienda,

avvalendosi delle conoscenze acquisite nel corso del progetto

dal proprio personale tecnico od operativo.

DAL PRODOTTO SOGNATO A QUELLO REALIZZATO

Freeway® Skyline ha consentito di superare i benefi ci

attesi e di raccogliere gli obiettivi di progetto, favorendo

l’introduzione di sistemi e moduli standard, adattandosi alle

particolari esigenze del Cliente e superando le molte criticità

identifi cate durante la gestione. La parametrizzazione del

sistema ha reso la soluzione software un vero “vestito su

misura” adattato alla realtà aziendale, senza irrigidirla, anzi,

valorizzandone le specifi cità, le fl essibilità e le differenze,

nonché la creatività tipica delle aziende italiane di successo.

Come nasce un caso di successo? Oggi sono la fl essibilità e la versatilità, anche nei progetti software, a fare la

differenza. Questo, è un concetto che va al di là della mera

possibilità, che hanno i sistemi, di poter essere componibili

o preconfi gurati: qualcosa che consente a ciascuno di far

coincidere il prodotto sognato con quello realizzato.

Oggi sono la fl essibilità e la versatilità a fare la differenza.

stories

34

DICEMBRE 2012

In questo particolare momento storico in cui la crisi del

sistema economico globale sta impattando notevolmente il

modo di fare impresa, l’attività del recupero crediti svolge

un ruolo determinante diventando un elemento in grado di

dare equilibrio ai bilanci delle società, migliorando i fl ussi

di cassa e la liquidità aziendale. Così come le banche e le

società fi nanziarie, oggi molte aziende considerano fi siologica

e “preventivata” una percentuale di insoluti, e per evitare di

dedicare risorse interne al recupero del credito, si affi dano

all’outsourcing per la gestione delle pratiche.

Tra le molte società che operano nel settore del recupero

crediti, quelle che hanno conquistato la leadership si

differenziano per l’elevato livello di specializzazione e per

l’alta percentuale di risultati positivi, ma non solo.

Anche la componente tecnologica, ovvero l’infrastruttura

telefonica e dati necessaria per erogare i servizi offerti, gioca

un ruolo decisivo.

Ed è stata proprio questa consapevolezza a spingere Recus

Spa, da circa 20 anni una delle più importanti realtà italiane

nei servizi di Recupero Crediti, verso l’adozione di una

soluzione tecnologica all’avanguardia in grado di garantire

idonea potenza elaborativa, estrema fl essibilità in funzione

delle necessità del momento e continuità del servizio.

“Sin dagli inizi – esordisce Luca Cortesia, IT Manager

della società – Recus ha vissuto un progressivo e costante

sviluppo. Nell’ultimo quadriennio, in particolare, la società ha

triplicato il proprio organico arrivando oggi a superare i 250

utenti distribuiti nelle 5 sedi della società. Una evoluzione

che ha reso necessario un rinnovamento dell’infrastruttura

informatica, poiché quella precedente, pur costituita da

L’infrastruttura progettata da Sistemarca con soluzioni EMC garantisce prestazioni e continuità di

servizio per soddisfare le esigenze dei clienti, anche le più impegnative.

Per una più facile gestione del credito

RECUS: L’IT CHE FA LA DIFFERENZA

MASSIMO MANICA

35

sistemi ad alta affi dabilità in un ambiente virtuale, iniziava a

mostrare alcune criticità, non garantendo più le condizioni di

fl essibilità e sicurezza necessarie a supportare la crescente

mole di lavoro e il livello di redditività richiesto da importanti