S.Ackermann (MSc) - Estrazione automatica di elementi per l'aggiornamento cartografico da immagini...

Transcript of S.Ackermann (MSc) - Estrazione automatica di elementi per l'aggiornamento cartografico da immagini...

UNIVERSITÀ DEGLI STUDI DI NAPOLI

“PARTHENOPE”

FACOLTÀ DI SCIENZE E TECNOLOGIE

Corso di laurea in

SCIENZE NAUTICHE

TESI DI LAUREA

ESTRAZIONE AUTOMATICA DI ELEMENTI PER

L’AGGIORNAMENTO CARTOGRAFICO DA IMMAGINI TELERILEVATE

Relatori Candidato Chiar. Prof. Raffaele Santamaria Sebastiano Ackermann Matr. SN/599 Chiar. Prof. Salvatore Troisi

Anno Accademico 2005/2006

Indice

INTRODUZIONE 1 CAPITOLO 1 TELERILEVAMENTO: PRINCIPI BASE

1.1 - CENNI STORICI 3

1.2 - PRINCIPI FISICI 5 1.2.1 - GRANDEZZE RADIOMETRICHE 5

1.2.2 - LO SPETTRO ELETTROMAGNETICO 8

1.2.3 - FIRMA SPETTRALE 9

1.3 - SATELLITI PER IL TELERILEVAMENTO, SENSORI E DATI 12 1.3.1 - MEMORIZZAZIONE E VISUALIZZAZIONE DI IMMAGINI DIGITALI 12

1.3.2 - TELERILEVAMENTO SATELLITARE: IL SISTEMA DI OSSERVAZIONE DELLA TERRA 19

1.3.2.1 - IL BUS 19

1.3.2.2 - IL PAYLOAD 20

1.3.2.3 - SEGMENTO TERRESTRE 23

1.3.3 - CLASSIFICAZIONE TECNOLOGICA DEI SENSORI 25

1.3.3.1 - SENSORI OTTICI D’IMMAGINE 26

1.3.4 - PRINCIPALI PIATTAFORME IN USO PER IL TELERILEVAMENTO 32

1.3.4.1 - MISSIONI LANDSAT 32

1.3.4.2 - MISSIONI SPOT 35

1.3.4.3 - MISSIONI IKONOS 37

1.3.4.4 - MISSIONI QUICKBIRD 37

1.3.4.5 - MISSIONI EROS 38

CAPITOLO 2 ELABORAZIONE ED INTERPRETAZIONE DELLE IMMAGINI

2.1 - INTRODUZIONE 39

2.2 - L’IMMAGINE RASTER (IL DATO) 39

2.3 - PROCEDURE POST-ACQUISIZIONE 41

2.3.1 - CORREZIONI RADIOMETRICHE 42

2.3.2 - CORREZIONI GEOMETRICHE 48

I

Indice

2.3.2.1 - MODELLO GEOMETRICO ORBITALE 51

2.3.2.2 - GEOREFERENZIAZIONE 52

2.3.2.3 - ORTORETTIFICA DI UN’IMMAGINE DIGITALE 53

2.4 - IL RICAMPIONAMENTO 56

2.5 - ELABORAZIONE ED INTERPRETAZIONE DELLE IMMAGINI 58

2.5.1 - POSSIBILI VISUALIZZAZIONI DELL’IMMAGINE SU SCHERMO 59

2.5.2 - MIGLIORAMENTO DEI CONTRASTI MEDIANTE ELABORAZIONI SULLE BANDE 61

2.5.2.1 - IL CONCETTO DI CONTRASTO 61

2.5.2.2 - CONTRAST STRETCHING 61

2.5.2.3 - I FILTRI MEDIANTE FINESTRE MOBILI 63

2.5.2.4 - OPERAZIONI ALGEBRICHE TRA BANDE 66

2.5.2.5 - ANALISI DELLE COMPONENTI PRINCIPALI 67

CAPITOLO 3 SEGMENTAZIONE OBJECT-ORIENTED: IL SOFTWARE ECOGNITION®

3.1 - INTRODUZIONE 72

3.2 - LA SEGMENTAZIONE 73

3.3 - IL SOFTWARE ECOGNITION® 75

3.3.1 - PRINCIPI BASE DI FUNZIONAMENTO 75

3.3.2 - CARICAMENTO DELLE IMMAGINI 77

3.3.3 - MULTIRESOLUTION SEGMENTATION 79

3.3.3.1 - LIVELLI DI SEGMENTAZIONE CORRELATI 81

3.3.4 - CLASSIFICAZIONE 83

3.3.4.1 - NEAREST NEIGHBOR E STANDARD NEAREST NEIGHBOR 84

3.3.4.2 - LA LOGICA FUZZY 85

3.3.4.3 - CREAZIONE DELLE CLASSI 88

3.3.5 - LA VETTORIALIZZAZIONE DEGLI OGGETTI IMMAGINE 91

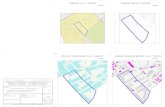

CAPITOLO 4 APPLICAZIONE DI ECOGNITION

® PER AGGIORNAMENTO CARTOGRAFICO: METODOLOGIE A CONFRONTO

4.1 - INTRODUZIONE 94

II

Indice

4.2 - DATI UTILIZZATI 94

4.3 - APPLICAZIONE DI ECOGNITION® 96

4.3.1 - 1a FASE: SEGMENTAZIONE 96

4.3.2 - 2a FASE: SCELTA DELLE FEATURES E CLASSIFICAZIONE 97

4.3.3 - 3a FASE: CONFRONTO CON CARTOGRAFIE PRECEDENTI E SEGNALA-ZIONE AUTOMATICA DI “MAN-MADE OBJECTS” 103

4.4 - UN METODO ALTERNATIVO DI CHANGE DETECTION MEDIANTE CONFRONTO TRA IMMAGINI DI EPOCHE DIFFERENTI 110

4.5 - CONCLUSIONI FINALI ED IPOTESI DI MIGLIORAMENTO 111

BIBLIOGRAFIA 113

RINGRAZIAMENTI 117

III

Introduzione Nel telerilevamento si fa uso di strumenti, o sensori, in grado di “catturare” le relazioni

spaziali e spettrali di elementi osservabili tipicamente dall’alto. Tutti noi siamo abituati a

guardare e ad esplorare il nostro pianeta, o meglio ciò che ci circonda, da un punto di vista

più o meno orizzontale vivendo sulla superficie del pianeta stesso: la limitazione dovuta alla

linea dell’orizzonte e ancor di più alla presenza di oggetti “ostacoli” quali edifici, alberi e la

stessa morfologia variabile del pianeta, fa si che la nostra vista sia ristretta a piccole aree. Ta-

le limite tende a diminuire nel momento in cui il punto di vista di un osservatore si eleva in

quota: osservando a 360° dalla cima di un grattacielo o di una montagna, la nostra visuale

aumenta si ampia notevolmente. Ma se prima il telerilevamento veniva inteso come un insie-

me di tecniche capaci di estendere e migliorare le capacità percettive dell’occhio umano, oggi

tale definizione sarebbe quasi inaccettabile: le moderne tecniche di tale disciplina, grazie an-

che all’immissione graduale nello spazio di satelliti artificiali orbitanti attorno alla Terra, avu-

tasi a partire dalla seconda metà del secolo scorso (fu l’avvento dello Sputnik nel 1957 difatti

a rendere possibile il montaggio delle prime macchine da presa su navicelle spaziali), hanno

ampliato il campo di indagine ben oltre le informazioni legate allo spettro elettromagnetico.

Oggi il telerilevamento, grazie all’esistenza di una grande quantità di strumenti, che si diffe-

renziano a seconda del loro utilizzo, ha rivoluzionato tutte quelle discipline che fanno parte

delle scienze della Terra, comprendendo tecniche di analisi della radiazione elettromagnetica

e dei campi di forze finalizzate ad acquisire ed interpretare dati geospaziali presenti sulla su-

perficie terrestre, negli oceani e nell’atmosfera [www.geotecnologie.unisi.it].

L’applicazione del satellite al telerilevamento del territorio in particolare, e il progresso

che ha portato al perfezionamento di sensori a più alte risoluzioni e di diverse tipologie, sta

trovando spazio anche per alcune applicazioni di competenza della fotogrammetria dei lonta-

ni, fino ad ora limitate all’utilizzo di riprese con sensori aerotrasportati. Così anche il campo

della cartografia, e di tutte quelle discipline atte alla rappresentazione del territorio, sta a-

prendo i propri orizzonti al telerilevamento satellitare, tecnica che sta profondamente cam-

biando i metodi di acquisizione di informazioni metriche e tematiche sull’ambiente e sul ter-

ritorio rendendo possibile l’utilizzo di tali informazioni anche per rappresentazioni cartogra-

fiche a media e grande scala.

1

Introduzione

Lo scopo di questo lavoro è quello di sperimentare una tecnica di estrazione semi-

automatica di oggetti (fondamentalmente strutture ad opera dell’uomo), tramite una nuova

metodologia di segmentazione ad oggetti (detta anche object-oriented o object-based), e suc-

cessiva classificazione, applicata ad un’immagine telerilevata ed ortorettificata, al fine di po-

ter ottenere un aggiornamento di una cartografia a scala nominale 1:5000.

A tal proposito, si è fatto uso di una particolare tecnica di classificazione, la logica fuzzy

(o logica sfumata), un’estensione della logica booleana che si basa sul concetto di “grado di

appartenenza”: secondo tale logica, non si ha più a che fare con proprietà assolutamente vere

(= al valore 1) o assolutamente false (= al valore 0) come nella logica classica appunto, ma si

vanno a considerare anche valori intermedi di appartenenza, che quindi vanno ad identificare

in che percentuale una proprietà possa o meno essere vera.

Il software Ecognition®, realizzato dalla DEFINIENS-IMAGING®, utilizzato per questa

sperimentazione, mette a disposizione dell’utente numerosi strumenti, oltre alla già citata lo-

gica Fuzzy, che verranno via via descritti: l’algoritmo base che si cela dietro questo software

pone le sue fondamenta sull’idea che l’informazione semantica, necessaria all’interpretazione

dell’immagine, non venga più data dal singolo pixel che compone l’immagine bensì da ogget-

ti che compongono l’immagine e dalla loro mutua connessione. Ciò è possibile grazie al fatto

che Ecognition® non classifica mediante la teoria del pixel-based, ma piuttosto, come già ac-

cennato prima, classifica oggetti basandosi anche sulla loro omogeneità.

Dopo una breve trattazione sui principi base del telerilevamento e della fotogrammetria,

ed una esplicativa sezione riguardante la logica fuzzy ed il funzionamento del software, si

presenterà un’applicazione effettuata con l’ausilio di tale software che consentirà di verificare

i risultati, i pro e i contro delle procedure utilizzate e di fare un quadro delle situazioni ottima-

li che possano in qualche modo rendere più efficiente tale tecnica.

2

Capitolo 1 TELERILEVAMENTO: PRINCIPI BASE

1.1 - CENNI STORICI

Il termine telerilevamento deriva dall’unione della parola greca têle, ovvero “da lontano”,

e dal termine rilevamento, che di norma indica un processo di acquisizione di informazioni

[Dermanis et al., 2002]. Da un punto di vista puramente etimologico, tale definizione, che

appare abbastanza generica, porta ad una naturale associazione del telerilevamento ad una

qualsivoglia metodologia di indagine scientifica; nella sua accezione più usuale però, il ter-

mine viene usato per indicare tutti i metodi che riguardano l’osservazione della Terra, metodi

che si rendono attuabili grazie alla radiazione elettromagnetica, principio fisico basilare gra-

zie al quale viaggiano le informazioni dall’oggetto di indagine al sensore.

Figura 1.1.1 - Immagine d’epoca di una mongolfiera equipaggiata con una camera fotografica

Si può dire che il telerilevamento ha inizio nel 1840, quando le mongolfiere acquisirono le

prime immagini del territorio con la camera fotografica appena inventata, primo sensore nella

3

Capitolo 1 Telerilevamento: principi base

storia ad avere la capacità di “raccogliere” su di un supporto sensibile le informazioni sulle

caratteristiche del terreno per mezzo della radiazione elettromagnetica (nella parte visibile

dello spettro elettromagnetico). Probabilmente alla fine dell’ultimo secolo la piattaforma più

nuova era la rinomata flotta di piccioni che operava come novità in Europa (vedi Figura

1.1.2).

Figura 1.1.2 - Piccioni adoperati per riprese aeree con camere fotografiche

La fotografia aerea diventò uno strumento riconosciuto durante la Prima Guerra Mondiale

e lo fu a pieno durante la Seconda: allo scopo di facilitare la produzione di carte tematiche,

furono introdotte, negli anni a seguire, le pellicole sensibili all’infrarosso (la Kodak commer-

cializzò questo tipo di pellicola a partire dal 1953) oppure si applicavano filtri davanti

all’obiettivo della camera da presa per poter osservare le singole bande dello spettro visibile.

L’entrata ufficiale dei sensori nello spazio cominciò con l’inclusione di una macchina fo-

tografica automatica a bordo dei missili tedeschi V-2 lanciati dalle White Sands (New Mexi-

co). Il 4 Ottobre 1957 e il 12 Aprile 1961 due eventi nella storia della conquista dello spazio

hanno indirettamente rivoluzionato anche il telerilevamento: il lancio dello SPUTNIK, il pri-

mo satellite nello spazio, e di Jurij Gagarin, il primo uomo nello spazio; gli esiti positivi di

queste due missioni resero successivamente possibile il montaggio di macchine da ripresa su

navicelle in orbita, ma furono proprio i primi cosmonauti ed astronauti a documentare con ri-

4

Capitolo 1 Telerilevamento: principi base

prese dallo spazio la circumnavigazione del globo. I sensori che acquisivano immagini in

bianco e nero sulla Terra furono montati su satelliti meteorologici a partire dal 1960. Altri

sensori sugli stessi satelliti potevano poi eseguire sondaggi o misure atmosferiche su una ca-

tena di rilievi.

Ma fu il lancio del primo dei sette satelliti LANDSAT (LAND SATellite) di proprietà della

statunitense NASA (National Aeronautic and Space Administration) che segnò la nascita del tele-

rilevamento moderno così come oggi lo intendiamo: lanciato il 23 Luglio 1972, fu il primo

satellite espressamente dedicato al monitoraggio di terre e oceani allo scopo di mappare risor-

se culturali e naturali. Dal 1986 anche la Francia, con la famiglia di satelliti SPOT (Satellite

Probatoire d’Observation de la Terre), entra appieno nel telerilevamento satellitare, ed oggi,

come una fitta ragnatela invisibile, circa un centinaio di satelliti orbitano intorno alla Terra,

parte dei quali espressamente dedicati al rilievo ed allo studio del nostro pianeta, ovvero al

telerilevamento.

Per “osservazione della Terra”, in questo contesto andremo ad indicare l’osservazione e

l’interpretazione delle diverse coperture della superficie terrestre; tale osservazione contiene

intrinsecamente due tipi di informazione: una di tipo qualitativa, che riguarda la tipologia di

copertura, ed una di tipo geometrica, che riguarda la posizione, la forma e i contorni delle di-

verse entità della copertura. L’analisi di quest’ultima informazione è propria della disciplina

della Fotogrammetria.

1.2 - PRINCIPI FISICI

1.2.1 - GRANDEZZE RADIOMETRICHE

In telerilevamento le informazioni riguardanti oggetti distanti vengono ricostruite median-

te la misura della radiazione elettromagnetica, riflessa o emessa dagli oggetti stessi, per mez-

zo di appropriati sensori, i quali registrano l’energia incidente convertendola in un segnale

elettrico: i sensori possono trovarsi ad una distanza che va da pochi metri dall’oggetto osser-

vato (Proximal Sensing) fino a migliaia di chilometri (Remote Sensing), come nel caso di os-

servazioni effettuate da satelliti geostazionari (circa 36˙000 Km di quota).

Nell’esempio esplicativo di figura 1.2.1, si nota come qualcosa di fisico (la luce) viene

emesso dallo schermo (che in tal caso è una “sorgente di radiazioni”), e attraversa lo spazio

fino a quando non incontra un sensore (gli occhi) che cattura tale radiazione da una certa di-

5

Capitolo 1 Telerilevamento: principi base

stanza e successivamente invia un segnale ad un processore (il cervello) che lo elabora e lo

interpreta.

In effetti, tutte le sensazioni che non sono indotte da contatto diretto (non solo la vista

quindi) sono frutto di un rilevamento a distanza (telerilevamento appunto).

Figura 1.2.1 - L’occhio umano che osserva uno schermo di un computer o di una televisione è un esempio molto comune di telerilevamento [www.planetek.it].

INSERIRE FIGURA RADIAZIONE EM

Figura 1.2.2 - Propagazione della radiazione elettromagnetica

6

Capitolo 1 Telerilevamento: principi base

La radiazione EM è un fenomeno ondulatorio dovuto alla contemporanea propagazione di

un campo elettrico e di un campo magnetico, oscillanti in piani mutuamente ortogonali, che si

propagano attraverso lo spazio con velocità pari alla velocità della luce c

( 8 m = 299,73 10 sc ⋅ ) (vedi Figura 1.2.2).

Definire un’onda significa definire i parametri caratteristici della stessa, che sono:

• ν = frequenza [Hz]: numero di oscillazioni dell’onda effettuate in un secondo;

• λ = Lunghezza d’onda [m]: distanza percorsa dall’onda durante un tempo di oscilla-

zione, che corrisponde alla distanza tra due massimi o due minimi dell’onda;

• T = Periodo [s]: tempo necessario affinché un ciclo completo di oscillazione venga

completato.

La lunghezza d’onda è legata alla frequenza dalla relazione:

λc λνT

= =

In ultimo vengono proposte, in breve, quelle che vengono chiamate grandezze radiome-

triche, cioè grandezze base che servono a ben definire la radiazione elettromagnetica (EM):

• Q = Energia radiante (radiant energy) [Joule]: è l’energia trasportata da un qualun-

que campo di radiazione elettromagnetica;

• P = Flusso radiante (radiant flux) [Watt]: è l'energia radiante nell'unità di tempo; è

considerata la grandezza radiometrica fondamentale, sulla base della quale sono defi-

nite tutte le grandezze successive;

• M = Emettenza radiante (radiant exitance) [Watt/m2]: è il flusso radiante emesso da

una sorgente estesa per unità di area;

• E = Irradianza (irradiance) [Watt/m2]: è il flusso radiante incidente su una superficie

per unità di area;

• I = Intensità radiante (radiant intensity) [Watt/sr] (1): è il flusso radiante emesso da

una sorgente puntiforme in una certa direzione per unità di angolo solido;

(1) - La sigla sr sta per “steradiante”. Tale unità di misura sta ad indicare l’“angolo solido”, cioè l’angolo tridimensionale.

L’angolo solido è definito come la porzione di spazio compresa tra tre o più piani che convergono in un punto. Se si hanno infiniti piani si crea un cono, un altro semplice esempio è fornito dal vertice della piramide. L’area della superficie della sfera compresa tra i piani è l’angolo solido. Lo steradiante in definitiva rappresenta un’area.

7

Capitolo 1 Telerilevamento: principi base

• L = Radianza (radiance) [(Watt/m2)/sr]: è il flusso radiante emesso da una sorgente

estesa per unità di angolo solido e per unità di area proiettata su un piano normale al-

la direzione considerata.

1.2.2 - LO SPETTRO ELETTROMAGNETICO

L’insieme di tutte le possibili lunghezze d’onda costituisce lo spettro della radiazione e-

lettromagnetica o spettro elettromagnetico: come si può notare dalla figura 1.2.3 tale spettro

viene suddiviso in più regioni spettrali distinte, il cui nome deriva da ragioni fisiche o da ra-

gioni legate alla percezione umana.

Figura 1.2.3 - Spettro elettromagnetico [http://kingfish.coastal.edu]

È interessante notare come la regione dello spettro visibile (VIS), limitata tra 0,35 μm e

0,75 μm, sia una zona relativamente piccola rispetto a tutto lo spettro elettromagnetico, ed an-

che l’unica regione percepibile dall’occhio umano senza ausilio di strumenti specifici: sulla

base di tale considerazione viene naturale pensare che ciò che ci appare sia relativamente po-

co rispetto a ciò che esiste ed è invisibile al nostro occhio; i sensori in uso nel telerilevamento

permettono invece di ampliare le nostre capacità percettive, estendendole a quello che viene

8

Capitolo 1 Telerilevamento: principi base

detto “campo dell’invisibile”. Le singole parti dello spettro visibile sono percepite dall’uomo

in termini dei diversi colori dell’arcobaleno, che variano dalle lunghezze d’onda più piccole

(violetto), alle lunghezze d’onda maggiori (rosso).

In tabella 1.2.1 sono riportate le diverse bande in cui è suddivisa la regione del visibile.

NOME BANDA Limiti banda [μm] VIOLETTO 350 - 455 BLU 455 - 492 VERDE 492 - 577 GIALLO 577 - 597 ARANCIO 597 - 622 ROSSO 622 - 750

Tabella 1.2.1 - Suddivisione dello spettro visibile

La regione di lunghezza d’onda inferiore al violetto, compresa tra 0,01 μm e 0,35 μm, è

chiamata ultravioletto (UV), quella a lunghezza d’onda superiore al rosso, compresa tra

0,75 μm e 1000 μm, è chiamata infrarosso (IR): la componente dell’infrarosso a maggior lun-

ghezza d’onda utilizzata in telerilevamento, che varia tra 7 μm e 15 μm, è dovuta

all’emissione termica di corpi “caldi” (2) ed appartiene a quello che si chiama all’infrarosso

termico. Procedendo nel senso crescente della lunghezza d’onda abbiamo quindi in sequenza:

raggi gamma, raggi X, ultravioletto, visibile (violetto, blu, verde, giallo, arancio, rosso), in-

frarosso (vicino, medio, lontano), microonde, onde radio.

1.2.3 - FIRMA SPETTRALE

Prima di definire questo nuovo concetto, di rilevante importanza nel campo del telerile-

vamento, è bene fare una premessa sulle interazioni tra una superficie S e le radiazioni elet-

tromagnetiche su di essa incidenti.

Siano quindi:

• Ei = Energia incidente sulla superficie S

• Er = Energia riflessa dalla superficie S

• Ea = Energia assorbita dalla superficie S

(2) - Per corpi “caldi” si intendono tutti quei corpi che abbiano una temperatura superiore allo zero assoluto

( ): un tale corpo emette radiazioni elettromagnetiche proprie che dipendono dalla temperatura del corpo stesso, seguendo la legge di “Stefan - Boltzmann”.

0 K 273,14 C° = − °

9

Capitolo 1 Telerilevamento: principi base

• Et = Energia trasmessa dalla superficie S

Figura 1.2.4 - Composizione dell’energia

L’energia incidente Ei sarà quindi in parte riflessa, in parte assorbita e in parte trasmessa

secondo lo schema in figura 1.2.4 e in funzione di tre coefficienti (o parametri) che dipendo-

no strettamente dalla natura fisica delle superfici e dal loro grado di rugosità o di lucidatura:

1. Coefficiente di riflessione (riflettività): r

i

Eρ E= 0 1ρ≤ ≤

2. Coefficiente di trasmissione (trasmittività): t

i

Eτ E= 0 1τ≤ ≤

3. Coefficiente di assorbimento (assorbività): a

i

Eα E= 0 1α≤ ≤

Si tenga presente che per la conservazione dell’energia in condizioni di equilibrio, si ha

i r aE E E Et= + +

e di conseguenza

1ρ α τ+ + =

Una generica superficie può riflettere, ad esempio, molto nella luce verde e poco nella

10

Capitolo 1 Telerilevamento: principi base

luce rossa e blu: in questo caso la superficie illuminata con luce bianca, apparirà come essen-

zialmente verde.

Dalla composizione delle varie percentuali con cui una superficie riflette le luci blu, verde,

rossa nasce il cosiddetto colore della medesima: una superficie bianca rifletterà bene sia il

rosso che il verde e blu. Per ogni superficie si può perciò costruire un grafico bidimensionale

che da informazioni sulle sue capacità di riflessione in funzione della lunghezza d’onda della

radiazione incidente: questo grafico, caratteristico di ogni superficie, viene chiamato firma

spettrale (o curva spettrale).

Figura 1.2.5 - Firma spettrale di alcuni materiali determinata medianti analisi in laboratorio

Questa importante proprietà della materia consente l’identificazione e la separazione di

diverse sostanze o classi proprio attraverso le loro firme spettrali (curve spettrali) come mo-

strato in figura 1.2.5: per esempio la sabbia rossa riflette meglio alle lunghezze d’onda del vi-

sibile rispetto alle lunghezze che occupano l’infrarosso, mentre un terreno erboso riflette mol-

to di più alle lunghezze d’onda dell’infrarosso.

È bene tener presente comunque, che una firma spettrale non può essere determinata in

termini “assoluti”, e questo è dovuto a due ragioni:

1. Una tipologia di copertura del terreno (ad esempio una classe “foresta”) non può es-

sere univocamente definita da una firma spettrale: a sua volta difatti tale classe inclu-

11

Capitolo 1 Telerilevamento: principi base

derà sicuramente tipologie differenti di materiali (nel caso della foresta diverse tipo-

logie di alberi) che a loro volta saranno differenziati in base al loro stadio e stato (al-

beri più giovani o più vecchi, alberi incendiati, presenza di malattie, ecc.) nonché in

base alla situazione del terreno (per esempio presenza di terreno umido); questo si-

gnifica che saranno caratterizzati da firma spettrale simile ma non identica. In ogni

caso una classificazione assoluta, ovvero basata sul confronto tra le funzioni di riflet-

tività osservate e una libreria nota a priori di firme spettrali, eventualmente molto

ampia, potrebbe essere un obiettivo realizzabile solo su un pianeta senza atmosfera.

Nel caso della Terra si devono considerare gli effetti atmosferici sulla propagazione

del segnale elettromagnetico: questi, differenti e mutevoli da luogo a luogo e da epo-

ca ad epoca, mascherano le osservazioni di riflettività, e di conseguenza la funzione

di riflettività non può essere ricavata dalle osservazioni del sensore neppure per mez-

zo di ipotetiche correzioni ideali (correzioni radiometriche).

2. Si deve considerare che della funzione ρ(λ) può essere osservata solo una parte in

quanto il sensore preposto a catturare le radiazioni elettromagnetiche a quella banda

di lunghezze d’onda registrerà un dato medio della riflettività in quella banda. A tale

scopo sono stati sviluppati strumenti atti a compiere misure in porzioni molto strette e

contigue dello spettro magnetico (sensori iperspettrali di cui si parlerà in seguito).

L’aumento del numero delle bande comporta un conseguente aumento dei dati da re-

gistrare e del tempo di elaborazione, con inevitabile aumento dei costi, senza dimen-

ticare che il rapporto segnale/rumore diminuisce proporzionalmente con l’ampiezza

della banda: si deve quindi trovare un compromesso opportuno tra larghezza di ban-

da, numero di bande, costo dello strumento e risultati desiderati [Caprioli, 2005].

La classificazione assoluta quindi risulta estremamente difficile, perciò viene in genere

adottata una strategia di classificazione relativa: i pixel caratterizzati da valori osservati di

ρ(λ) simili per le diverse bande dei sensori, vengono raggruppati nella stessa classe.

1.3 - SATELLITI PER IL TELERILEVAMENTO, SENSORI E DATI

1.3.1 - MEMORIZZAZIONE E VISUALIZZAZIONE DI IMMAGINI DIGITALI

Le immagini della superficie terrestre costituiscono il dato fondamentale utilizzato in tele-

rilevamento: esse vengono registrate in formato digitale in modo da poterle memorizzare ed

12

Capitolo 1 Telerilevamento: principi base

analizzare mediante calcolatori. Un’immagine così registrata è in effetti un insieme di numeri

che rappresentano una registrazione rettangolare: la registrazione avviene dividendo la scena

rappresentata in piccoli elementi quadrati di area uguale, chiamati pixel (contrazione di Pictu-

re Element), disposti per righe e colonne.

Figura 1.3.1 - Matrice Immagine

Il modello matematico che descrive un’immagine digitale è una matrice di R righe e C co-

lonne, contenente N R C= × elementi, esattamente quanti sono i pixel (vedi Figura 1.3.1). Il

generico elemento xij della i-esima riga e j-esima colonna contiene il valore del pixel corri-

spondente ed esprime un livello di intensità luminosa o tono di grigio per mezzo di un nume-

ro reale (chiamato Digital Number, o più semplicemente DN) appartenente ad un intervallo

predefinito: il valore più piccolo corrisponde ad assenza di luce, o colore nero, mentre il valo-

re massimo corrisponde a intensità piena o colore bianco.

Per garantire un risparmio di memoria del calcolatore, che adotta il sistema binario, ven-

gono utilizzati solo valori interi: disponendo di k bit per ciascun pixel i valori ammissibili so-

no 2k, dunque l’intervallo di definizione è compreso fra 0 e ( 2 1k − ). Per esempio nel caso di

una memorizzazione a 8 bit, la più comune, i valori interi possibili sono e vanno da

0 (nero) a 255 (bianco), memorizzati rispettivamente come 00000000 (0) e 11111111 (255).

82 256=

13

Capitolo 1 Telerilevamento: principi base

Figura 1.3.2 - Immagine a 8 bit con un ingrandimento che ne mostra la struttura in celle quadrate (pixel) e relativi DN

14

Capitolo 1 Telerilevamento: principi base

Per ogni immagine in formato digitale si può estrapolare un istogramma che rappresenta la

distribuzione dei valori DN per l’intera immagine: per ogni valore di intensità dell’intera

banda, sono riportate delle barrette verticali che rappresentano la frequenza, ovvero il numero

di pixel dell’intera immagine che hanno quel valore di intensità (vedi Figura 1.3.3).

L’istogramma di un’immagine sarà ripreso in seguito quando si parlerà di elaborazione di

immagini, e più precisamente di enhancement.

Figura 1.3.3 - Istogramma dell’immagine in Figura 1.3.2

Un file per la memorizzazione di un’immagine digitale contiene tutti i valori dei pixel che

compongono l’immagine, ma a seconda dell’estensione (la maggior parte di quelle usate in

quest’ambito), può avere alcune informazioni addizionali (metadati) memorizzate in una se-

zione iniziale del file detta intestazione (o header). L’intestazione riporta tutte le in-

formazioni necessarie per ricostruire l’immagine dal file, come il numero di bit utilizzati per

ciascun valore, l’ordine di memorizzazione dei valori, il numero di colonne presenti e talvolta

i parametri orbitali del satellite; essa può inoltre contenere altre informazioni utili per inter-

pretare il contenuto dell’immagine.

15

Capitolo 1 Telerilevamento: principi base

Un’immagine digitale è sempre monocromatica; difatti anche le usuali immagini a colori

(ad esempio in colore RGB), sono ottenute mediante combinazione di tre immagini della stes-

sa scena. In ciascuna di esse è registrata l’intensità luminosa corrispondente a uno dei colori

fondamentali (rosso, verde e blu), i quali possono essere combinati per riprodurre tutti gli altri

colori.

A tale riguardo si noti che, poiché rosso, verde e blu corrispondono a differenti regioni

dello spettro elettromagnetico, in senso lato un’immagine a colori è già un’immagine multi-

spettrale (o multibanda).

Figura 1.3.4 - Struttura di un’immagine multispettrale

Con tale termine si indica un insieme di immagini riferite tutte alla stessa scena e con la

medesima ripartizione in pixel (vedi Figura 1.3.4): ciascuna di esse registra l’intensità della

radiazione solo entro una specifica regione dello spettro o banda spettrale, non necessaria-

mente appartenente a una regione del visibile. Se con B indichiamo il numero totale di bande

che il sensore può percepire, la matrice che identifica l’immagine con tutte le sue bande avrà

dimensioni N R C B= × × con N numero totale di pixel dell’immagine. Nel telerilevamento,

nella maggior parte dei casi, vengono utilizzante le bande nel visibile e nell’infrarosso.

16

Capitolo 1 Telerilevamento: principi base

1 2

3 4

Figura 1.3.5 - Le quattro bande di una scena multispettrale IKONOS (1 = Blu; 2 = Verde; 3 = Rosso; 4 = Infrarosso) e la composizione delle prime 3 bande che danno un’immagine a colori naturali con la sequenza 3,2,1. [Der-manis et al., 2002]

RGB

Il file di un’immagine multispettrale contiene quindi valori kijx per tutte le righe i, per tutte

le colonne j e per tutte le bande k. A seconda dell’ordine di memorizzazione dei pixel si di-

stinguono tre formati:

17

Capitolo 1 Telerilevamento: principi base

1. Band Sequential (BSQ): le bande sono memorizzate in sequenza nel loro ordine natu-

rale (lunghezza d’onda crescente) ed ogni banda è memorizzata riga per riga da sini-

stra a destra con lo stesso ordine di lettura di una pagina (vedi Figura 1.3.6a).

Figura 1.3.6a - Ordine di memorizzazione Band Sequential (BSQ)

2. Band Interleaved by Pixel (BIP): per ciascun pixel sono memorizzati in sequenza i

valori corrispondenti a tutte le bande; anche per questo formato, l’ordinamento dei

pixel segue l’ordine di lettura di una pagina (vedi Figura 1.3.6b).

Figura 1.3.6b - Ordine di memorizzazione Band Interleaved by Pixel (BIP)

18

Capitolo 1 Telerilevamento: principi base

3. Band Interleaved by Line (BIL): è simile al formato BSQ ma la priorità di sequenza è

data alle righe, che sono memorizzate banda per banda; una volta terminata la memo-

rizzazione di una riga, segue la riga successiva (vedi Figura 1.3.6c)

Figura 1.3.6c - Ordine di memorizzazione Band Interleaved by Line (BIL)

1.3.2 - TELERILEVAMENTO SATELLITARE: IL SISTEMA DI OSSERVAZIONE DELLA TERRA

Un sistema di telerilevamento può essere scomposto schematicamente come segue:

1. Segmento Spaziale

1.1 Bus (o piattaforma)

1.2 Payload (o sensore)

2. Segmento Terrestre (stazione per ricevimento, elaborazione ed archiviazione dati).

1.3.2.1 - IL BUS

È la parte principale del satellite: tutti i satelliti necessitano di una piattaforma per soprav-

vivere e svolgere con efficienza le missioni per le quali sono stati progettati. Una piattaforma

è normalmente composta da una serie di sottosistemi che svolgono diverse funzioni e suppor-

tano il carico specifico.

I principali sottosistemi sono:

- TTC (Telecommunication, Tracking and Control Subsystem): fornisce il collegamen-

to radio tra il satellite e la stazione a terra. Questa componente è vitale per scaricare i

dati acquisiti dal satellite, trasmettere i comandi alle altre componenti del satellite e

controllare parametri come temperature, tensione, carburante, stato del carico, ecc.

- OBDH (On Board Data Handling): è l'unità di calcolo di bordo principale.

L’importanza del sottosistema dipende dai requisiti di design del sistema e dalla stra-

19

Capitolo 1 Telerilevamento: principi base

tegia di missione e può essere semplicemente ridotta ad un sottosistema TTC con

funzioni sofisticate come navigazione autonoma ed elaborazione a bordo dei dati

- AOCS (Attitude Overall Control System): è l’insieme di dispositivi che assicurano

stabilità e puntamento al satellite. È composto da componenti per la messa in moto,

ossia ruote inerziali, e sensori, come sensori stellari (Star Tracker) e GPS. Questo

sottosistema è critico per la missione poiché il corretto puntamento determina una

corretta geometria dei dati.

- POWER ASSEMBLY: fornisce l’energia elettrica alla piattaforma e al carico (pa-

yload): in genere, è costituito da un set di pannelli solari, supportati da batterie che

forniscono energia elettrica durante il lato in ombra dell’orbita.

1.3.2.2 - IL PAYLOAD

Letteralmente tradotto payload significa “carico pagante”: in effetti, questo termine è u-

sato ogni qualvolta si vuole indicare l’utilizzo finale di un certo mezzo di trasporto. Così co-

me una nave da crociera, ad esempio, ha come carico pagante i passeggeri, così un satellite

ha i suoi sensori, costruiti con caratteristiche tali da adempiere alla missione per la quale il

satellite è stato progettato e messo in orbita.

Il sensore è uno strumento capace di trasformare le onde elettromagnetiche, riflesse o e-

messe da una superficie, in un segnale elettrico, sia che costruisca delle immagini (immagini

aeree o terrestri, scene satellitari, ecc.), sia che compia solo delle misure (fotometri, laser ae-

rei o terrestri, ecc.). Tali sensori possono quindi essere divisi in due classi a seconda del pro-

dotto finale che forniranno: sensori d’immagine e sensori misuratori.

Così come abbiamo suddiviso i sensori in base al prodotto finale, possiamo fare un’altra

suddivisione, questa volta data dalla sorgente di energia, che permette di distinguere:

• Sensori attivi: la sorgente è emessa dal sensore stesso e viene rilevata una volta che

l’energia ha colpito l’oggetto da rilevare;

• Sensori passivi: la sorgente è esterna al sensore (energia solare riflessa dal corpo o

energia emessa direttamente dal corpo).

Scegliere il sensore più adatto all’osservazione di un determinato fenomeno significa i-

dentificare i suoi requisiti operativi e funzionali in modo ottimizzato nei confronti degli og-

getti da rilevare. I parametri che stabiliscono tali requisiti per un sensore sono notevoli, ma

tra essi assumono rilievo particolare i seguenti:

20

Capitolo 1 Telerilevamento: principi base

• Risoluzione geometrica (o spaziale): è la distanza minima entro la quale il sensore

riesce a distinguere due oggetti. Trattandosi di un sensore d’immagine, tale risoluzio-

ne è rappresentata dall’area minima vista dal sensore ad una data quota e corrisponde

alle dimensioni dell’elemento di superficie minima riconoscibile nell’immagine (os-

sia il pixel). In realtà parlare di risoluzione in termini di “area minima” non è del tutto

corretto, proprio perché tale valore può variare in funzione della quota relativa del

sensore dall’oggetto osservato e in funzione della distanza angolare di osservazione

dalla direzione della verticale del sensore: è bene allora definire la risoluzione me-

diante un parametro che sia indipendente dalla quota relativa del satellite.

b

Figura 1.3.7 - Schema del sistema di acquisizione dati da satellite. La cella di risoluzione a terra, determinata dall’IFOV, inquadra una piccola zona riportata nel riquadro a: le radiazioni emesse o riflesse vengono catturate dal sensore producendo il dato finale che è una media delle risposte provenienti da tale area e che si traduce in un pixel dell’immagine finale riportato nel riquadro b

a

21

Capitolo 1 Telerilevamento: principi base

Definiamo allora l’IFOV (Instantaneous Field of View - Campo di Vista Istantaneo):

rappresenta l’angolo diedro di visibilità del sensore al di sotto del quale il rivelatore

del sensore (3) non riesce a distinguere due oggetti distinti e separati. Quest’angolo,

come si può notare dalla figura 1.3.7, dipende esclusivamente da come è costruito il

sensore, ragion per cui è indipendente dalla quota alla quale esso è posto. La zona di

copertura sottesa dall’IFOV viene chiamata GSD (Ground Simple Distance - area

campionata) o anche cella di risoluzione ed è pari al prodotto tra IFOV e quota relati-

va al suolo. L’utilità di definire l’IFOV piuttosto che parlare di “area minima” può

essere notata più facilmente quando si parla di sensori posti su aerei o elicotteri in cui

la quota relativa al suolo varia sensibilmente e di continuo. Un oggetto che sia più

piccolo della cella di risoluzione quindi non potrà essere identificato (vedi Figura

1.3.7). La larghezza al suolo dell’immagine, nella dimensione trasversale alla dire-

zione di volo, viene detta swath: anche per definire questa grandezza si preferisce u-

sare una dimensione angolare indipendente dalla quota di volo, che si chiama FOV

(Field of View - Campo di Vista) (4). Per quanto detto, viene naturale pensare che

diminuendo l’IFOV si aumenta la risoluzione geometrica, il che è vero, ma ci sono

comunque dei limiti a questa tendenza: un IFOV troppo piccolo comporta un’energia,

raccolta dal sensore, troppo bassa, che induce ad una diminuzione del rapporto segna-

le/rumore.

• Risoluzione radiometrica: esprime la minima differenza di intensità che un sensore è

capace di rilevare e misurare tra due valori di energia raggiante: migliore è tale riso-

luzione, più è sensibile nel registrare piccole differenze nell’energia riflessa o emes-

sa. Un qualsivoglia oggetto radiometricamente uniforme presente su un’immagine ri-

presa con supporto tradizionale (pellicola) appare a toni continui, mentre la stessa ri-

presa, fatta con un sensore digitale, essendo composta da pixel, presenta discontinui-

tà: l’aumento di tale risoluzione riduce notevolmente (ma non elimina) tale disconti-

nuità. Per immagini digitali, tale risoluzione è definita attraverso i bit dell’immagine

stessa: maggiori sono i bit di una banda, maggiori saranno i valori di intensità lumi-

nosa che un pixel può assumere.

(3) - Si tenga presente che il sensore è tutto l’apparato che permette la raccolta e la registrazione dell’energia elettromagnetica

incidente, ma ciò che realmente “registra” l’energia incidente, cioè l’elemento sensibile, è il rivelatore. Un sensore può a-vere uno o più rivelatori al suo interno a seconda della tecnica di ripresa che lo caratterizza.

(4) - In alcuni testi e/o pubblicazione è d’uso trovare sia FOV sia AFOV (Angular Field Of View).

22

Capitolo 1 Telerilevamento: principi base

• Risoluzione spettrale: è data dalla larghezza della banda (intervallo di lunghezza

d’onda) dei canali impiegati. Un’alta risoluzione spettrale significa, quindi, una con-

figurazione strumentale a bande molto strette. Avere bande troppo strette però com-

porta anche una quantità di energia raccolta inferiore, cioè un rapporto segna-

le/rumore generalmente basso, ragion per cui si riduce la risoluzione radiometrica. Al

contrario, i sensori che operano con larga banda hanno una buona risoluzione radio-

metrica e, per quanto detto in precedenza, anche una buona risoluzione geometrica. È

questa, infatti, la ragione per cui si predilige una ripresa con un sensore pancromatico

piuttosto che con uno multispettrale quando si richiedono elevate qualità metriche di

un’immagine, ad esempio per usi attinenti la fotogrammetria.

• Risoluzione temporale: questa caratteristica riguarda i sensori montati su piattaforme

satellitari, e sta ad indicare il tempo intercorso tra due riprese successive della stessa

area. Questo parametro essenzialmente è dovuto ai parametri orbitali del satellite.

1.3.2.3 - SEGMENTO TERRESTRE

I dati ottenuti durante una missione spaziale devono essere trasmessi alla Terra dal mo-

mento che il satellite continua a stare in orbita e ad acquisire dati.

Figura 1.3.8 - Possibili sistemi di trasmissione dati satellite-Terra

23

Capitolo 1 Telerilevamento: principi base

Figura 1.3.9 - Struttura del Segmento Terrestre

Ci sono fondamentalmente tre maniere per trasmettere i dati acquisiti dal satellite a terra

(vedi Figura 1.3.8):

A. I dati possono essere trasmessi direttamente alla Terra se esiste una stazione ricevente

(GRS - Ground Receiving Station) all’interno del footprint visivo del satellite.

24

Capitolo 1 Telerilevamento: principi base

B. Se A non è verificato, i dati possono essere registrati a bordo del satellite e trasmessi

alla GRS in un momento successivo.

C. I dati possono essere trasmessi alla GRS attraverso i Tracking and Data Relay Satelli-

te System (TDRSS) che consistono in una serie di satelliti per le telecomunicazioni in

orbita geosincrona. I dati sono trasmessi da un satellite ad un altro fino a che non rag-

giungono la giusta GRS.

I dati sono inviati alla stazione ricevente (GRS) in formato digitale grezzo, non elaborato.

Su richiesta, possono essere poi processati per correggere tutte le distorsioni sistematiche, ge-

ometriche ed atmosferiche e convertiti in un formato standard.

Tipicamente i dati sono archiviati nelle stazioni di ricezione e processamento: gli archivi

completi di dati sono gestiti dalle agenzie governative, ma anche dalle compagnie commer-

ciali responsabili degli archivi dei diversi sensori.

Immagini “quick-look” a bassa risoluzione sono usate per visionare le immagini archiviate

prima che vengano acquistate. La qualità spaziale e radiometrica di questi tipi di dati è degra-

data, ma risultano comunque molto utili per verificare se la qualità dell'immagine e l’even-

tuale copertura nuvolosa è appropriata ai fini della applicazione.

Il segmento Terrestre provvede inoltre al monitoraggio di tutti i parametri di funzionamen-

to del satellite (controllo dell’orbita, eventuali correzioni da apportare all’assetto del satellite,

controllo guasti, ecc.).

1.3.3 - CLASSIFICAZIONE TECNOLOGICA DEI SENSORI

Il tipo di radiazione che un sensore può rilevare dà modo di discriminare due grosse classi

di sensori:

• Sensori ottici (d’immagine e misuratori), che operano nel campo del visibile (VIS) e

dell’infrarosso (IR) sfruttando, come sistema di messa a fuoco, un’ottica a rifrazione

o a riflessione che convoglia l’energia verso l’elemento sensibile. Si suddividono in

tre categorie:

- Pancromatico, costituito da un solo rivelatore che fornisce un segnale elettrico

proporzionale alla radiazione complessiva, in un intervallo dello spettro elettro-

magnetico comprendente tutto o una parte del visibile; in alcuni casi comprende

anche parte dell’infrarosso fotografico;

25

Capitolo 1 Telerilevamento: principi base

- Multispettrale, costituito da un numero limitato di rivelatori, ognuno dei quali

fornisce un segnale elettrico proporzionale all’energia elettromagnetica relativa

ad una porzione relativamente ampia del visibile (VIS) e dell’infrarosso (IR). La

risoluzione spettrale è normalmente bassa (0,1 - 0,2 μm);

- Iperspettrale, costituito da un elevato numero di rivelatori che raccolgono la ra-

diazione in un gran numero di canali spettrali di piccolissima larghezza di banda.

La risoluzione spettrale è generalmente alta (0,01 - 0,001 μm) e permette di iden-

tificare direttamente le componenti delle coperture superficiali della Terra (vedi

paragrafo 1.2.3 sulla firma spettrale)

• Sensori a microonde, che operano a lunghezze d’onda dell’ordine del millimetro

(normalmente da 1 a 10 mm): sono prevalentemente usati per l’individuazione di so-

stanze inquinanti, per l’analisi della composizione dell’atmosfera e per lo studio delle

caratteristiche della superficie terrestre.

In questo contesto focalizzeremo l’attenzione prevalentemente sui sensori ottici

d’immagine.

1.3.3.1 - SENSORI OTTICI D’IMMAGINE

Tali sensori sono in grado di generare un insieme di dati bidimensionali (l’immagine) cor-

rispondente alla porzione di superficie terrestre osservata, suddivisa idealmente in celle ele-

mentari (pixel). Le direzioni di riferimento dell’immagine sono generalmente costituite dalla

direzione del moto del satellite e dalla direzione ortogonale ad essa. L’immagine, essendo in

formato numerico, ha il vantaggio di poter essere elaborata da un calcolatore, migliorandone

la qualità visiva ed eliminando le imperfezioni, consentendo anche confronti quantitativi e

qualitativi con immagini precedenti della stessa zona.

- SENSORI FOTOGRAFICI

Sono sensori ottico-meccanici o digitali che forniscono rispettivamente fotografie o im-

magini in cui le variazioni di energia elettromagnetica riflessa (nel visibile e nell'infraros-

so fotografico) vengono tradotte in variazioni di densità fotografica o di livelli radiometri-

ci.

26

Capitolo 1 Telerilevamento: principi base

Figura 1.3.10 - Schema dimostrativo di una camera fotografica

I sensori fotografici ottico-meccanici, detti anche camere, sono utilizzati tanto per scopi

cartografici quanto per osservazioni di natura tematica e vengono indifferentemente posi-

zionati su piattaforme terrestri, aeree e spaziali. In questi sensori il sistema di raccolta e

messa a fuoco dell’energia è un obiettivo a rifrazione che convoglia la radiazione su

un’emulsione fotografica stesa su un supporto semirigido che è la pellicola. In tal caso la

pellicola funge sia da trasduttore che da sistema di registrazione.

I risultati forniti da questi sensori dipendono, oltre che dalle caratteristiche del soggetto,

dalla posizione del sole, dalle condizioni dell’atmosfera e dal tipo di pellicola: questa può

essere in bianco e nero (b/n), detta anche pancromatica, e a colori, detta anche ortocroma-

tica. In entrambi i casi l’immagine viene restituita con densità fotografica proporzionale

all’energia incidente. Nel caso della pellicola pancromatica la restituzione avviene attra-

verso una scala dei grigi che varia in modo continuo dal bianco al nero; nel caso della pel-

licola ortocromatica, invece, le variazioni dell’energia riflessa sono fissate con un codice

di colori a vario cromatismo e saturazione. La risoluzione geometrica di questi sistemi è

molto alta essendo limitata soltanto dalla qualità dell’ottica e dalla grana della pellicola.

Altri vantaggi di tali camere sono:

• facilità di analisi delle fotografie;

27

Capitolo 1 Telerilevamento: principi base

• costi contenuti;

• potenze impegnate relativamente basse.

La camera di gran lunga più usata nel telerilevamento terrestre è certamente la macchina a

fotogrammi, detta anche camera metrica, utilizzata per il rilievo aereo. Ricorda una nor-

male macchina fotografica ma se ne differenzia per le distorsioni delle ottiche (molto più

ridotte per la camera metrica) e per l’aggiunta di alcune parti necessarie alla sua funzione

quali:

• speciali supporti antivibrazione e antirollio;

• sistema di orientazione nella direzione voluta, tenendo presente che un asse

dell’apparato deve mantenersi quanto più possibile parallelo alla linea di volo;

• contenitore della pellicola di maggiore dimensioni;

• meccanismo automatico di chiusura ed apertura dell’otturatore che deve essere

tarato in funzione dei parametri di volo.

Figura 1.3.11 - Schema esemplificativo di una camera metrica analogica

28

Capitolo 1 Telerilevamento: principi base

La maggior parte di queste camere montano obiettivi con focale 150 mm (in alcune riprese

in zone urbane si fa uso anche del 300 mm per ridurre l’effetto prospettico), con un angolo

FOV che varia da 90° a 120°, fornendo fotogrammi quadrati di misura standard 23 cm.

Da un decennio circa è in atto una propensione all’utilizzo, nel telerilevamento, di camere

metriche digitali che non fanno più uso di una pellicola sensibile alla luce (o all'infraros-

so) bensì di particolari rivelatori detti CCD (Charge-Coupled Device). Realizzando una

matrice di questi elementi rivelatori, la scena ripresa dal sistema ottico del sensore può es-

sere letta elettronicamente (praticamente tutti i rivelatori vengono letti nello stesso istante)

e registrata pixel per pixel, ognuno corrispondente al singolo elemento rivelatore. I van-

taggi sono notevoli in quanto, con il dato che nasce digitale, si evitano le fasi di sviluppo e

scansione. Per quanto le tecniche analogiche e digitali in tale campo al momento coesisto-

no, la continua espansione ed evoluzione del digitale lascia ipotizzare che in un prossimo

futuro le ditte produttrici di pellicole possano cessarne la produzione, comportando quindi

un totale passaggio degli addetti al settore al digitale, rendendo così definitivamente “su-

perata” la tecnica analogica almeno per quanto riguarda il settore delle riprese.

Figura 1.3.12 - Due moderne camere fotogrammetriche digitali: a sinistra una LEICA ADS40, a destra una Z/I (ZEISS/INTERGRAPH) DMC

29

Capitolo 1 Telerilevamento: principi base

- SENSORI A SCANSIONE

Sono sensori d’immagine di tipo ottico. La modalità di scansione può essere di due

tipi:

• whiskbroom (detti anche across-track o sensori a scansione meccanica)

• pushbroom (detti anche along-track)

Relativamente semplici dal punto di vista costruttivo ed operativo, i sensori whiskbroom

sono sistemi passivi, sensibili alla radiazione visibile e/o infrarossa e vengono utilizzati a

bordo di aerei o di satelliti per acquisire immagini di zone della superficie terrestre anche

molto ampie. Questi scanner sono normalmente a scansione lineare, riprendendo migliaia

di pixel di una striscia di terreno ortogonale alla direzione de1volo; tale risultato si ottiene

effettuando una scansione del terreno mediante uno specchietto piano oscillante o rotante

attorno ad un asse parallelo al moto del veicolo. Il moto della piattaforma genera l’altro

asse dell’immagine.

Figura 1.3.13 - Sistema di scansione multispettrale whiskbroom a specchietto rotante

30

Capitolo 1 Telerilevamento: principi base

La radiazione intercettata viene inviata ad un sistema ottico che la focalizza su rivelatori

sensibili a prestabilite bande spettrali che trasformano l’energia elettromagnetica in un se-

gnale elettrico. L’IFOV determina l’estensione dell’area di campionamento dello scanner

nell’unità di tempo. C’è una differenza importante da sottolineare distinguendo “specchio

rotante” e specchio oscillante”: nel primo si ha un unico rivelatore sul quale si focalizza la

radianza elettromagnetica riflessa dallo specchio, mentre nel secondo si possono avere più

rivelatori per banda che acquisiscono contemporaneamente diverse linee di scansione

(come sul Multi Spectral Scanner); la seconda opzione è utile per aumentare il tempo di

permanenza su ogni singolo rivelatore e quindi avere anche risoluzioni migliori. Guardan-

do le figure 1.3.14a e 1.3.14b si può notare come la differenza di funzionamento si traduca

in due tracce differenti.

Figura 1.3.14a - Traccia di un sensore whiskbroom a specchietto oscillante

Figura 1.3.14b - Traccia di un sensore whiskbroom a specchietto rotante

I sensori pushbroom, invece, impiegano array lineari di elementi CCD. La configura-

zione per questi sistemi prevede generalmente un array lineare per ciascuna banda spettra-

le in cui opera lo strumento, disposti perpendicolarmente alla direzione del moto della

piattaforma. Un singolo elemento rivelatore corrisponde ad una cella di risoluzione al suo-

lo. Ciascun array è collocato nel piano focale delle ottiche dello strumento: in tal modo

un’intera striscia al suolo perpendicolare alla direzione della traccia viene messa a fuoco

sugli elementi rivelatori CCD in un determinato istante. Il movimento progressivo della

piattaforma, infine, consente agli array di rivelare le successive strisce della scena: una ve-

locità opportuna di campionamento elettronico garantisce così un corretto rilievo delle li-

nee contigue dell’immagine.

31

Capitolo 1 Telerilevamento: principi base

Figura 1.3.15 - Sistema di scansione multispettrale pushbroom

1.3.4 - PRINCIPALI PIATTAFORME IN USO PER IL TELERILEVAMENTO

1.3.4.1 - MISSIONI LANDSAT

Satellite in orbita dal al sensori Landsat 1 23 luglio1972 6 gennaio 1978 MSS, RBV

Landsat 2 22 gennaio 1975 25 febbraio 1982 MSS, RBV

Landsat 3 5 marzo 1978 31 marzo 1983 MSS, RBV(×2)

Landsat 4 16 luglio1982 luglio 1995 MSS, TM

Landsat 5 1 marzo 1984 Operativo MSS, TM

Landsat 6 lanciato 5 ottobre 1993: perso in lancio ETM

15 aprile 1999 Operativo ETM+ Landsat 7

Tabella 1.3.1 - Missioni Landsat e rispettivi sensori

32

Capitolo 1 Telerilevamento: principi base

MSS (MultiSpectral Scanner) Landsat 1, 2, 3, 4, 5 Risoluzione spettrale

Banda Lunghezza d’onda(μm) Landsat 1, 2, 3 Landsat 4, 5

4 1 0,5 - 0,6 verde 5 2 0,6 - 0,7 rosso 6 3 0,7 - 0,8 infrarosso vicino 7 4 0,8 - 1,1 infrarosso vicino 8 (Landsat 3) 10,4 - 12,6 infrarosso termico

Risoluzione geometrica Landsat 1, 2, 3 79 × 79 m Landsat 4 81,5 × 81,5 m Landsat 5 82,5 × 82,5 m Banda 8 (Lansat 3) 237 × 237 m

5 185 km Swath ( ) Risoluzione radiometrica

7 bit (Banda 8: 6 bit) Risoluzione temporale

18 giorni Landsat 1, 2, 3 16 giorni Landsat 4, 5

RBV (Return Beam Vidicon) Landsat 1, 2, 3 Risoluzione spettrale

Banda lunghezza d'onda (μm) 1 (Landsat 1, 2) 0,475 - 0,575 blu 2 (Landsat 1, 2) 0,580 - 0,680 rosso 3 (Landsat 1, 2) 0,689 - 0,830 infrarosso vicino Pan (Landsat 3) 0,505 - 0,750 pancromatico

Risoluzione geometrica Landsat 1, 2 79 × 79 m Landsat 3 40 × 40 m (Pan)

185 km Landsat 1, 2Swath

98 km Landsat 3 Risoluzione temporale

18 giorni

Tabella 1.3.2 - Caratteristiche del sensore Multispectral Scanner

Tabella 1.3.3 - Caratteristiche del sensore Return Beam Vidicon

(5) - Lo swath è riferito al singolo sensore. Quando sono presenti due sensori identici (come nel caso del Landsat 3), questi ven-

gono utilizzati, nella maggior parte dei casi, in coppia durante una scansione, per cui lo swath totale, in genere, è quasi il doppio (non è proprio il doppio perché c’è sempre una lieve sovrapposizione tra i due swath, per evitare di lasciare zone scoperte).

33

Capitolo 1 Telerilevamento: principi base

TM (Thematic Mapper) Landsat 4, 5 Risoluzione spettrale

Banda lunghezza d'onda (μm) 1 0,45 - 0,52 blu 2 0,52 - 0,60 verde 3 0,63 - 0,69 rosso 4 0,76 - 0,90 infrarosso vicino 5 1,55 - 1,75 infrarosso medio 7 2,08 - 2,35 infrarosso medio 6 10,4 - 12,5 infrarosso termico

Risoluzione geometrica Banda 1, 2, 3, 4, 5, 7 30 × 30 m Banda 6 120 × 120 m

185 km Swath Risoluzione radiometrica

8 bit Risoluzione temporale

16 giorni

Tabella 1.3.4 - Caratteristiche del sensore Thematic Mapper

ETM+ (Enhanced Thematic Mapper) Landsat 7 Risoluzione spettrale

Banda lunghezza d’onda (μm) 1 0,45 - 0,515 blu 2 0,525 - 0,605 verde 3 0,63 - 0,690 rosso 4 0,75 - 0,90 infrarosso vicino 5 1,55 - 1,75 infrarosso medio 7 2,09 - 2,35 infrarosso medio 6 10,40 - 12,50 infrarosso termico

Pan 0,52 - 0,90 pancromatico Risoluzione geometrica

Banda 1, 2, 3, 4, 5, 7 30 × 30 mBanda 6 60 × 60 m Pan 15 × 15 m

185 km Swath Risoluzione radiometrica

8 bit Risoluzione temporale

16 giorni

Tabella 1.3.5 - Caratteristiche del sensore Enhanced Thematic Mapper

34

Capitolo 1 Telerilevamento: principi base

1.3.4.2 - MISSIONI SPOT

Satellite in orbita dal al sensori 22 febbraio1986 31 dicembre 1990 SPOT 1 HRV (× 2) 22 gennaio 1990 Operativo SPOT 2 HRV (× 2)

26 settembre 1993 14 novembre 1997 SPOT 3 HRV (× 2) 24 marzo 1998 Operativo SPOT 4 HRVIR (× 2), VGT 4 maggio 2002 Operativo SPOT 5a HRG (× 2), VGT

previsto nel 2007 --- SPOT 5b HRG (× 3)

Tabella 1.3.6 - Missioni SPOT e rispettivi sensori

HRV (High Resolution Visible) ( ) SPOT 1, 2, 3 S

Risoluzione spettrale Banda lunghezza d’onda (μm)

1 0,50 - 0,59 verde 2 0,61 - 0,68 rosso 3 0,79 - 0,89 infrarosso vicino

Pan 0,51 - 0,73 pancromatico Risoluzione geometrica

Banda 1, 2, 3 20 × 20 m Pan 10 × 10 m

60 km Swath Risoluzione radiometrica

8 bit Risoluzione temporale

26 giorni

Tabella 1.3.7 - Caratteristiche del sensore High Resolution Visible

VGT (Vegetation) SPOT 4, 5 Risoluzione spettrale

Banda lunghezza d'onda (μm) 1 0,43 - 0,47 blu 2 0,61 - 0,68 rosso 3 0,79 - 0,89 infrarosso vicino 4 1,58 - 1,75 infrarosso medio

Risoluzione geometrica 1 × 1 km 2250 km Swath

Risoluzione radiometrica 8 bit

Risoluzione temporale 1 giorno

Tabella 1.3.8 - Caratteristiche del sensore Vegetation

(S) - Possibilità di effettuare riprese stereoscopiche

35

Capitolo 1 Telerilevamento: principi base

HRVIR (High Risoluzione Visible Infrared) (S) SPOT 4 Risoluzione spettrale

Banda lunghezza d'onda (μm) 1 0,50 - 0,59 verde 2 0,61 - 0,68 rosso 3 0,79 - 0,89 infrarosso vicino 4 1,58 - 1,75 infrarosso medio

Pan 0,51 - 0,68 pancromatico Risoluzione geometrica

Banda 1, 2, 3 20 × 20 m (Banda 2 anche 10 × 10 m) Pan 10 × 10 m

60 km Swath

Risoluzione radiometrica 8 bit

Risoluzione temporale 26 giorni

HRG (High Resolution Geometric) ( ) SPOT 5 S

Risoluzione spettrale Banda lunghezza d'onda (μm)

1 0,50 - 0,59 verde 2 0,61 - 0,68 rosso 3 0,79 - 0,89 infrarosso vicino 4 1,58 - 1,75 infrarosso medio

Pan 0,51 - 0,73 pancromatico Risoluzione geometrica

Banda 1, 2, 3 10 × 10 m Banda 4 20 × 20 m Pan 5 × 5 m (Supermode Panchromatic: 2,5 × 2,5 m)

60 km Swath Risoluzione radiometrica

8 bit Risoluzione temporale

26 giorni

Tabella 1.3.9 - Caratteristiche del sensore High Resolution Visible Infrared

Tabella 1.3.10 - Caratteristiche del sensore High Resolution Geometric

(S) - Possibilità di effettuare riprese stereoscopiche

36

Capitolo 1 Telerilevamento: principi base

1.3.4.3 - MISSIONI IKONOS

Satellite in orbita dal al sensori --- pianificato 1999: lancio fallito IKONOS-1

IKONOS-2 (IKONOS) 24 settembre 1999 Operativo ) IKONOS (S

Risoluzione spettrale Banda lunghezza d'onda (μm)

1 0,445 - 0,516 blu 2 0,506 - 0,595 verde 3 0,632 - 0,698 rosso 4 0,757 - 0,853 infrarosso vicino

Pan 0,526 - 0,929 pancromatico Risoluzione geometrica

Banda 1, 2, 3, 4 3,2 × 3,2 m (Nadir); 4 × 4 m (26° Off-Nadir) Pan 0,82 × 0,82 m (Nadir); 1 × 1 m (26° Off-Nadir)

11,3 km (Nadir); 13,8 km (26° Off-Nadir) Swath Risoluzione radiometrica

8 bit / 11 bit Risoluzione temporale

Risoluzione geometrica 4 × 4 m: 1,5 giorni Risoluzione geometrica 1 × 1 m: 2,9 giorni

Tabella 1.3.11 - Caratteristiche del sensore Ikonos

1.3.4.4 - MISSIONI QUICKBIRD

Satellite in orbita dal al sensori pianificato Novembre 2000: lancio fallito --- QUICKBIRD-1 18 Ottobre 2001 Operativo QUICKBIRD (S) QUICKBIRD-2

Risoluzione spettrale Banda lunghezza d'onda (μm)

1 0,450 - 0,520 blu 2 0,520 - 0,600 verde 3 0,630 - 0,690 rosso 4 0,760 - 0,900 infrarosso vicino

Pan 0,445 - 0,900 pancromatico Risoluzione geometrica

Banda 1, 2, 3, 4 2,4 × 2,4 m (Nadir) Pan 0,60 × 0,60 m (Nadir)

16,5 km (Nadir) Swath Risoluzione radiometrica

11 bit Risoluzione temporale

3-7 giorni (dipendente dalla latitudine)

Tabella 1.3.12 - Caratteristiche del sensore Quickbird

(S) - Possibilità di effettuare riprese stereoscopiche

37

Capitolo 1 Telerilevamento: principi base

1.3.4.5 - MISSIONI EROS

Satellite in orbita dal al sensori S5 Dicembre 2000 Operativo EROS-A1 EROS-A ( )

EROS-A (S) Missione cancellata EROS-A2 EROS-B (S) 25 Aprile 2006 Operativo EROS-B1

Risoluzione spettrale Banda lunghezza d’onda (μm)

1 (EROS-B) 0,480 - 0,520 blu 2 (EROS-B) 0,540 - 0,580 verde 3 (EROS-B) 0,640 - 0,680 rosso 4 (EROS-B) 0,820 - 0,900 infrarosso vicino Pan (EROS-A, B) 0,450 - 0,900 pancromatico

Risoluzione geometrica Banda EROS-A EROS-B

1, 2, 3, 4 --- 3,5 × 3,5 m 1,8 × 1,8 m (Standard mode) Pan 0,87 × 0,87 m 1 × 1 m (Hypersampled mode)12.5 km (Standard mode) 13 km Swath 6,25 km (Hypersampled mode)Risoluzione radiometrica

11 bit 10 bit Risoluzione temporale

2 giorni ??

Tabella 1.3.13 - Caratteristiche dei sensori EROS

(S) - Possibilità di effettuare riprese stereoscopiche

38

Capitolo 2 ELABORAZIONE ED INTERPRETAZIONE DELLE IMMAGINI

2.1 - INTRODUZIONE

Se è vero che le tecniche di acquisizione d’immagini si sono evolute negli anni, sia per

quanto riguarda le piattaforme, sia per i sensori, è altrettanto vero che si sono evolute anche le

tecniche inerenti le applicazioni successive all’acquisizione dell’immagine, questo grazie a

calcolatori sempre più moderni e veloci che si sono diffusi parallelamente alle nuove conqui-

ste spaziali.

Le immagini in formato numerico, la loro visualizzazione su uno schermo che sostituisce il

supporto cartaceo, e l’implementazione di software con algoritmi sempre più sofisticati e

computazionalmente sempre più rapidi, rendono oggi possibile l’uso di numerose applicazio-

ni utili al trattamento ed al miglioramento delle immagini. Il solo modo di avere un’immagine

quanto migliore possibile, prima che fossero rese attuabili le procedure digitali, ammesso di

avere ottiche a bassissime distorsioni e pellicole ad alta risoluzione e di alta qualità cromati-

ca, si basava su una buona selezione dei tempi di esposizione e dei diaframmi relativi al sin-

golo scatto della camera, nonché sull’ottimizzazione delle procedure di sviluppo delle pelli-

cole. Quanto si propone in questo capitolo riguarda le tecniche di filtraggio e di miglioramen-

to delle immagini, al fine di implementarne i dettagli e rendere più accurata l’interpretazione

delle coperture del suolo da parte dell’operatore e, come vedremo, anche da parte di software.

2.2 - L’IMMAGINE RASTER (IL DATO)

I sensori a scansione montati a bordo delle piattaforme, aeree o satellitari che siano, ese-

guono una scansione della superficie sottostante campionando per linee, trasversalmente al

moto del vettore: tali linee, riordinate nella loro sequenza di presa, permettono la ricostruzio-

ne dell’immagine, o meglio della scena. Sostanzialmente il funzionamento del sistema di

scansione in sé è identico passando da aereo a satellite, ma ci sono differenze per quanto ri-

guarda il tracciamento della posizione del velivolo e del satellite, oltre che nelle procedure e

nei materiali utilizzati per la costruzione del satellite che però qui non tratteremo.

Riesaminiamo per un momento i sensori ottici: un’immagine data da un fotogramma, sen-

za intervenire con alcuna correzione post-acquisizione, fornisce già informazioni qualitative

del territorio: si potrebbe per esempio, su un’immagine a colori naturali, operare una fotoin-

39

Capitolo 2 Elaborazione ed interpretazione delle immagini

terpretazione di tipo agrario identificando anche su un singolo fotogramma, che rappresenta

una realtà inconfutabile, i tipi di coltura, ma non si possono avere informazioni metrico-

geografiche di alcun tipo (non si sa né dove si trovano quei terreni coltivati né la loro esten-

sione) se prima non si interviene tramite delle operazioni ben specifiche.

In fotogrammetria l’operazione immediatamente successiva alla ripresa è l’appoggio dei

fotogrammi, si misurano cioè le coordinate immagine di un certo numero di punti ben ricono-

scibili sull’immagine (detti punti fotografici di appoggio), punti le cui coordinate geografiche

sono note, per poi poter effettuare l’orientamento esterno (6) dei singoli fotogrammi, oppure

l’orientamento relativo ed assoluto dei fotogrammi e poter effettuare o una restituzione (otte-

nendo una carta topografica come prodotto finale) oppure un’ortorettifica (ottenendo

un’ortofoto o un’ortofotocarta) grazie alle quali è possibile prendere misure. Tutto ciò è pos-

sibile sia su sistemi ottico-meccanici che su ottico-digitali, ma è immaginabile che alcune

tecniche siano cambiate: in effetti oggi, grazie al sistema di posizionamento GPS (Global

Position System) ed al sistema di navigazione inerziale IMU (Inertial Measurement Unit) (7)

che affiancano l’equipaggiamento base per le riprese, “teoricamente” non sarebbe più neces-

sario l’uso di punti fotografici d’appoggio. In pratica però si rendono comunque necessari tali

punti, dato che il GPS potrebbe portare errori dovuti ad interferenze di segnali, o a brevi pe-

riodi di “buio” del segnale, e comunque si tratta di un utilizzo in modalità cinematica del

GPS, meno preciso della modalità statica. Tale sistema si rende molto utile laddove si ripren-

dano zone in cui è difficile, o talvolta impossibile, l’accesso da terra per motivi logistici o mi-

litari ad esempio, o laddove non ci siano punti distintamente individuabili sul fotogramma:

ecco che il GPS/IMU diventa fondamentale.

Se quindi per le immagini ottenute con sensore ottico-fotografico si può lavorare sfruttan-

do le tecniche topografiche classiche, ciò non può accadere con i sensori scanner, per i quali

si rendono strettamente necessari i sistemi GPS/IMU, se si tratta di sensori aerotrasportati,

oppure mediante il sistema di controllo a terra, se si tratta di sensori su satellite, che rende

(6) - L’orientamento esterno è un’operazione mediante la quale si individuano sei parametri fondamentali: le tre coordinate del

centro di presa, e i tre angoli di assetto della camera secondo un sistema di riferimento geodetico globale, che permettono di risalire all’esatta condizione spaziale della camera al momento della presa del fotogramma.

(7) - Il sistema GPS permette di trovare le coordinate (Xo, Yo, Zo) del centro di presa (si deve conoscere l’offset tra il centro di fase dell’antenna montata sul lato superiore della fusoliera del velivolo e il centro di presa della camera); il sistema IMU è costituito da tre accelerometri e tre giroscopi che valutano i parametri (φ, ω, κ) dell’assetto del velivolo, rispettivamente beccheggio, rollio ed imbardata, e di conseguenza permettono di trovare i parametri di orientamento della camera all’istante della presa del fotogramma.

40

Capitolo 2 Elaborazione ed interpretazione delle immagini

possibile la conoscenza dei parametri orbitali e di assetto dello stesso, istante per istante: la

differenza di cui si accennava prima è proprio questa.

Figura 2.2.1 - Distorsioni dovute alle variazioni degli angoli di assetto delvelivolo [University of Wisconsin Madison]

Per le riprese con sensori scanner aerotrasportati, la mancanza di dati GPS potrebbe, non

senza molte difficoltà, rendere comunque utilizzabile il dato finale: sarebbero necessari un

numero molto elevato di punti a terra presi con metodologie topografiche (GPS o, in mancan-

za di segnale, con Total Station) sempre ammesso però che le immagini non siano distorte al

punto tale da non poter riconoscere sulla scena (vedi Figura 2.2.1). Tutto ciò però ha un limi-

te, prevalentemente economico, superato il quale si ritiene più utile effettuare nuovamente un

volo: ecco quindi l’importanza di tali strumentazioni di bordo quando si fa uso di sensori

scanner. Immagini ottenute con tali sensori vanno quindi sempre trattate per correggere tali

errori geometrici sviluppatisi durante l’acquisizione dei dati.

2.3 - PROCEDURE POST-ACQUISIZIONE

Il dato appena acquisito dal satellite non è certamente un dato finito, è anzi un dato “grez-

zo”: come descritto nel paragrafo 1.3.2, è il segmento terrestre, e quindi l’ente stesso che ge-

stisce la piattaforma, che si occupa dell’archiviazione e di un trattamento primario dei dati,

41

Capitolo 2 Elaborazione ed interpretazione delle immagini

trattamento che precede sempre la cessione dell’immagine all’acquirente o all’ente che ne fa

richiesta.

Soffermandoci sulle riprese satellitari, si devono distinguere due tipologie di correzioni

che vengono inserite in quello che si chiama Image Preprocessing (8): le correzioni radiome-

triche e geometriche.

Durante tali fasi di correzione, il dato acquisito dal sensore, che rappresenta la radianza

incidente registrata in forma digitale come DN ad un certo numero di bit, viene trasformato in

una informazione relativa alla superficie indagata. In pratica, con le correzioni si passa da un

segnale registrato al sensore ad una caratteristica della superficie reale [Valentini et al., 2006].

2.3.1 - CORREZIONI RADIOMETRICHE

Tali correzioni servono a calibrare i sensori, ridurre o eliminare gli errori dovuti al loro

cattivo funzionamento e ridurre l’influenza dello strato di atmosfera interposto tra sensore e

oggetto osservato (la Terra). Essi includono [http://tlclab.unipv.it]:

a. Ripristino di linee e pixel saltati

b. Equalizzazione del sensore

c. Calibrazione del sensore

d. Correzione degli effetti di terreno

e. Correzione atmosferica

Analizziamo brevemente queste singole correzioni.

a. Ripristino di linee e pixel saltati

Può accadere che durante la scansione di una scena o la memorizzazione dei dati, per mal-

funzionamenti temporanei o errori di trasmissione dovuti ad esempio a cadute di tensione

o a perdite di segnale, possa verificarsi un’alterazione o perdita di un singolo dato o di una

sequenza di dati che si traducono in pixel con valori anomali o in righe di pixel nere o uni-

formemente grigie (dette anche Drop Line): tali dati ovviamente non hanno nulla a che fa-

(8) - Non sempre si sottolinea la differenza tra pre-elaborazione dell’immagine (Image Preprocessing) ed elaborazione

dell’immagine (Image Processing), poiché tale differenza è molto sfumata: in realtà è rilevante poiché identifica due tipo-logie di trattamento del dato, una che viene effettuata comunque dalla ditta gestore della piattaforma una volta acquisito il dato e che permette all’utente di utilizzare in maniera proficua i dati [http://tlclab.unipv.it], e l’altra che viene effettuata dalla stessa ditta (su richiesta del committente) o dal committente stesso, ma che comunque non rappresenta una procedu-ra strettamente essenziale e che dipende dal fine ultimo per il quale si è richiesta la scena satellitare.

42

Capitolo 2 Elaborazione ed interpretazione delle immagini

re con il valore effettivo della grandezza acquisita in quella posizione (o posizioni se si

tratta di una riga).

Figura 2.3.1 - Immagine pancromatica in cui sono presenti tre Drop Line.

Per correggere tale errore si applicano tecniche fondamentalmente semplici; nel caso di un

pixel saltato si può:

- sostituire il pixel con il valore del pixel precedente o successivo della riga

, , 1 , , 1(precedente) (successivo)i j i j i j i jDN DN DN DN− += =

- sostituire il pixel con la media dei vicini della stessa riga

, 1 , 1, 2

i j i ji j

DN DNDN − ++

=

- sostituire il pixel mediante la stima basata sulla media dei vicini e sulla correlazione

tra bande qualora la ripresa fosse multispettrale;

- sostituire il pixel ricavando un valore medio tra i valori dei pixel vicini, utilizzando

finestre mobili (normalmente chiamate finestre) di dimensioni 3 × 3 o 5 × 5;

nel caso di una linea si può:

43

Capitolo 2 Elaborazione ed interpretazione delle immagini

- sostituire l’intera linea con quella precedente o con quella successiva;

- sostituire l’intera linea con la media della precedente e della successiva;

- operare con metodi più complessi che si basano, similmente al singolo pixel, alla cor-

relazione tra bande nel caso di ripresa multispettrale.

b. Equalizzazione del sensore

Nei sistemi a scansione ottico-meccanica, ad ogni oscillazione dello specchio il singolo

rivelatore registra una linea di pixel. Per varie cause, può accadere che le funzioni di tra-

sferimento dei dati dal sensore al registratore non siano identiche per tutti i rivelatori, o

che uno dei rivelatori non sia ben calibrato rispetto agli altri. Ciò comporta un effetto di

striatura regolare nell’immagine (striping) visibile soprattutto sulle superfici omogenee

quali ad esempio la neve e l’acqua [http://tlclab.unipv.it]. In figura 2.3.2 si ha un esempio

di una scansione fatta con un sensore a 17 rivelatori, ed una riga corrispondente ad uno di

essi è più chiara di circa 4-5 DN in una banda ad 8 bit.

Figura 2.3.2 - Immagine pancromatica affetta da effetto striping [http://earth.esa.int]

44

Capitolo 2 Elaborazione ed interpretazione delle immagini

L’effetto può essere ridotto rielaborando a posteriori i dati acquisiti in modo da conforma-

re le risposte apparenti dei diversi rivelatori. A tal proposito sono possibili più tecniche:

- Tecnica lineare: si basa sull’assunzione che mediamente tutti i rivelatori “vedono”

una distribuzione simile di coperture del suolo all’istante di acquisizione t e quindi

una distribuzione simile di DN, e che i rivelatori siano lineari;

- Tecnica basata sulla conformazione degli istogrammi: rimuove l’ipotesi di compor-

tamento lineare dei sensori;

- Altre tecniche basate ad esempio sul filtraggio spaziale.

Figura 2.3.3 - Sulla sinistra l’immagine prima che venga trattata per l’effetto striping, sulla destra la stessa immagine dopo essere stata corretta [http://tlclab.unipv.it]

c. Calibrazione del sensore

Con questa operazione si fa riferimento alle procedure che permettono di convertire i DN

rilevati in valori fisici di radianza (Lλ) secondo l’equazione

λ λ λL rumore DN guadagnoλ= + ×

In figura 2.3.4 è rappresentata la retta funzione di calibrazione: per conoscerne

l’andamento si devono quindi ricavarne i parametri (il coefficiente angolare m e il termine

noto q). Tale operazione non è semplice poiché, se pur noti dalla casa costruttrice che li ci-

45

Capitolo 2 Elaborazione ed interpretazione delle immagini

9ta nei parametri di pre-lancio, tali valori variano col tempo ( ): il calcolo si effettua in ge-

nere con algoritmi che ne stimano l’entità, permettendo una valutazione accurata della ra-

dianza L al rilevatore.

Figura 2.3.4 - Funzione di calibrazione

La calibrazione radiometrica è particolarmente importante quando si intende confrontare

tra di loro i dati acquisiti da sensori differenti.

d. Correzione degli effetti del terreno

Sappiamo che la stima della riflettanza del bersaglio si fa sulla base della radiazione che

colpisce il sensore: tale radiazione è però influenzata dalle condizioni di illuminazione del

bersaglio e dalla sua posizione. L’allontanamento dalla situazione ideale è causato da:

• Riflessione non lambertiana;

• Superficie terrestre non piatta.

Per quanto esistano vari modi per correggere tale problema, il più accreditato rimane la

conoscenza di un modello numerico del terreno, ovvero di un DEM (Digital Elevation

Model), che migliora la correzione in funzione della sua risoluzione.

(9) - In fase di test a terra si fa il calcolo della curva di calibrazione mediante quelle che vengono chiamate sfere di calibrazione:

si definiscono quantitativamente la risposta del radiometro ad un segnale di ingresso noto mediante diverse coppie (Lλ, DNλ), utilizzando poi la regione lineare di tale curva

46

Capitolo 2 Elaborazione ed interpretazione delle immagini

e. Correzione atmosferica

La radianza viene attribuita in prima approssimazione integralmente all’oggetto osservato:

ciò non è propriamente vero, poiché la radiazione elettromagnetica che viaggia

dall’oggetto al sensore non attraversa il vuoto ma viaggia attraverso l’atmosfera che ne va

a modificare il valore effettivo. I gas atmosferici, gli aerosol ed i vapori contribuiscono ad

assorbire, diffondere e rifrangere la radiazione solare diretta e riflessa dalla superficie ter-

restre.

Una delle approssimazioni più utilizzate per mettere in relazione radianza al sensore e ri-

flettanza al bersaglio è: