NotedelCorsodiTermodinamicaeMeccanica Statisticaolla/statmec/note.pdf · compendio di...

Transcript of NotedelCorsodiTermodinamicaeMeccanica Statisticaolla/statmec/note.pdf · compendio di...

Note del Corso di Termodinamica e Meccanica

Statistica

Laurea Triennale in Fisica. Universita di Cagliari

Piero Olla

29 novembre 2013

Indice

1 Introduzione 5

2 Richiami di probabilita e statistica 72.1 Definizioni fondamentali . . . . . . . . . . . . . . . . . . . . . . . . . . . . 7

2.1.1 Probabilita congiunte e condizionate . . . . . . . . . . . . . . . . . 82.1.2 Il concetto di media . . . . . . . . . . . . . . . . . . . . . . . . . . . 9

2.2 Entropia ed informazione . . . . . . . . . . . . . . . . . . . . . . . . . . . . 102.3 Somme di variabili aleatorie: il limite termodinamico . . . . . . . . . . . . 132.4 Entropia ed equilibrio termodinamico . . . . . . . . . . . . . . . . . . . . . 152.5 Fluttuazioni . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 172.6 Processi stocastici e campi random . . . . . . . . . . . . . . . . . . . . . . 18

2.6.1 Il teorema di Wiener-Khinchin . . . . . . . . . . . . . . . . . . . . . 222.7 Probabilita dipendenti dal tempo . . . . . . . . . . . . . . . . . . . . . . . 232.8 Coarse graining e limite continuo . . . . . . . . . . . . . . . . . . . . . . . 272.9 L’equazione master . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 29

2.9.1 Cammino random . . . . . . . . . . . . . . . . . . . . . . . . . . . . 302.9.2 Processo di estinzione . . . . . . . . . . . . . . . . . . . . . . . . . 30

2.10 Esercizi . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 31

3 La teoria cinetica 333.1 Alcune problematiche in teoria cinetica . . . . . . . . . . . . . . . . . . . . 333.2 Alcune questioni riguardo il calcolo dell’entropia . . . . . . . . . . . . . . . 37

3.2.1 Entropia, partizioni e paradosso di Gibbs . . . . . . . . . . . . . . . 383.2.2 Entropia in una singola realizzazione . . . . . . . . . . . . . . . . . 40

3.3 L’equazione di Boltzmann . . . . . . . . . . . . . . . . . . . . . . . . . . . 413.3.1 La distribuzione di Maxwell-Boltzmann . . . . . . . . . . . . . . . . 433.3.2 Entropia e spazio delle velocita . . . . . . . . . . . . . . . . . . . . 443.3.3 Il teorema H . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 44

3.4 Il limite fluido . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 463.5 Equazioni fluide . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 483.6 Viscosita e diffusivita termica . . . . . . . . . . . . . . . . . . . . . . . . . 51

3.6.1 Diffusione in una miscela di gas . . . . . . . . . . . . . . . . . . . . 533.7 Dalla teoria cinetica alla termodinamica . . . . . . . . . . . . . . . . . . . 54

3

4 INDICE

3.7.1 Pressione e legge di stato . . . . . . . . . . . . . . . . . . . . . . . . 543.7.2 Energia termica . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 553.7.3 Calore e lavoro . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 563.7.4 Entropia e temperatura . . . . . . . . . . . . . . . . . . . . . . . . 57

3.8 Esercizi . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 59

4 Termodinamica 614.1 Processi reversibili e irreversibili . . . . . . . . . . . . . . . . . . . . . . . . 614.2 Diseguaglianze termodinamiche . . . . . . . . . . . . . . . . . . . . . . . . 634.3 Termodinamica: punto di vista macroscopico. . . . . . . . . . . . . . . . . 664.4 Lavoro massimo . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 694.5 I potenziali termodinamici . . . . . . . . . . . . . . . . . . . . . . . . . . . 704.6 Lavoro massimo e potenziali termodinamici . . . . . . . . . . . . . . . . . . 734.7 Sistemi a numero di particelle variabile . . . . . . . . . . . . . . . . . . . . 744.8 Entropia e potenziali termodinamici in una miscela di gas . . . . . . . . . . 764.9 Reazioni chimiche in una miscela di gas . . . . . . . . . . . . . . . . . . . . 78

4.9.1 Entalpia di reazione . . . . . . . . . . . . . . . . . . . . . . . . . . . 794.10 Transizioni di fase . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 79

4.10.1 Termodinamica dell’aria umida . . . . . . . . . . . . . . . . . . . . 834.11 Esercizi . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 84

5 Meccanica statistica dell’equilibrio 855.1 Il punto di vista di Gibbs . . . . . . . . . . . . . . . . . . . . . . . . . . . . 85

5.1.1 Il concetto di ensemble . . . . . . . . . . . . . . . . . . . . . . . . . 875.1.2 Il problema ergodico . . . . . . . . . . . . . . . . . . . . . . . . . . 89

5.2 Il concetto di entropia . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 905.3 Il metodo di massima entropia . . . . . . . . . . . . . . . . . . . . . . . . . 93

5.3.1 Cenni di statistica quantistica . . . . . . . . . . . . . . . . . . . . . 955.4 La distribuzione di Gibbs . . . . . . . . . . . . . . . . . . . . . . . . . . . . 985.5 Esercizi . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 100

6 Cenni alla teoria delle fluttuazioni 1016.1 Fluttuazioni attorno all’equilibrio . . . . . . . . . . . . . . . . . . . . . . . 1016.2 Struttura temporale delle fluttuazioni . . . . . . . . . . . . . . . . . . . . . 105

6.2.1 Il moto Browniano . . . . . . . . . . . . . . . . . . . . . . . . . . . 1066.2.2 Relazioni fluttuazione-dissipazione . . . . . . . . . . . . . . . . . . . 108

6.3 Reversibilita temporale . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 1126.3.1 Relazioni di Onsager . . . . . . . . . . . . . . . . . . . . . . . . . . 1136.3.2 Produzione di entropia . . . . . . . . . . . . . . . . . . . . . . . . . 114

6.4 Esercizi . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . . 117

Capitolo 1

Introduzione

Un problema fondamentale della fisica teorica e come determinare le proprieta di un sistemamacroscopico note quelle dei suoi costituenti elementari. In linea di principio, la dinamicadel sistema potrebbe essere ottenuta da una conoscenza esatta dello stato delle sue parti.Un simile bagaglio di informazione, pero, oltre ad essere impossibile da ottenersi, e ancheassolutamente ridondante: lo stato del sistema e descritto di solito per mezzo di un numeroristretto di variabili, dette appunto macroscopiche, le quali non dipendono dai dettagli delsistema. (Per conoscere la pressione di un gas, non e necessario conoscere posizione evelocita di tutte le sue molecole). Sistemi piu o meno complicati possono venire descrittiper mezzo di un numero piu o meno alto di variabili, ma il principio generale che unadescrizione completa non e necessaria, rimane valido.

Il passaggio a un livello di descrizione macroscopico comporta evidentemente una per-dita di informazione, e non e detto che una simile operazione sia sempre possibile. Unaprima condizione e che le interazioni tra i costituenti fondamentali siano semplici (cosı e nelcaso delle molecole di un gas; non altrettanto, per dire, nel caso dei neuroni in un cervelloumano). Questo fa sı che le variabili macroscopiche siano esse stesse funzioni abbastanzasemplici di quelle microscopiche (tipicamente somme). Una seconda condizione e quelladi una rapida perdita di memoria dello stato microscopico iniziale del sistema. Come direche le dinamica microscopica diventa ininfluente a scala macroscopica. Questo presupponeche la dinamica microscopica sia almeno in parte caotica. Il tema e controverso. Il soddi-sfacimento di una tale condizione – ragionevole, ma difficile da dimostrare – implicherebbeuna perdita di informazione nel passaggio dal micro al macro, dovuta non solo a motivi di“coarse graining”, ma anche di tipo dinamico, e costituirebbe in se, una giustificazione inpiu per disinteressarsi dei gradi di liberta microscopici del sistema.

Il fatto che le variabili macroscopiche possano essere ottenute come somme (o in generefunzioni semplici) delle variabili microscopiche, fa sı che le prime possano essere interpre-tate in senso statistico. (Un esempio e l’energia interna di un gas ideale monoatomicoU = (3/2)NKT , in cui (3/2)KT e l’energia cinetica media delle molecole). I concetti diprobabilita e statistica giocano quindi un ruolo centrale. Due approcci sono sostanzial-mente possibili: quello della teoria cinetica, originato dal lavoro di L. Boltzmann, e quellodella meccanica statistica, originato dal lavoro di J.W. Gibbs. Anche se l’utilizzo di queste

5

6 CAPITOLO 1. INTRODUZIONE

teorie si estende al giorno d’oggi ben oltre il campo della fisica, il loro ambito originaledi applicazione era quello dei sistemi termodinamici. Semplificando molto, la teoria ci-netica si interessa di piu a situazioni di non-equilibrio, mentre la meccanica statistica sipuo vedere come un insieme di tecniche per ottenere la termodinamica di sistemi di tipogenerico. In entrambi i casi, l’aspetto centrale e la trattazione probabilistica dei gradi diliberta microscopici del sistema.

Un ruolo essenziale nello stabilire la connessione tra mondo macroscopico e mondomicroscopico e giocato dall’entropia. A volte si descrive l’entropia come una misura didisordine. Si tratta purtroppo di una caratterizzazione assai ambigua, visto che non echiaro cosa si intende con il termine disordine. Sarebbe d’altra parte un po’ riduttivo,qualificare ad esempio i processi in un ciclo biologico come un incremento di disordine,anche se essi invariabilmente comportano un aumento di entropia. Di fatto, il concetto dientropia assume significati diversi a seconda del contesto. Tutti questi significati possonoessere pero ricondotti alla quantita di informazione persa nel passaggio a una descrizionemacroscopica del sistema. Nelle note che seguono, particolare attenzione verra data airuoli diversi che l’entropia gioca nei tre approcci cinetico, termodinamico e di meccanicastatistica, sottolineando in tutti i casi il suo il suo significato dal punto di vista della teoriadell’informazione (entropia di Shannon).

Le pagine che seguono contengono una presentazione a livello introduttivo di comefunzionano i due approcci cinetico e di meccanica statistica. Si tratta in gran parte di uncompendio di rielaborazioni ed estratti da testi classici. Per la parte di termodinamica,per quella di meccanica statistica e per il capitolo finale sulle fluttuazioni, si e preso comeriferimento “Fisica Statistica” di Landau e Lifstits, in particolare i paragrafi 7, 19-20, 31,40, 83, 93, 101-103, 110, 112, 118-120. Per quanto riguarda la teoria cinetica, possono essereutili per approfondimento i capitoli 3-5 del testo “Statistical Mechanics” di K. Huang. Unriferimento per i preliminari di probabilita e statistica possono essere i capitoli 5-6 del testo“A modern course in statistical physics” di L.E. Reichl.

Capitolo 2

Richiami di probabilita e statistica

2.1 Definizioni fondamentali

La probabilita e uno di quei concetti estremamente familiari, che sono molto difficili dadefinire in maniera formale. La definizione comunemente accettata e quella assiomaticadovuta a Kolmogorov, che da le proprieta minime che il concetto di probabilita deve sod-disfare, ma non dice alcunche su cio che essa deve rappresentare. Quello che rappresenta,noi lo sappiamo benissimo: una misura della nostra aspettativa del verificarsi di un certorisultato in un esperimento. Questo non e pero sufficiente per costruirci sopra una teoria(per dirne una: come si definisce il concetto di aspettativa?)

La definizione assiomatica di probabilita si ottiene a partire dai concetti elementarinella maniera seguente.

• Si da l’insieme dei possibili risultati di un esperimento, detto lo spazio dei cam-pioni Ω. Esempi: l’insieme Ω = 1, 0, x dei risultati di una partita nella schedina;l’insieme delle velocita che puo assumere le molecole in un gas: Ω = R3. In que-sto secondo caso, la quantita continua che si misura nell’esperimento e detta unavariabile random oppure variabile aleatoria.

• Si definisce evento un insieme di possibili risultati di una misura. In altre parole,un evento e un sottoinsieme di Ω. (Nel caso continuo, non tutti i sottoinsiemi sonoammissibili; non andiamo ad approfondire la problematica. Per chi e interessato,dare un occhiata a Wentzel, Teoria delle probabilita). Si dice che due eventi A e Bsono mutualmente esclusivi se hanno intersezione vuota.

• La probabilita di un evento A e un numero P (A), 0 ≤ P (A) ≤ 1 che soddisfale proprieta: P (A ∪ B) = P (A) + P (B) se A e B sono mutualmente esclusivi, eP (Ω) = 1.

Non male come economia di mezzi, per una definizione.Vale la pena verificare le proprieta intuitive che ci si aspetta dovrebbe avere la proba-

bilita (per esempio P (∅) = 0). Notare come la scrittura P (A ∪ B) non sia altro che unanotazione stenografica per dire: “probabilita che si verifichi un risultato in A o in B”.

7

8 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

Nel caso di una variabile random x, gli eventi sono tipicamente intervalli o unioni diintervalli. In tal caso si definisce la funzione densita di probabilita (PDF) ρ tramitela formula

P ([a, b]) =

∫ b

a

ρ(x)dx. (2.1)

La PDF e una funzione non negativa (convincersene!)Notare che lo stesso evento puo essere rappresentato con variabili random diverse; per

esempio, se x = y/2, l’intervallo A = [a, b] per x, corrisponde all’intervallo [2a, 2b] per y.L’evento puo essere fisicamente lo stesso (un certo intervallo di velocita in due unita dimisura diverse). Per evitare ambiguita, si utilizza spesso il pedice sulla PDF per indicarela variabile aleatoria a cui di si riferisce. Quindi, la (2.1) diventa

P (A) =

∫ b

a

ρx(z)dz =

∫ 2b

2a

ρy(z)dz (2.2)

(x e y sono le variabili aleatorie; z sono i loro valori). Prendendo intervalli infinitesiminella (2.2), troviamo ρx(z)dz = 2ρy(2z)dz. In generale: ρx(x)dx = ρy(y(x))dy(x), che cida la formula per il cambio di variabili tra PDF:

ρx(x) = ρy(y(x))∣

∣

∣

dy(x)

dx

∣

∣

∣(2.3)

La formula puo essere generalizzata a un numero maggiore di dimensioni servendosi deldeterminante Jacobiano al posto della derivata y′(x).

Ci chiediamo se e possibile definire eventi per variabili aleatorie, che non sono intervalli,bensı punti isolati. Possiamo farlo servendoci della delta di Dirac. Esempio:

ρ(x) = aδ(x) + bθ(x) exp(−x), x ∈ R. (2.4)

Abbiamo evidentemente P (0) = a. Per avere P (Ω) = 1, dobbiamo imporre b = 1− a.

2.1.1 Probabilita congiunte e condizionate

Dati due eventi A e B, definiamo probabilita congiunta di A B la probabilita dell’in-tersezione P (A ∩B). Esempio importante nel caso Ω ⊂ R2: sia A = [x, x+ dx]⊗ Ωy(x) eB = Ωx(y)⊗ [y, y + dy]. In tal caso

P (A ∩ B) = P ([x, x+ dx]⊗ [y, y + dy]) := ρxy(x, y)dxdy, (2.5)

che definisce la PDF congiunta dei valori x e y delle variabili aleatorie x e y. (A menoche non sia strettamente necessario, da ora in poi tralasciamo i pedici sulle PDF e nonfacciamo distinzioni fra variabili aleatorie e loro valori). Possiamo chiaramente definireoggetti intermedi che sono probabilita rispetto a una variabile e PDF rispetto ad un’altra(ad esempio integrando ρ(x, y) rispetto a x in un intervallo A).

2.1. DEFINIZIONI FONDAMENTALI 9

Definiamo di seguito la probabilita condizionata a B dell’evento A:

P (A|B) = P (A ∩B)/P (B). (2.6)

Essenzialmente, si tratta della probabilita dell’evento A considerando come spazio deicampioni l’evento B. Notare che di nuovo possiamo generalizzare a PDF:

ρ(x|y) = ρ(x, y)/ρ(y); P ([x, x+ dx]|y) = ρ(x|y)dx. (2.7)

(dimostrare quest’ultimo risultato a partire dalla definizione di P ([x, x+dx]⊗ [y, y+dy]).Diciamo che due eventi A e B sono statisticamente indipendenti se P (A ∩ B) =

P (A)P (B). Il concetto di probabilita condizionata ci permette una comprensione intuitivadi questa definizione. Se due eventi A e B sono statisticamente indipendenti abbiamoinfatti:

P (A|B) = P (A); P (B|A) = P (B). (2.8)

In altre parole, il condizionamento da un evento statisticamente indipendente non cambiala probabilita. Nel caso di PDF: ρ(x|y) = ρ(x), cioe il fatto che x si verifichera o meno,indipendentemente che si sia ottenuto o no y. Se abbiamo ρ(x, y) = ρ(x)ρ(y) ∀x, y, diciamoche le variabili x e y sono statisticamente indipendenti.

Per ultimo notiamo la seguente relazione, che discende direttamente dalla definizione(2.5):

ρ(x) =

∫

Ωy(x)

ρ(x, y)dy; ρ(y) =

∫

Ωx(y)

ρ(x, y)dx. (2.9)

Le PDF ρ(x) e ρ(y) sono dette in questo contesto marginali.

2.1.2 Il concetto di media

Definiamo la media di una funzione f di variabile aleatoria x tramite la seguente formula:

〈f〉 =∫

ρ(x)f(x)dx. (2.10)

Vediamo subito che ritroviamo la definizione standard nel caso di variabili discrete:

〈f〉 =∑

i

P (xi)f(xi)

che puo essere ottenuta dalla (2.10) generalizzando in maniera opportuna la (2.4).Possiamo fare medie a partire da PDF condizionate, ottenendo quindi medie condi-

zionate:

〈f |y〉 =∫

ρ(x)f(x|y)dx (2.11)

10 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

(notare che 〈f |y〉 e ora una variabile aleatoria, dipendendo dal risultato di y).Un po’ di ripasso di terminologia e notazioni. Tipicamente µx ≡ 〈x〉 e detta media

della PDF e σ2 = 〈(x− µx)2〉 = 〈x2〉 − 〈x〉2 e detta varianza della PDF (σx e la deviazione

standard o RMS). La media 〈xn〉 e detto momento n-esimo della PDF. La quantita 〈fg〉e detta correlazione di f e g. Caso importante:

Cxy = 〈xy〉 =∫

ρ(x, y)xydxdy (2.12)

Notare che indipendenza statistica di x e y implica Cxy = 0 ma non il viceversa (provarea costruire un controesempio).

Un oggetto particolarmente importante di cui prendere la media e la cosı detta funzioneindicatrice di un evento:

δA(x) =

1 se x ∈ A,

0 altrimenti.(2.13)

Troviamo infatti subito

〈δA〉 =∫

A

ρ(x)dx = P (A). (2.14)

Il concetto si generalizza in dimensione maggiore di uno.Possiamo definire la funzione indicatrice del valore della variabile aleatoria x, che

e semplicemente la delta di Dirac:

δx(x) ≡ δ(x− x) ⇒ 〈δx〉 = ρ(x). (2.15)

Le Eqs. (2.13-2.14) [e in certo qual modo anche la (2.15)] costituiscono il punto di partenzaper la determinazione statistica delle probabilita (e delle PDF) a partire dal concetto difrequenza.

2.2 Entropia ed informazione

Se la probabilita di un evento parametrizza la nostra aspettativa che l’evento si verifichio meno, la domanda che e naturale porsi, e il contenuto di informazione dei risultati diun esperimento, portato dal conoscerne la funzione di probabilita. Per dire: dato unesperimento del tipo testa o croce, e evidente che ne sappiamo di piu se la probabilitae P (testa) = 1 e P (croce) = 0 (o viceversa), invece che se P (testa) = P (croce) = 1/2.Shannon ha trovato un modo naturale di parametrizzare questo contenuto di informazione,inventandosi una definizione di entropia, che non e l’entropia termodinamica, ne quella dellameccanica statistica, ma che in realta ha molto a che fare con entrambe. Come vedremo,l’entropia introdotta da Shannon, non parametrizza il contenuto di informazione di unadistribuzione, bensı quello di “ignoranza”, cioe la quantita di informazione che bisgnasupplire per sapere con esattezza il risultato di un esperimento.

2.2. ENTROPIA ED INFORMAZIONE 11

Ω

ΑΑ

ΑΑ

ΑΑ6

5

4

3

2

1

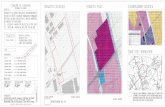

Figura 2.1: Partizione di un dominio bidimensionale Ω (spazio dei campioni).

Iniziamo subito con il chiarire che il contenuto di informazione dipende dal tipo diesperimento. Nel caso “testa o croce”, la questione puo sembrare ovvia, ma nel caso checi riguarda, quello di variabili random, non e cosı: non possiamo misurare una variabilerandom con infinita precisione. Di fatto possiamo misurare soltanto eventi. Introduciamosubito, quindi, il concetto di partizione di Ω (vedi Fig. 2.1) come una collezione di eventiAi mutualmente esclusivi, tali che la loro unione e Ω:

P = Ai, i = 1, . . . ; Ai ∩ Aj = ∅ se i 6= j; ∪iAi = Ω. (2.16)

Definiamo quindi l’entropia di Shannon della distribuzione P riferita alla partizione Pdi Ω tramite la formula

S[P ] = −∑

i

P (Ai) lnP (Ai) = −〈lnP 〉, (2.17)

dove la notazione S[P ] e una abbreviazione per S(Pi, i = 1, . . .). Vediamo subito che nelcaso “testa o croce” le cose tornano. In questo caso, banalmente P ≡ testa, croce. SeP (testa) = 1 oppure P (croce) = 1 (moneta truccata) abbiamo evidentemente S[P ] = 0(sappiamo il risultato; ignoranza minima; ma anche entropia minima, giacche 0 ≤ P ≤ 1 ⇒lnP ≥ 0 ⇒ S[P ] ≥ 0). Nel caso P (testa) = P (croce) = 1/2, abbiamo invece S[P ] = ln 2(massima ignoranza).

Di fatto le cose tornano molto bene. Cerchiamo di capire il perche.L’aspetto centrale e che l’entropia e nella forma

S[P ] =∑

i

g(Pi),

con g(P ) una funzione convessa dell’argomento. In altre parole vale la relazione

g(Pi) ≤ g(P ), (2.18)

dove x = 1N

∑Ni=1 xi e la media aritmetica degli xi. Il risultato e mostrato in Fig. 2.2, nel

caso di due eventi A1 e A2, aventi probabilita rispettivamente P1 e P2. Il loro contributoall’entropia e g(P1) + g(P2) = 2g(P ). Se le probabilita fossero uguali, mantenendo le altreprobabilita Pi, i = 3, . . . invariate (questo massimizza l’ignoranza solo rispetto ai primi due

12 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

g(P)

g(P)

P P1 2P

g

1 P

Figura 2.2: Rappresentazione grafica della relazione (2.18) nel caso N = 2.

eventi), avremmo P (A1) = P (A2) = (P1+P2)/2 = P . In tal caso il contributo all’entropiasarebbe 2g(P ) ≥ 2g(P ).

Questo esempio ci da un’illustrazione come l’entropia cresca con l’ignoranza, e sia ne-cessariamente massima quando tutti gli eventi hanno ugual probabilita. E come cio siaconseguenza del fatto che S[P ] e una somma di funzioni convesse della probabilita deglieventi.

L’informazione che deve essere supplita per conoscere lo stato del sistema dev’essere dinuovo aumentata se raffiniamo la partizione, per esempio se spacchiamo l’evento A6 in Fig.2.1 in due eventi A61 e A62 con A61 ∩ A62 = ∅ e A61 ∪ A62 = A6. Vediamo che di nuovol’entropia di Shannon si comporta bene ed aumenta in risposta al raffinamento. Infatti,il contributo alla entropia rimane g(A6) solo se tutta la probabilita di A6 si concentra inuno solo dei due nuovi sotto-eventi. In caso contrario, per quanto detto precedentemente,a causa della convessita di g, S dovra aumentare.

Un’altra proprieta, che ci immaginiamo debba godere un concetto di informazione pro-priamente definito, e che l’informazione riferita a due sistemi indipendenti sia la sommadelle informazioni riferite singolarmente a ciascuno. Quindi l’entropia deve essere additi-va se Ω = ΩA ⊗ ΩB, P = PA ⊗ PB e tutti gli eventi sono statisticamente indipendenti:P (Ai, Bj) = PA(Ai)PB(Bj). Da qui troviamo:

S[P ] = −∑

ij

P (Ai, Bj) ln(P (Ai, Bj) =

= −∑

ij

[PA(Ai)PB(Bj) lnPB(Bj) + PB(Bi)PA(Aj) lnPA(Aj)]

= −∑

i

[PB(Bi) lnPB(Bi) + PA(Ai) lnPA(Ai)] = S[PB] + S[PA]. (2.19)

Vediamo quindi che il logaritmo e importante...Nel tragitto a ritroso che compiremo dalla entropia di Shannon alla entropia termodi-

namica, vedremo che la proprieta di addittivita legata alla funzione logaritmica e essenzialeper aveve una termodinamica estensiva. La proprieta di convessita e in certo qual modopiu fondamentale ed ha a che fare con la possibilita di definire un concetto di equilibrio ter-modinamico. Un ambito di ricerca piuttosto attivo (e controverso) riguarda capire se per

2.3. SOMME DI VARIABILI ALEATORIE: IL LIMITE TERMODINAMICO 13

sistemi fortemente correlati (per cui una suddivisione in parti poco interagenti, al contrarioche in un gas, non e possibile), potrebbe aver senso una termodinamica “non estensiva”,costruita a partire da una definizione di entropia senza logaritmi.

Ritornando alla definizione originaria di entropia, Eq. (2.17), ci si potrebbe domandarese e possibile in qualche maniera definire una entropia non associata alla scelta di unapartizione. La risposta e “ni”. Esiste sı una particolare scelta di partizione uniforme (in1D sarebbe Ai = [xi, xi+1] con xi = i∆x), per cui

S[P ] ≃ −∫

ρ(x) ln(ρ(x)∆x)dx = −∫

ρ(x) ln ρ(x)dx− ln∆x (2.20)

e la funzione Sρ = −∫

ρ(x) ln ρ(x)dx e detta entropia di PDF. A parte la difficolta evidentenella definizione di S[P ] nel caso di una partizione infinitamente fine, una partizione involumetti infinitesimi, come vedremo ben presto, non e pero la piu appropriata per isistemi a cui siamo interessati. La scelta della partizione nella definizione dell’entropia none irrilevante.

2.3 Somme di variabili aleatorie: il limite termodina-

mico

Oggetto della statistica e la stima di medie e probabilita, a partire da medie campionariee frequenze. Di fatto, esiste una interpretazione empirica della probabilita come limite difrequenze e medie campionarie, considerata piu intuitiva (ma di sicuro meno soddisfacente)di quella assiomatica standard. Il concetto di media campionaria e definito nella manieraseguente: data una sequenza di esperimenti identici e indipendenti (tali cioe che i valoridella variabile aleatoria misurata in ciascun esperimento, siano statisticamente indipendentie identicamente distribuiti, abbreviato, i.i.d.), si definisce media campionaria 〈x〉N dellavariabile aleatoria x tramite la formula

〈x〉N =1

N

N∑

k=1

xk, (2.21)

dove xk e il risultato del k-esimo esperimento. La frequenza PN(A) dell’evento A eottenuta in maniera analoga a partire dalla definizione di funzione indicatrice (2.13) edalla (2.14)

PN(A) = 〈δA〉N . (2.22)

La connessione fra la definizione di media campionaria e lo studio dei sistemi termodina-mici risiede nel fatto che questi ultimi sono descritti da grandezze (ad esempio l’energia,oppure il numero di molecole in un volume), che sono somme delle corrispondenti variabilidelle singole molecole (energia della molecola; la funzione indicatrice riferita al volume dellamolecola). Se le molecole sono in prima approssimazione indipendenti, l’energia termica

14 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

nel volume, il numero di molecole, si comporteranno come somme di un gran numero di va-riabili aleatorie indipendenti, e, se il sistema e omogeneo, esse saranno anche identicamentedistribuite. Precisamente come la somma che appare a lato destro della (2.21).

Ci si riferisce di solito alla condizione che le fluttuazioni nel valore di una grandezzamacroscopica XN diventino trascurabili nel limite di N molto grande, come a una con-dizione di limite termodinamico. Sotto le ipotesi indicate sopra, i concetti di limitetermodinamico e di legge dei grandi numeri diventano equivalenti.

In realta, una media campionaria, cosı come una somma di varialbili aleatorie, sono an-cora variabili aleatorie. Il fatto che le fluttuazioni intorno alla media diventino trascurabiliper N grande e il contenuto della ben nota legge dei grandi numeri. Nel caso di unasomma di variabili aleatorie i.i.d. XN =

∑Ni=1 xi, con media e varianza finite:

µXN= Nµx; σXN

= N1/2σx (2.23)

e quindi σXN/µXN

= N−1/2σx/µx. In altre parole, la fluttuazione relativa δXN/XN eO(N−1/2) e XN cessa di essere aleatoria nel limite N → ∞. Se pensiamo a XN co-me a una variabile fisica macroscopica, abbiamo evidentemente una condizione di limitetermodinamico.

Verifichiamo la (2.23) in maniera esplicita.Abbiamo immediatamente per linearita della operazione di media µXN

= NµX . Calco-liamo la varianza di XN :

σ2XN

= 〈[N∑

i=1

(xi − µx)]2〉 =

N∑

ij=1

〈(xi − µx)(xj − µx)〉

Essendo pero le differenti xi statisticamente indipendenti, abbiamo per j 6= j 〈(xi−µx)(xj−µx)〉 = 〈(xi − µx)〉〈(xj − µx)〉 = 0 e quindi

σ2XN

=N∑

i=1

〈(xi − µx)2〉 = Nσ2

x,

che ci da la seconda delle (2.23). Notiamo che dividendo la (2.23) per N , ritroviamo lalegge dei grandi numeri nella sua formulazione standard:

〈〈x〉N〉 = 〈x〉; σ2〈x〉N

=σ2x

N. (2.24)

Un ulteriore risultato, detto teorema del limite centrale, ci dice che le deviazioni XN−µXN,

nel limite di grandi N , sono distribuite secondo una Gaussiana:

ρ(XN) =1

(2π)1/2σXN

exp(

− (XN − µXN)2

2σ2XN

)

. (2.25)

La dimostrazione generale della (2.25) puo essere trovata ad esempio nel libro di MeccanicaStatistica di Reichl, oppure nel capitolo sulle fluttuazioni di densita del testo “Fisica Sta-tistica” di Landau e Lifstits. Una delle conseguenze delle (2.23-2.25) e che per N grande,

2.4. ENTROPIA ED EQUILIBRIO TERMODINAMICO 15

una misura di XN dara quasi sempre un risultato XN ≃ 〈XN〉, il valore di equilibrio dellagrandezza macroscopica XN , cioe il valore piu probabile di XN .

Nota Vale il risultato generale che la somma di variabili Gaussiane e essa stessa una va-riabile Gaussiana. Il modo piu semplice di dimostrarlo e lavorando in spazio di Fourier. Sez = x+ y, con x e y variabili Gaussiane (e sufficiente considerare il caso in cui hanno en-trambe media nulla), possiamo scrivere ρz(z) = 〈δ(x+y− z)〉 =

∫

dx∫

dy ρx(x)ρy(y)δ(x+y − z) =

∫

dxρx(x)ρy(z − x). Abbiamo per le trasformate di Fourier di ρx e ρy: ρx(k) =

(2πσ2x)

−1/2∫ +∞

−∞exp(−x2/(2σ2

x) − ikx)dx = exp(−(1/2)σ2xx

2) e analoga espressione perρy(k). Da qui, sfruttando il fatto che la trasformata di Fourier di una convoluzione eun prodotto: ρz(k) = ρx(k)ρy(k) = exp[−(1/2)(σ2

x + σ2y)k

2], che mi dice che ρz(z) e unaGaussiana con varianza σ2

z = σ2x + σ2

y.

Come esempio di limite termodinamico, consideriamo il caso in cui la variabile aleatoriaassociata alla molecola k-esima e δVa(xk) con con xk la coordinata della molecola, e Va unsottovolume (macroscopico) del volume totale V occupato dal gas. La variabile d’interessesara percio il numero istantaneo Na di molecole nel volume Va (dal punto di vista proba-bilitico, il problema di determinare il numero di punti distribuiti a caso che cadono in uncerto dominio Va e detto problema dei punti di Poisson).

Supponendo il sistema spazialmente omogeneo (che e quanto ci si aspetta all’equilibriotermodinamico), la probabilita di trovare una molecola data in Va sara

P (xk ∈ Va) ≡ 〈δVa〉 = Va/V

e il numero medio di molecole in Va sara

Na = 〈Na〉 = N〈δVa〉 = NVa/V ≡ nVa,

dove n = N/V e la densita media del gas in V . Per calcolare la fluttuazione, dobbiamodeterminare σ2

δVa. Abbiamo

〈δ2Va〉 = 〈δVa〉 = Va/V

e pertantoσ2δVa

= 〈δ2Va〉 − 〈δVa〉2 = Va/V (1− Va/V ).

Se V viene mandato ad infinito e Va rimane fissato, possiamo trascurare il termine qua-dratico in Va/V e troviamo per la fluttuazione

σ2Na

= Nσ2δVa

≃ Na ⇒δNa

Na

= O(N−1/2a ). (2.26)

In particolare, la fluttuazione di densita in un volume Va sara δna = δNa/Va = (Van)−1/2n.

2.4 Entropia ed equilibrio termodinamico

La caratteristica piu importante dell’entropia termodinamica e quella di esprimere l’ap-proccio all’equilibrio termodinamico, come un processo di crescita di entropia. Vediamo

16 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

che l’entropia di Shannon ha tutte le carte in regola per svolgere un simile ruolo. Con-sideriamo come sistema un gas ideale di N particelle, posto in un recipiente di volumeV , in assenza di forze esterne. Interessiamoci del processo che porta da una situazioneiniziale in cui il gas era confinato in una parte del recipiente Va ⊂ V , a una condizione diequilibrio, in cui le molecole sono sparpagliate in tutto V . Cerchiamo di parametrizzarel’approccio all’equilibrio in modo piu quantitativo, e concentriamoci su una quantita comeil numero di molecole medio in Va, all’istante t: Na(t) ≡ 〈Na(t)〉. La quantita Na(t) indicail numero di occupazione istantaneo di Va, e immaginiamo la media effettuata attraversoun gran numero di esperimenti a partire dalla stessa configurazione iniziale, in cui tuttele molecole erano in Va. Cercheremo di essere piu precisi, nel seguito, su come definireconcetti quali medie e probabilita dipendenti dal tempo. Procedendo in maniera intuitiva,possiamo tuttavia provare a descrivere l’approccio all’equilibrio termodinamico attraversouna relazione come

limt→∞

Na(t) = Na = NVa/V.

Abbiamo visto nella sezione precedente che il numero istantaneo di molecole in Va puo esserescritto come Na(t) =

∑Ni=1 δVa(xi(t)). Possiamo quindi scrivere Na(t) = NP (Va; t), dove

P (Va; t) e la probabilita che una molecola data, si trovi all’istante t in Va. La transizioneall’equilibrio termodinamico puo essere quindi espressa in termini di probabilita attraversola relazione P (Va; t) → P (Va) = Va/V .

Questo ci da un suggerimento per ottenere dalla entropia di Shannon una entropiacon significato termodinamico. Suddividiamo il volume V in sottovolumi identici Va,a = 1, 2 . . . , K, che rispecchia la nozione che a priori punti diversi del recipiente devonoessere considerati equivalenti. Scopriamo subito che l’entropia di Shannon associata allapartizione uniforme Va, S[P ] = −∑

a P (Va; t) lnP (Va; t) sara massima all’equilibrio termo-dinamico S[P ] = lnK. Vedremo in seguito come la teoria cinetica (teorema H) ci permettedi mostrare che l’entropia raggiunge il suo valore di equilibrio attraverso un processo dicrescita monotona. Ci limitiamo a notare, per il momento, l’importanza della scelta dellapartizione nella procedura. La scelta di una partizione uniforme e cio che ci ha permesso divedere l’entropia di Shannon come una misura del grado di sparpagliamento delle molecolenel recipiente. Altre scelte avrebbero prodotto una definizione di entropia corretta dalpunto di vista formale, ma priva di significato dal punto di vista termodinamico. Vedremonella Sez. 3.2.1 un altro esempio di come una scelta appropriata della partizione risultifondamentale per ottenere una entropia dotata di significato termodinamico.

Cosı come abbiamo fatto con la distribuzione di probabilita P (Va, t), possiamo calco-lare l’entropia della distribuzione istantanea P (Va, t) = Na/N . Essa gioca nei confrontidi P (Va, t), lo stesso ruolo che la frequenza PN(A), definita nella Eq. (2.22), giocava neiconfronti della probabilita P (A): cosı come, per la legge dei grandi numeri, P (A) e lafrequenza piu probabile, P (Va, t) sara, nel limite termodinamico, la distribuzione istanta-nea P (Va, t) osservata con maggiore probabilita. Troviamo quindi che la distribuzione diequilibrio P (Va) e allo stesso tempo la distribuzione corrispondente al massimo di entropiae la distribuzione istantanea P (Va) osservata con maggiore probabilita all’equilibrio.

2.5. FLUTTUAZIONI 17

2.5 Fluttuazioni

Continuiamo a considerare l’esempio del gas in un volume V , analizzato nelle ultime duesezioni. La condizione di limite termodinamico ci permetteva di approssimare il numeroistantanteo di molecole Na(t) in un volumetto Va ⊂ V sufficientemente grande, con il suovalore medio Na(t) = 〈Na(t)〉. A causa del carattere casuale dei moti delle molecole, e dellapossibilita di moti macroscopici turbolenti, causati da eventuali condizioni di non equilibrio,una componente di fluttuazione Na−Na sara comunque presente. Per caratterizzare questefluttuazioni, e conveniente definire, a partire dai numeri di occupazione Na(t) ed Na(t),densita istantanee e medie, coarse grained a scala Va:

nVa(x, t) =Na(x, t)

Vae nVa(x, t) = 〈nVa(x, t)〉.

Concentriamoci sulla struttura spaziale delle fluttuazioni. Come si e detto, queste avran-no in condizioni di non equilibrio sia una componente microscopica che una macroscopica.Continuiamo a considerare il caso di un gas di molecole non interagenti (gas ideale). Consi-deriamo inizialmente un condizione di equilibrio, di modo che sicuramente solo fluttuazionimicroscopiche sono presenti. Abbiamo quindi n(x, t) = n = N/V e le fluttuazioni sonogovernate dalla legge (2.26). In termini di densita, possiamo scrivere

σ2n(Va) ≡ 〈(nVa − n)2〉 = n(v/Va)

1/2,

dove v = 1/n e il volume moleculare del gas. Vediamo quindi che la condizione per cui lefluttuazioni microscopiche possono essere trascurate e Va ≫ v, nel qual caso nVa(x, t) ≃ n.

In condizioni di non equilibrio, saranno in generale presenti fluttuazioni macroscopiche,la cui scala caratteristica l sara essa stessa, per definizione, macroscopica l ≫ v1/3. Sescegliamo v ≪ Va ≪ l3, avremo quindi che nVa(x, t) sara ancora una quantita fluttuante,ma la componente microscopica delle fluttuazioni non c’e piu. Abbiamo inoltre due fattiimportanti:

• La differenza di nVa(x, t) tra volumetti Va adiacenti e piccola (dell’ordine di V1/3a /l).

Questo implica che e possibile eseguire un limite continuo su nVa .

• Lo stesso fatto che nVa varia poco a scala Va, implica che la dipendenza sul parametrodi coarse graining Va e debole (a patto naturalmente che v ≪ Va ≪ l3).

Eseguendo la media troviamo quindi una densita indipendente da Va, n(x, t) = 〈n(x, t)〉, ilcui profilo avra una scala di variazione L sara tipicamente maggiore di l, e la cui scala divariazione temporale, che identifica il tempo di rilassamento all’equilibrio del sistema, saratipicamente piu lunga di quella delle fluttuazioni (sia microscopiche che macroscopiche).

Nota Osserviamo che la discussione che abbiamo effettuato e basata su diverse ipotesiche non sono in generale soddisfatte. In primo luogo, non e detto che una separazionetra fluttuazioni discrete e macroscopiche esista sempre. Condizioni di non equilibrio pos-sono benissimo verificarsi a scale dell’ordine della separazione tra le molecole. Se il gas

18 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

e sufficientemente rarefatto, un simile risultato potrebbe essere prodotto infatti anche dal-l’azione di un corpo macroscopico. In altre parole, non e detto che fluttuazioni generateda condizioni di non equilbrio siano necessariamente macroscopiche. Allo stesso tempo,non e detto che fluttuazioni microscopiche siano possibili nel sistema. La presenza di in-terazioni fra le molecole (in generale, tra i costituenti microscopici del sistema), potrebbeinfatti produrre correlazioni a scala macroscopica, tali che fluttuazioni di taglia inferiorealla lunghezza di correlazione siano inibite. Come si vedra nel Capitolo 6, la scala ener-getica delle fluttuazioni in un sistema a temperatura T e data da KT , con K la costantedi Boltzmann. Pertanto, se la presenza di correlazioni impone che ciascuna fluttuazionecoinvolga un numero macroscopico di molecole, queste fluttuazioni avranno ampiezza tra-scurabile. (Esempio banale: in un solido, in cui ciascuna molecola e bloccata nella suaposizione dalle forze esercitate dai suoi vicini, fluttuazioni di concentrazione saranno pra-ticamente assenti). Di nuovo pero ci sono eccezioni: in presenza di transizioni di secondaspecie (magneti al punto critico e simili), il contenuto energetico di fluttuazioni a scalamacroscopica puo tendere a zero, e anche l’ampiezza di tali fluttuazioni sara macroscopica.In altre parole, abbiamo un sistema che, sebbene all’equilibrio termodinamico, e caratteriz-zato da fluttuazioni macroscopiche, per cui il concetto stesso di limite termodinamico none ben definito.

2.6 Processi stocastici e campi random

Come si e detto, il passaggio da una descrizione microscopica di un sistema, ad una macro-scopica, sottointende una perdita di informazione. Operativamente, cio si concretizza inuna trattazione probabilistica dei gradi di liberta microscopici. La scelta diventa naturalese la dinamica alla microscala ha una componente intrinsecamente casuale, nel senso chee difficile prevedere l’evoluzione del sistema, a scala microscopica, a partire da una con-dizione iniziale data. Simili comportamenti casuali possono essere presenti anche a scalamacroscopica, lontano dall’equilibrio; un esempio sono le fluttuazioni turbolente. Diventaquindi necessario introdurre strumenti matematici in grado di descrivere grandezze fisicheche assumono istantaneamente valori casuali, che non saranno in generale indipendenti,come era nel caso degli esperimenti indipendenti considerati nella Sez. 2.3. In alternativa,potremmo desiderare descrivere l’andamento di campi fluttuanti sia nello spazio che neltempo, come ad esempio il campo di velocita in un flusso turbolento. Alcuni esempi diprocessi che potremmo voler descrivere:

1. L’uscita di un generatore di rumore; oppure la posizione di un batterio in una capsuladi Petri; oppure la velocita del vento misurata da un anemometro.

2. I valori della velocita del vento a un dato istante, misurati in una certa regionespaziale; oppure i valori di densita dei batteri nella capsula di Petri in questione aun dato istante, ma in diverse posizioni.

3. I valori della velocita del vento a diversi istanti di tempo e posizioni spaziali. Eccetera.

2.6. PROCESSI STOCASTICI E CAMPI RANDOM 19

Abbiamo a che fare con un insieme di valori casuali associati a diversi istanti di tempo(caso 1); diverse posizioni spaziali (caso 2); diverse posizioni spaziali e istanti di tempo(caso 3). Diamo pertanto le seguenti definizioni:

• Si chiama processo stocastico una sequenza di variabili aleatorie indicizzate con iltempo. Si ha un processo discreto se l’indicizzazione e discreta; per esempio, ψ(tn),tn = n∆t. Si ottiene un processo continuo, evidentemente, come limite ∆t → 0 diun processo discreto.

• Si parla di campo random, quando l’indicizzazione e fatta nello spazio (o nellospazio tempo). Per esempio: ψ(xn, tm).

Queste definizioni ci costringono a rivedere tutti i concetti di spazio dei campioni, risultatodi misura e probabilita, che abbiamo utilizzato sin’ora nel caso delle variabili aleatorie. Perfissare le idee, ci concentriamo sul caso di un processo stocastico, essendo la generalizzazioneal caso di un campo random abbastanza naturale.

Osserviamo in primo luogo che, mentre il risultato di una misura, nel caso di unavariabile aleatoria, era un numero reale, nel caso di un processo stocastico, e da intendersicome risultato l’intera sequenza di valori ψ(tn), n = 1, 2, . . . assunti da ψ agli istanti tn.Per dire, nel caso di un generatore di rumore, l’esperimento e da intendersi l’accensionedello strumento e la registrazione dei dati in un intervallo di tempo, e non la misura di unsingolo dato ψ a un dato istante t.

• Chiamiamo realizzazione del processo stocastico, la sequenza ψ(tn), n = 1, 2, . . .risultante da un dato esperimento.

Vediamo che, mentre nel caso di una variabile aleatoria, Ω era un’intervallo dei reali,nel caso di un processo stocastico, Ω e uno spazio di funzioni (di variabile discreta se ilprocesso discreto, di variabile reale se il processo e continuo).

Abbiamo inoltre che, mentre una variabile aleatoria x era caratterizzata da una PDFρ(x) che e una funzione di variabile reale, nel caso di un processo stocastico discreto,avremo una PDF nella forma ρ(ψ(tn), n = 1, 2 . . .), cioe una funzione che generalizzail caso di una PDF di un vettore random al caso in cui il vettore random puo avere unnumero arbitrario di componenti. Nel caso di un processo stocastico continuo, abbiamoaddirittura che la PDF, che in questo caso si indica solitamente utilizzando le parentesiquadre: ρ[ψ], e un “funzionale”, cioe una funzione che agisce da uno spazio di funzioni divariabile reale [le ψ(t)] al campo reale (i valori di ρ). Un esempio:

ρ[ψ] = N exp(

−∫ T

0

|ψ(t)|2dt)

. (2.27)

E in generale difficile lavorare con oggetti come la (2.27). Possiamo provare a ottenere unadescrizione “ridotta” della statistica di ψ, analoga a quella che si ottiene accontentandosinel dare media e varianza nel caso di una variabile aleatoria. Ecco alcuni esempi di oggettiche potrebbero fornirci una tale descrizione ridotta:

ρ(ψ(t)), ρ(ψ(t), ψ(t′)), . . . , (2.28)

20 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

cioe le PDF del valore di ψ a istanti dati, e

〈ψ(t)〉, 〈ψ(t)ψ(t′)〉, . . . , (2.29)

che sono dette funzioni di correlazione della ψ a un tempo, a due tempi, eccetera.L’utilita delle funzioni di correlazione e che ci permettono di parametrizzare in maniera

semplice il modo in cui la dipendenza statistica tra valori di ψ a tempi diversi diminuisceal crescere della separazione temporale. Abbiamo infatti per definizione:

〈ψ(t)ψ(t′)〉 =∫

dψ(t)

∫

dψ(t′) ρ(ψ(t), ψ(t′))ψ(t)ψ(t′)

e nel caso di variabili statisticamente indipendenti, cioe se ρ(ψ(t), ψ(t′)) = ρt(ψ(t))ρt′(ψ(t′)):

〈ψ(t)ψ(t′)〉 = 〈ψ(t)〉〈ψ(t′)〉.

Un indicatore del grado di dipendenza statistica e quindi fornito dalla quantita

C(t, t′) = 〈ψ(t)ψ(t′)〉 − 〈ψ(t)〉〈ψ(t′)〉, (2.30)

che sara massima per t = t′, con C(t, t) = σ2ψ(t), mentre ci si aspetta che tenda a zero per

|t−t′| → ∞. Possiamo introdurre un tempo di correlazione che ci dice per quali separazionitemporali le correlazioni possono iniziare a considerarsi trascurabili. Di solito si utilizza ladefinizione

τψ(t) =1

C(t, t)

∫ ∞

0

C(t, t+ τ)dτ (2.31)

[come dire, area sottesa da C(t, t + τ) uguale base, cioe τψ(t), per altezza, cioe C(t, t)].In termini di singola realizzazione del processo stocastico, il parametro τψ(t) ci dice essen-zialmente quanto bisogna aspettare prima che ψ(t + τ) differisca molto da ψ(t). In altreparole, il tempo di correlazione ci fornisce la scala di variazione temporale del processostocastico.

Le medie che compaiono nelle equazioni che abbiamo scritto sin’ora, possono esserestimate attraverso il calcolo di medie campionarie. Dobbiamo ricordarci pero che nel nostrocaso, queste medie campionarie sono di fatto medie su realizzazioni diverse (e indipendenti)dello stesso processo stocastico. Ora, ci sono molte situazioni in cui il processo stocastico,anche se descrive un qualche cosa che fluttua nel tempo, puo essere caratterizzato dauna statistica che e invece indipendente dal tempo; si parla in questo caso di statisticastazionaria. Intendiamo con cio che la PDF congiunta ρ(ψ(t1), ψ(t2), . . .) e invariante pertraslazioni temporali:1

ρ(ψ(t1), ψ(t2), . . .) = ρ(ψ(t1 + T ), ψ(t2 + T ), . . .), ∀ T.1Per contro, si dice spesso che un processo stocastico ha raggiunto uno stato stazionario, quando

la PDF condizionata ρ(ψ(t1), ψ(t2) . . . |ψ(t0)), t0 < t1 < t2 < . . ., di un processo stazionario, diventaindipendente dal condizionamento a t0. Tipicamente questo richiede che si prenda il limite t0 → −∞.Notare come il fatto che un processo sia stazionario non implica necessariamente che uno stato stazionariosia sempre raggiunto; vedere l’esempio del ping-pong a pagina 27.

2.6. PROCESSI STOCASTICI E CAMPI RANDOM 21

Questo implica naturalmente ρ(ψ(t)) = ρ(ψ), 〈ψ(t)〉 = 〈ψ〉 . . . e che le correlazioni di-pendono solo dalle differenze di tempo; in particolare C(t, t′) = C(t − t′). L’esempio piusemplice di processo stazionario che ci puo venire in mente, e quello che si ottiene mettendoin sequenza i risultati delle misure di una variabile aleatoria x: ψ(tn) ≡ x(n).

Nel caso di un processo stocastico costruito in questo modo, e abbastanza evidente checalcolare medie sulle realizzazioni come 〈ψ(tn)〉N = (1/N)

∑Nk=1 ψ

(k)(tn), [ψ(k)(tn) e il valore

di ψ(tn) nella n-esima realizzazione di ψ] diventa un’operazione inutilmente dispendiosa.Si puo infatti stimare 〈x〉, attraverso media campionaria 〈x〉N = (1/N)

∑Nk=1 x

(k), a partireda una sola realizzazione della ψ. Questo ci conduce a introdurre un nuovo tipo di media,la cosı detta media temporale:

〈ψ〉T =1

T

∫ T

0

ψ(t)dt, (2.32)

dove l’integrale, nel caso di un processo discreto, e sostituito dalla somma∑

n ψ(tn)∆t.Ovviamente, nel caso in cui il processo stocastico e il risultato di una sequenza di misure

indipendenti di una stessa variabile aleatoria, per costruzione, la media temporale e lamedia campionaria sulla variabile aleatoria coincidono. Ci domandiamo nel caso generale,quando una media temporale puo essere utilizzata per approssimare la media 〈.〉.

• Diciamo che un processo per cui la media temporale, per T → ∞, tende alla media〈.〉, gode della proprieta ergodica.

Ci aspettiamo che le condizioni che permettono il soddisfacimento della proprieta ergodicasiano:

• Che i valori di ψ ad istanti di tempo sufficientemente lontani diventino statisticamenteindipendenti.

• Che il processo sia stazionario a scale di tempo sufficientemente lunghe da conteneremolti intervalli di tempo tali che i valori di ψ nei diversi intervalli siano indipendenti.

• Che ovviamente siano soddisfatte le condizioni perche la legge dei grandi numeri siasoddisfatta, e cioe che la quantita di cui si calcola la media temporale abbia varianzae media finite.

A questo punto, la media temporale diventa essenzialmente una media campionaria tra ivalori di ψ nei diversi intervalli, dove ψ si puo considerare approssimativamente costante.

Verifichiamo questo risultato con un calcolo esplicito. Consideriamo il caso semplicein cui l’integrale nella Eq. (2.31) e finito (il risultato che segue puo essere generalizzatoal caso in cui τψ = ∞, ma la correlazione decresce lo stesso all’infinito). Supponiamo diapprossimare 〈ψ〉 con 〈ψ〉T , e, in analogia con la legge dei grandi numeri, calcoliamo 〈〈ψ〉T 〉e σ2

〈ψ〉T. Scambiando media e integrale nell’integrale per 〈ψ〉T , otteniamo subito.

〈〈ψ〉T 〉 = 〈〈ψ〉〉T = 〈ψ〉.

22 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

Definiamo quindi ψ(t) = ψ(t)−〈ψ〉 lo scarto (o fluttuazione rispetto alla media) e scriviamo:

σ2〈ψ〉T

=1

T 2

∫ T

0

dt

∫ T

0

dt′ 〈ψ(t)ψ(t′)〉 = 1

T 2

∫ T

0

dt

∫ T

0

dt′ C(t− t′).

Ora, per T ≫ τψ, possiamo approssimare l’integrale in dt′, per quasi tutti i valori di t, conun integrale tra ±∞ [a t′ = 0 e a t′ = T , se |t− t′| ≫ τψ, C(t− t′), e comunque gia nullo]:

σ2〈ψ〉T

≈ 1

T 2

∫ T

0

dt

∫ +∞

−∞

dτ C(τ) =2τψTC(0) ≡ 2τψ

Tσ2ψ (2.33)

ed ho utilizzato la (2.31). La varianza della media temporale decresce con τψ/T , che giocaquindi il ruolo del fattore 1/N nel caso della media campionaria.

2.6.1 Il teorema di Wiener-Khinchin

Nel caso di statistica stazionaria, una caratterizzazione alternativa delle proprieta di unprocesso stocastico (o di un campo random) puo essere ottenuta lavorando in spazio diFourier. Dato un processo stocastico x(t), possiamo definire la sua trasformata di Fourier:

xω =

∫ +∞

−∞

x(t)e−iωtdt. (2.34)

Dal punto di vista matematico, una simile espressione potrebbe avere senso solo se intesacome una distribuzione. Dal punto di vista pratico, ci accontentiamo di interpretare la(2.34) come una trasformata di Fourier in un dominio grande fissato [−T/2, T/2] e per unadiscretizzazione ∆t sufficientemente fine, ma anch’essa fissata. Cosı come abbiamo calco-lato le correlazioni del processo originario x(t), possiamo provare a calcolare le correlazionidella sua trasformata di Fourier. Otteniamo il seguente risultato:

〈xωxω′〉 =

∫ +∞

−∞

dt

∫ +∞

−∞

dt′〈x(t)x(t′)〉 exp[−i(ω′t′ + ωt)]

=

∫ +∞

−∞

dt

∫ +∞

−∞

dt′C(t− t′) exp[−iω(t− t′)− i(ω + ω′)t′],

dove si e sfruttato la statistica stazionaria per scrivere C(t, t′) = C(t− t′). Ora, l’integrale(2π)−1

∫ +∞

−∞dt′ exp[−i(ω + ω′)t′] non e altro che una delle rappresentazioni della delta di

Dirac δ(ω + ω′). Troviamo pertanto

〈xωxω′〉 = 2πCωδ(ω + ω′) (2.35)

dove Cω =∫ +∞

−∞dtC(t) exp(−iωt)dt, la trasformata di Fourier della funzione di correlazione

C(t), e il cosı detto spettro di potenza di x(t). Questo e il contenuto del teorema diWiener-Khinchin. Notiamo come l’antitrasformata a separazione temporale nulla

〈x2〉 ≡ C(0) =

∫ +∞

−∞

dω

2πCω

2.7. PROBABILITA DIPENDENTI DAL TEMPO 23

fornisca essenzialmente una decomposizione spettrale della varianza 〈x2〉. In svariati casi〈x2〉 puo essere interpretato come la potenza media di un segnale (x potrebbe essere adesempio il campo elettrico misurato vicino a un’antenna). Il significato di Cω come densitaspettrale di potenza del segnale e in questo caso evidente. Notiamo inoltre come per un

dominio finito abbiamo δ(0) → (2π)−1∫ T/2

−T/2dt = T/(2π),2, che permette di interpretare

〈|xω|2〉 = CωT

come la densita spettrale di energia a frequenza ω del segnale. (Si e utilizzata la proprietadelle trasformate di Fourier di funzioni reali: xω = x∗−ω).

2.7 Probabilita dipendenti dal tempo

Il passaggio da una descrizione microscopica di un sistema ad una macroscopica significain buona sostanza tralasciare una gran parte delle informazioni sullo stato istantaneo delsistema. Abbiamo visto che mediando a scale sufficientemente grandi, si potrebbe rag-giungere un limite termodinamico in cui il sistema (almeno vicino all’equilibrio) e descrittoda quantita che di nuovo obbediscono equazioni deterministiche (per esempio, la legge distato dei gas, oppure l’equazione del calore). Se pero ci limitiamo a considerare scale so-lo di poco superiori a quella di una piena descrizione microscopica, una tale descrizionediventa evidentemente impossibile. Analogamente se ci interessiamo a situazioni di fortenon-equilibrio in cui le fluttuazioni delle variabili macroscopiche diventano importanti.

Ci domandiamo come procedere per costruire un processo stocastico che modelli inmaniera soddisfacente situazioni come quelle considerate. Dal punto di vista dinamico, ilproblema e essenzialmente determinare l’evoluzione del processo (o meglio, determinarnela probabilita), data la storia pregressa del processo in questione. Il centro dell’analisisara necessariamente la probabilita delle realizzazioni del processo stocastico, che, comeabbiamo visto, fornisce una descrizione completa della statistica del processo in questione.

Per ragioni di semplicita (e altre ragioni di carattere concettuale che approfondiremofra breve), ci concentriamo sul caso di processi stocastici a valori discreti e a tempi discreti.Dato un processo stocastico ψk ≡ ψ(tk), utilizziamo quindi la notazione

P (ni; i = 0, 1, . . .) ≡ P (ψ(ti) ∈ [ψn, ψn+1], i = 0, 1, . . .); ti = i∆t, ψn = n∆ψ.

Chiamiamo gli intervalli [ψn, ψn+1] stati del sistema. Ci poniamo la seguente domanda:

• Qual’e la probabilita di un certo stato ni+1 al tempo ti+1 data una certa storiapregressa nk; k = 0, 1, . . . , i?

Questa e una probabilita condizionata, legata alla probabilita di realizzazione dalla rela-zione standard:

P (ni+1|nk; k = 0, 1, . . . i) = P (nk; k = 0, 1, . . . , i+ 1)P (nk; k = 0, 1, . . . , i) .

2Si ricorda che in un dominio finito la trasformata di Fourier viene rimpiazzata da una serie di Fourier.La distanza dei modi ∆ω ∼ T−1 e anche quindi la “larghezza” della delta di Dirac

24 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

Considereremo solo due casi chiave:

• Sistemi totalmente scorrelati (ad esempio il risultato del lancio di una moneta; seviene testa vale uno, se viene croce viene −1):

P (ni+1|nk; k = 0, 1, . . . i) = P (ni+1).

• Sistemi in cui conoscenza dello stato a un certo istante, rende inutile l’informazionesugli stati precedenti (esempio: il cosı detto camminatore random, che ad ogni istantefa un passo avanti o indietro a seconda del lancio della moneta. La posizione correntedel camminatore dipende solo dalla sua posizione precedente e dall’ultimo passoeffettuato; dove il camminatore si trovase in precedenza e completamente irrilevante).In formule:

P (ni+1|nk; k = 0, 1, . . . i) = P (ni+1|ni). (2.36)

Un processo con simili caratteristiche e detto un processo Markoviano.

I processi Markoviani ci forniscono uno strumento sufficientemente semplice per modellareil comportamento dei sistemi fisici di cui ci interesseremo lungo il corso. La probabilitaP (ni+1|ni) e detta una probabilita di transizione, e nel caso omogeneo nel tempo in cuiquesta e indipendente da i, utilizzeremo spesso la notazione

P (k → m) ≡ P (ni+1 = m|ni = k).

Consideriamo con un po’ piu di attenzione il cammino random, di cui abbiamo dato unesempio qui sopra. Nel caso in questione, ni rappresenta la casella dove si trova il cammina-tore all’istante ti e abbiamo evidentemente (se la moneta non e truccata) P (ni+1|ni) = 1/2se ni+1 = ni ± 1 e zero altrimenti. Ci domandiamo qual’e la probabilita P (ni|n0) delcamminatore di trovarsi in ni al tempo ti, se al tempo zero si trovava in n0.

Vediamo che abbiamo a che fare con un primo esempio di probabilita dipendentedal tempo, perche se P (n0 = k|n0 = j) = δkj, cioe la probabilita e concentrata in n0 = j,a un tempo successivo ti, il camminatore potra trovarsi in una qualsiasi casella compresatra j − i e j + i. Vediamo quindi che la distribuzione di probabilita del camminatoresi sparpaglia a passare del tempo. Il punto della questione, evidentemente, sta tutto neltrovare delle equazioni di evoluzione per queste probabilita dipendenti dal tempo, analoghealle equazioni del moto per un sistema deterministico.

Nel caso dei processi Markoviani, l’operazione e abbastanza semplice. Abbiamo infatti,dalla (2.36):

P (ni+1, ni, n0) = P (ni+1|ni, n0)P (ni|n0)P (n0) = P (ni+1|ni)P (ni|n0)P (n0)

e quindi

P (ni+1, ni|n0) = P (ni+1|ni)P (ni|n0),

2.7. PROBABILITA DIPENDENTI DAL TEMPO 25

da cui otteniamo, sommando sugli stati intermedi, la seguente equazione di Chapman-Kolmogorov:

P (ni+1|n0) =∑

ni

P (ni+1|ni)P (ni|n0). (2.37)

Detto in parole: la probabilita di trovare all’istante dato il sistema in un certo stato siottiene sommando sulle probabilita che questo si trovasse in tutti possibili stati all’istanteprecedente, pesate sulla probabilita di transizione dallo stato precedente a quello corrente.

Facciamo subito le seguenti osservazioni:

• Noi possiamo moltiplicare ambo i lati della equazione di Chapman-Kolmogorov (2.37)per una probabilita iniziale P0(n0) e sommare su P0(n0); otterremo la seguente varian-te della equazione di Chapman-Kolmogorov per una generica probabilita dipendentedal tempo:

P (ni) =∑

n0

P (ni|n0)P0(n0)

• E importante capire che la P0(n0) e arbitraria; nel caso del camminatore randompotremmo domandarci ad esempio come si distribuirebbe nel tempo un gruppo dicamminatori distribuiti inizialmente in maniera uniforme nelle caselle comprese trazero e dieci.

• Per determinare la probabilita che il sistema si trovi in un certo stato al tempo dato,dobbiamo quindi in genere assegnare una distribuzione di probabilita iniziale. Notabene che la scelta e nostra, non “appartiene” al processo stocastico: cio che e fissatodal processo stocastico e solo la probabilita di transizione.

• Notiamo infine che, se le probabilita di transizione sono indipendenti dal tempo,P (ni+1=m|ni=q) = P (q → m), e P0(n) e una soluzione stazionaria della equazionedi Chapman-Kolmogorov, P (ni) = P0(ni), allora la statistica del processo sara sta-zionaria: P (ni=m,nj=q, . . .) = P (ni+k=m,nj+k=q, . . .) ∀k (provare a dimostrarlo).

Ritorniamo ad interessarci al camminatore random, che, detto incidentalmente, sara unsistema con cui avremo a che fare per tutta la durata del corso. Supponiamo che il cam-minatore possa trovarsi in caselle n = 0, 1, . . . , N disposte ad anello, cosı che il puntoN coincide con zero. Supponiamo inoltre che il camminatore invece di essere costretto asaltare, sia caratterizzato da una probabilita PJ < 1/2 di salto avanti e di salto indietro euna probabilita 1 − 2PJ di restare nella casella corrente (questo serve per eliminare com-plicazioni irritanti del tipo che caselle pari sono raggiunte a partire da n0 pari solo a tempipari e viceversa).

Supponiamo che il nostro camminatore sia inizialmente in una certa casella n0. Abbia-mo visto che al passare del tempo, la distribuzione di probabilita, inizialmente concentratain n0, si sparpagliera. Una prima conseguenza evidente e che l’entropia del sistema, definitaa partire da P (t) cresce al passare del tempo.

26 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

Sappiamo pero che esiste una configurazione ad entropia massima, che e la distribuzioneequiprobabile P (n) = 1/N . Ci aspettiamo quindi che se prendessimo come distribuzioneiniziale P (n0) = 1/N , questa rimarrebbe costante nel tempo, il che e abbastanza compren-sibile, visto che non ci sono distribuzioni piu “sparpagliate” (cioe ad entropia piu alta)della distribuzione uniforme. In altre parole, la distribuzione uniforme e stazionaria. (Ineffetti, se distribuiamo un ugual numero di camminatori casella per casella, vediamo chese in media, dalla casella n a quella n+1, salta nel tempo ∆t una frazione PJ , nello stessotempo in media, un identica frazione saltera da n+ 1 a n).

Possiamo pero ottenere un risultato piu forte.Vediamo infatti che se due caselle vicine n ed n + 1 contengono numeri diversi Mn <

Mn+1 di camminatori, il numero di camminatori che si sposteranno da n + 1 a n sarapiu alto (in media) che il viceversa, e la differenza nel numero di camminatori tendera adiminuire. In altre parole, la distribuzione uniforme non e solo stazionaria, ma e anchequella secondo la quale tendono a disporsi i camminatori a tempi sufficientemente lunghi.

Riassumendo:

• La probabilita P (ni|n0) di trovare un camminatore in ni al tempo ti a partire dauna qualsiasi posizione iniziale n0 tende per i → ∞ alla distribuzione uniformeP (ni) = 1/N .

• Questa distribuzione risulta essere una soluzione stazionaria della equazione di Chapman-Kolmogorov (verificarlo!)

Abbiamo quindi la seguente definizione

• Quando la probabilita condizionata P (ni = m|n0) tende, per i → ∞, a un limiteP (m) indipendente dal tempo e dalla condizione iniziale, si dice che il sistema possiedeuno stato di equilibrio statistico e la P (m) e detta distribuzione d’equilibrio.

Nota bene che se il sistema possiede uno stato di equilibrio statistico, esso verra raggiuntoa partire da qualsiasi distribuzione iniziale P . Infatti:

limi→∞

P (ni = m) = limi→∞

∑

n0

P (n0)P (ni = m|n0) =∑

n0

P (n0)P (m) = P (m).

Come vedremo, i sistemi per cui ha senso pensare ad una descrizione termodinamica sonocaratterizzati da una legge di aumento di entropia e di solito sono anche caratterizzati dallapresenza di un unico stato di equilibrio (o perlomeno, per semplificarsi la vita, si supponedi solito che lo siano).

Va subito detto che esistono sistemi interessanti in cui l’entropia decresce a passaredel tempo. E analogamente, vi sono sistemi che non sono caratterizzati da un equilibriostatistico unico (e pero possibile dimostrare, che l’equazione di Chapman-Kolmogorov am-mette sempre una soluzione stazionaria; tutti i processi Markoviani posseggono quindi unadistribuzione stazionaria, anche se non e una distribuzione di equilibrio). Vediamo alcuniesempi:

2.8. COARSE GRAINING E LIMITE CONTINUO 27

• L’evoluzione di una popolazione sterile, la quale puo essere descritta da un processostocastico Ni, con Ni il numero di individui in vita all’istante i. Supponiamo cheinizialmente abbiamo N0 individui. Al passare del tempo questi iniziano a morire,con il risultato che, mentre inizialmente la distribuzione e concentrata in N0, peri > 0, altri valori N < N0 diventano via via possibili. Quindi inizialmente la P (Ni)si sparpaglia e l’entropia cresce. Per tempi lunghi, pero, la popolazione si estingue,e abbiamo la distribuzione d’equilibrio P (N) = δN0. L’entropia scende di nuovo azero.

• Il “ping-pong”: un sistema a due stati 0, 1 con probabilita di transizione P (0 → 1) =P (1 → 0) = 1. Quindi, la pallina salta da zero a uno senza interruzione. Ora, separto da 0, avro che P (0) sara per sempre 0 o 1 a seconda che i e dispari o pari, eviceversa se parto da 1. Quindi, il sistema non ammette equilibrio statistico. Notapero che se parto da una distribuzione iniziale P (n0) = 1/2 per n0 = 0, 1, avroP (ni) = 1/2 anche per i > 0 cosı che la P (ni) e stazionaria.

• Il camminatore random in una scatola con una parete in mezzo. E chiaro che seil camminatore parte da una meta di una scatola, la distribuzione di equilibrio sarauniforme da quel lato e zero nell’altro, e viceversa. Abbiamo quindi una distribuzionedi equilibrio che non e unica e dipende dalla condizione iniziale.

2.8 Coarse graining e limite continuo

Sino ad ora ci siamo mantenuti abbastanza sulle generali, senza farci domande sulla naturadello spazio degli stati ni su cui si evolve il processo stocastico, o sull’origine dinamica dioggetti, come la probabilita di transizione P (ni+1|ni). Una descrizione attraverso processistocastici di un sistema con una dinamica microscopica, e molto spesso il risultato di unaoperazione cosı detta di coarse graining, a partire da una dinamica microscopica, che inlinea di principio potrebbe anche essere deterministica (ma solitamente troppo difficile dadescrivere). La procedura puo essere esemplificata come segue:

• Identificazione di unamicroscala al di sotto della quale i dettagli della dinamica sonosupposti sconosciuti. Nel caso di un gas, potrebbe trattarsi della scala molecolare(descrizione attraverso equazioni di Newton delle molecole).

• Definizione (se necessario) di una mesoscala dove la dinamica e meno complicatache alla microscala. Esecuzione quindi di una operazione di coarse graining, in cuile proprieta di microscala sono mediate. Di nuovo nel caso del gas, la mesoscala po-trebbe essere individuata dal cammino libero medio (descrizione attraverso equazionedi Boltzmann per il gas).

Vediamo un esempio di come un’operazione di coarse graining puo portare a una sem-plificazione della dinamica. Immaginiamo di trovarci qualcosa di simile a un cammino

28 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

random, in cui la lunghezza dei passi puo variare, e in piu questi sono correlati nel tempo.Immaginiamo per semplificare che la correlazione temporale esista solo fra salti successivi:

〈∆ni∆ni±1〉 = cσ2∆n, 0 < c < 1; 〈∆ni∆ni±k〉 = 0, k ≥ 2.

Proviamo a fare coarse graining nel tempo e definiamo una mesoscala ∆t contenente mintervallini ∆t. Avremo quindi

∆ni =m∑

j=1

∆ni+j

Da qui, sfruttando c > 0, troviamo

σ2∆n

≥ mσ2∆n,

mentre〈∆ni ∆ni±1〉 = 〈∆ni∆ni±1〉 = cσ2

∆n

(solo l’ultimo contributo ∆ni in un intervallo ∆t e il primo nel successivo sono corre-lati). Vediamo quindi che l’importanza della correlazione, parametrizzata dal rapporto〈∆ni ∆ni±1〉/σ2

∆ndiventa trascurabile per m grande. In altre parole, il coarse graining

temporale ci riporta a una situazione di passi indipendenti, ed ni diventa un processoMarkoviano.

Il passaggio alla mesoscala comporta spesso la transizione da una dinamica di tipo di-screto a una di tipo continuo. Il passaggio al limite continuo, nel caso di processi stocastici,presenta pero difficolta sia di carattere procedurale che concettuale, e non detto in generaleche esista.

Un primo esempio di difficolta con il limite continuo, lo abbiamo visto nella definizionedi entropia di PDF [Eq. (2.20)]. Un secondo esempio lo troviamo, a livello di realizzazionedi processo stocastico, gia nel caso del cammino random. Iniziamo con il domandarci qual’elo spostamento tipico del camminatore in un tempo t≫ ∆t. Se PJ e la probabilita di salto(uguale in avanti e all’indietro), otteniamo subito

〈|x(t)− x(0)|2〉 = PJ

t/∆t∑

i=1

∆x2 =PJ∆x

2

∆tt := κt (2.38)

Un limite continuo si ottiene mandando simultaneamente ∆t e ∆x a zero, ma vediamosubito che, perche la varianza 〈|x(t) − x(0)|2〉 rimanga finita al limite, deve essere ∆x =O(∆t1/2). Questo ci crea un problema nella definizione di una velocita istantanea delcamminatore. Una stima “ragionevole” dalla (2.38) ci porta a un risultato infinito:

u(0) = limt→0

〈|x(t)− x(0)|2〉1/2t

=κ1/2

2limt→0

t−1/2 = ∞.

Vediamo quindi che la velocita istantanea non e definita. Il limite continuo per la velocitanon e ben definito.

2.9. L’EQUAZIONE MASTER 29

2.9 L’equazione master

I problemi nell’esecuzione di un limite continuo diminuiscono notevolmente se invece di la-vorare con le realizzazioni del processo, ci si interessa delle quantita medie, come ad esempiole probabilita degli stati del processo stocastico. Supponendo che queste quantita varinopoco sulla scala di discretizzazione (micro o mesoscala), possiamo provare ad approssimaredifferenze finite con derivate e somme con integrali. A questo punto, le separazioni t− t′ oψ − ψ′ possono essere mandate tranquillamente a zero, anche se originariamente ∆t e ∆ψerano finite.

Siamo interessati ad ottenere equazioni di evoluzione per la probabilita in forma dif-ferenziale, o al limite integro-differenziale (il fatto che si arrivi a equazioni di questo tipolineari, con coefficienti che dipendono lentamente dalle variabili, costituisce conferma aposteriori che il limite esiste). Ci focalizziamo sul caso di processi Markoviani. Il nostropunto di partenza sara pertanto l’equazione di Chapman-Kolmogorov (2.37).

Introduciamo la notazione P (xm, ti) ≡ P (m, i) ≡ P (ni = m). Continueremo ad indica-re la probabilita all’equilibrio con P (xm) ≡ P (m). L’equazione di Chapman-Kolmogorov(2.37) diventa:

P (m, i+ 1)− P (m, i) =∑

k

P (k → m)P (k, i)− P (m, i)

=∑

k 6=m

[P (k → m)P (k, i)− P (m→ k)P (m, i)], (2.39)

dove si e utilizzato∑

k P (m → k) = 1 e il passaggio∑

k →∑

k 6=m e giustificato dal fattoche i termine k = m nei due addendi in parentesi quadra si cancellano. In parole, laformula appena qui sopra ci dice che l’incremento nel numero di risultati in m al passaredel tempo e dato dal numero di risultati che passano da k a m meno quelli che da m se nevanno a k.

Per fare il limite continuo, e necessario che il cambio P (m, i+ 1)− P (m, i) sia piccoloconfrontato con i valori tipici di P (m, i). Questo richiede P (k → m) ≪ 1. Sarebbe belloa questo punto definire una probabilita di transizione per unita di tempo P (k → m) =P (k → m)/∆t e ottenere cosı una equazione differenziale. Vediamo in effetti che

P (k, t+ lδt|m, t) ≃ lP (k, t+∆t|m, t) +O([P (k, t+∆t|m, t)]2)

e quindiP (k, t+∆t|m, t)P (k, t+∆t|m, t) =

∆t

∆t⇒ P (m→ k) = P (m→ k)∆t,

con P (m→ k) indipendente da ∆t.Otteniamo finalmente la seguente cosı detta equazione master:

∂P (m, t)

∂t=

∑

k 6=m

[P (k → m)P (k, t)− P (m→ k)P (m, t)]. (2.40)

30 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

Il passo successivo e evidentemente P (m, t) ≃ ρ(xm, t)∆xm, P (k → m) ≃ ρ(xk → xm)∆xm,e la master equation diventa in generale un’equazione integro-differenziale:

∂ρ(x, t)

∂t=

∫

dy [ρ(y → x)ρ(y, t)− ρ(x→ y)ρ(x, t)].

Nel caso in cui le transizioni avvengano solo con i primi vicini, P (m→ m± 1), ci immagi-niamo che l’equazione master diventi una equazione differenziale alle derivate parziali. Unasituazione di questo genere si verifica sia nel caso del cammino random che dei processi dinascita e morte.

2.9.1 Cammino random

In questo caso abbiamo una probabilita di salto PJ = P (k → k + 1) = P (k → k − 1), cosıche P (k → k) = 1 − 2PJ . Dividendo per ∆t troviamo le probabilita per unita di tempoP (K → k + 1) = P (k → k − 1) = PJ/∆t, e l’equazione master (2.40) prende la forma

∂P (k, t)

∂t=PJ∆t

[P (k + 1, t) + P (k − 1, t)− 2P (k, t)] ≃ PJ∆x2

∆t

∂2P (xk, t)

∂x2k.

Definendo la diffusivita κ = PJ∆x2/∆t, otteniamo l’equazione del calore (o equazione

di diffusione):

∂ρ(x, t)

∂t= κ

∂2ρ(x, t)

∂x2. (2.41)

Notare il significato fisico della diffusivita:

〈|x(t)− x(0)|2〉 = Pj

t/∆t∑

k=1

∆x2 = κt,

che risulta essere quindi il tasso di crescita della varianza della posizione del camminatore(confrontare con la (2.38).

2.9.2 Processo di estinzione

Supponiamo in questo caso che un individuo abbia una probabilita di morte nell’intervallo∆t data da Γ∆t. Se al tempo ti ci sono Ni individui, la probabilita di avere una mortesara quindi NiΓ∆t (a patto sempre che NiΓ∆t ≪ 1). L’equazione master (2.40) diventaquindi:

∂P (N, t)

∂t= ΓD[(N + 1)P (N + 1, t)−NP (N, t)] ≃ ΓD

∂(NP (N, t))

∂N

e di nuovo possiamo passare alle PDF P (N, t) = ρ(N, t)∆N ≡ ρ(N, t)× 1 = ρ(N, t):

∂ρ(N, t)

∂t= ΓD

∂(Nρ(N, t))

∂N. (2.42)

2.10. ESERCIZI 31

Va notato come in entrambi i casi del cammino random (2.41) e del processo di estinzione(2.42), l’equazione di evoluzione ha la forma di un’equazione di continuita

∂ρ(N, t)

∂t+∂J(x, t)

∂x= 0,

dove nel primo caso J(x, t) = −κ∂ρ(x, t)/∂x, mentre nel secondo J(N, t) = −NΓDρ(N, t).E interessante osservare come nel secondo caso ΓDN e proprio una velocita di diminuzio-ne (e infatti ha segno negativo) della popolazione N . Nel caso della equazione del calore,abbiamo invece una cosı detta relazione flusso gradiente. Il flusso di probabilita va in di-rezione opposta al gradiente in ρ e agisce quindi nella direzione di appianare disomogeneitadella PDF.

Un’ultima osservazione concerne il legame tra l’ordine rispetto alla variabile stocastica(x o N) nella equazione differenziale, e il numero di siti vicini che sono richiamati a latodestro nella originaria equazione master. Vediamo che un primo vicino porta al piu a unaderivata prima, due vicini a una derivata seconda, eccetera. [“Porta al piu”; non “portasicuramente”. Abbiamo infatti P (k+1)−P (k) ≃ P ′(xk)∆xk, ma P (k+1)+P (k) ≃ 2P (xk)].Vediamo inoltre che l’operazione di coarse-graining descritta nella lezione precedente eequivalente a trascurare derivate di ordine successivo nella equazione differenziale che siottiene al limite continuo.

2.10 Esercizi

Esercizio 1 Supponiamo le variabili aleatorie x, y distribuite in modo equiprobabile neltriangolo con vertici (0, 0), (0, 1), (1, 1). Calcolare le PDF e probabilita condizionateρ(x|y > 0.5) e P (y > 0.5|x).

Esercizio 2 Un tiratore scarso, le rare volte che becca il bersaglio, lo colpisce in un punto acaso (supporre il bersaglio circolare e di raggio unitario). Si calcoli la PDF che il bersagliosia colpito a distanza r dal centro, condizionale al fatto che il bersaglio sia stato colpito. Dinuovo condizionale a che il bersaglio sia stato colpito, calcolare la probabilita che il colpovada a r < 1/2.

Esercizio 3 La PDF della velocita v = (vx, vy, vz) di una molecola monoatomica di un gasideale in un volume V , all’equilibrio termodinamico e:

ρ1(v) =( m

2πKT

)3/2

exp(

− mv2

2KT

)

(2.43)

dove m e la massa molecolare, T e la temperatura e K e la costante di Boltzmann (inun gas ideale le velocita delle differenti molecole sono approssimate come statisticamenteindipendenti ed all’equilibrio la densita del gas e uniforme: n = N/V dove N e il numerodi molecole nel gas).

• Si scrivano la PDF ρ1(r,v) e la PDF congiunta ρN(ri,vi).

32 CAPITOLO 2. RICHIAMI DI PROBABILITA E STATISTICA

• Si calcoli l’entropia del gas S = S(T, V,N) = −〈ln ρN〉.

• Stimare numericamente l’energia interna U =∑N

i=112m|vi|2 e l’ampiezza delle sue

fluttuazioni, note la costante di Boltzmann K ≃ 1.4 · 10−23J oK−1 e posto N ∼ 1020,V ≃ 1m3, T ∼ 300 oK, m ≃ 7 · 10−27Kg [ricordo che la varianza della (2.43) e:σ2vx = σ2

vy = σ2vz = KT/m].

Capitolo 3

La teoria cinetica

3.1 Alcune problematiche in teoria cinetica

Vogliamo descrivere la dinamica di un sistema macroscopico composto da un gran numerodi componenti microscopiche (molecole) non necessariamente indipendenti. La descrizionecinetica completa di un sistema con N gradi di liberta interagenti, e ottenuta assegnandola PDF congiunta ρN(yk, k = 1, . . . , N, t) del valore al tempo t di tutti gli N gradi diliberta. (Nel caso di molecole vere e proprie, la coordinata yi della molecola i-esima sarebbein realta il vettore a sei componenti (xi,vi)). La PDF ρN e definita su uno spazio a Ndimensioni, a cui viene dato in genere il nome di Γ-spazio. A partire dalla PDF sul Γ-spazio, possiamo ottenere le PDF marginali ρN−1, . . . definite su un sottoinsieme ristrettodi variabili, sino alla PDF a una particella ρ1(y, t), che e la PDF di trovare una molecoladata nel punto y al tempo t. A partire dalla ρ1, possiamo poi ottenere la densita media diparticelle f1 in un punto y dato:

f1(y, t) =N∑

i=1

ρ1(yi = y, t).

Pertanto, f1(y, t)∆y sara il numero medio di molecole al tempo t nell’intervallo [y, y+∆y].In maniera analoga, possiamo definire le densita di coppie f2(y, z; t) = N(N − 1)ρ2(y, z, t)e cosı via.

Va notato che se f1(y, t)∆y ≫ 1, abbiamo che questa quantita (che e una media)coincide di fatto con il numero effettivo (nella realizzazione) delle molecole nell’intervallino∆y. La quantita f puo quindi essere vista (a patto di fare un coarse-graining sufficiente iny) come una densita istantanea (vedere la discussione nella Sez. 2.3). Vediamo quindi che,al contrario della descrizione fornita dalla PDF ρ1, che e microscopica (stiamo chiedendodove si trova la particella data), quella fornita da f1 e macroscopica. Notiamo infine chesolo se supponiamo le particelle identicamente distribuite possiamo scrivere

f1(y, t) = Nρ1(yi = y, t), (3.1)

e le due descrizioni con f1 e con ρ1 diventano equivalenti.

33

34 CAPITOLO 3. LA TEORIA CINETICA

Abbiamo visto nella Sez. 2.3 come il concetto di entropia permetta di identificaresituazioni di equilibrio termodinamico in sistemi semplici come un gas in un recipienteisolato. In presenza di interazioni fra le molecole, sembrerebbe ragionevole utilizzare, comepunto di partenza per la definizione di una entropia termodinamica, l’entropia di Shannonassociata alla ρN su qualche partizione del Γ-spazio:

SN ≃ −∑

k

ρN(Γk)δΓk ln[ρN(Γk)δΓk],